TMI2024|阿大、同濟等提出TraCoCo,用于3D醫(yī)學圖像半監(jiān)督分割

編輯 | ScienceAI

3D 醫(yī)學圖像分割方法已經(jīng)取得了成功,但它們對大量體素級標注數(shù)據(jù)的依賴是一個需要解決的缺點,因為獲取這些標注的成本很高。

半監(jiān)督學習(SSL)通過使用大量未標注數(shù)據(jù)和少量標注數(shù)據(jù)進行模型訓練,解決了這一問題。

最成功的 SSL 方法基于一致性學習,即通過最小化從擾動視圖中獲得的模型響應之間的距離來實現(xiàn)的。這些擾動通常在視圖之間保持空間輸入上下文的一致性,這可能導致模型從空間輸入上下文中學習分割模式,而不是從前景對象中學習。

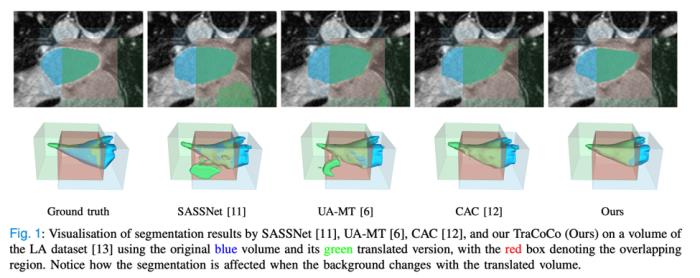

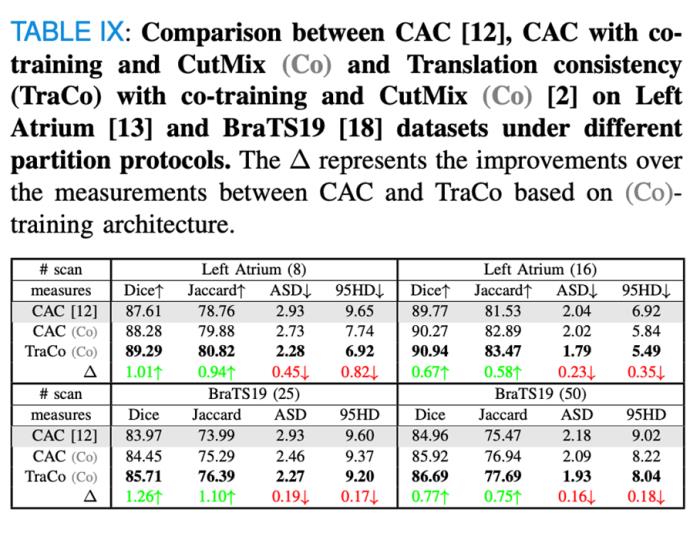

在最新的研究中,澳大利亞阿德萊德大學(The University of Adelaide)、同濟大學等機構(gòu)的研究人員提出了 TraCoCo,這是一種一致性學習 SSL 方法,它通過改變輸入數(shù)據(jù)視圖的空間輸入上下文來進行擾動,使模型能夠從前景對象中學習分割模式。

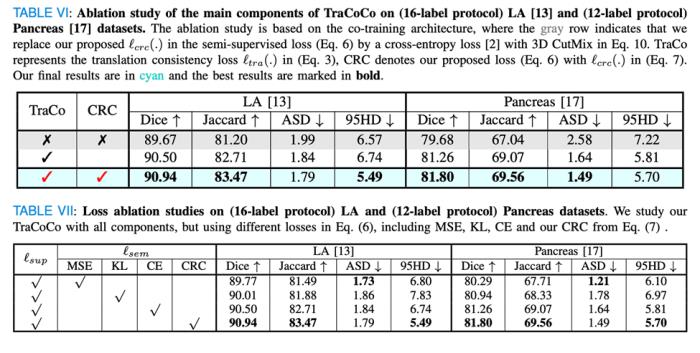

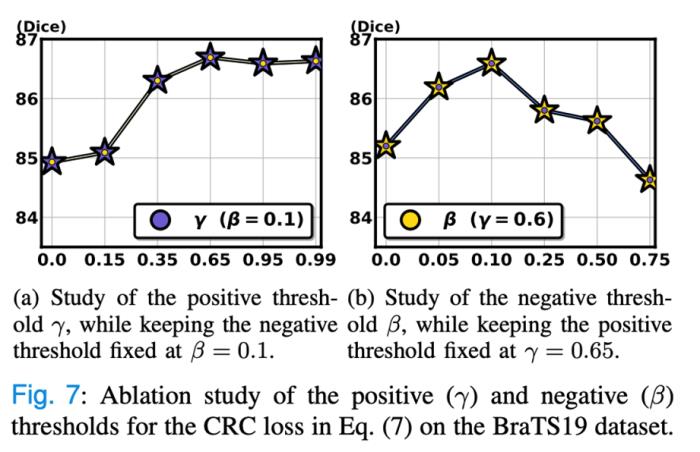

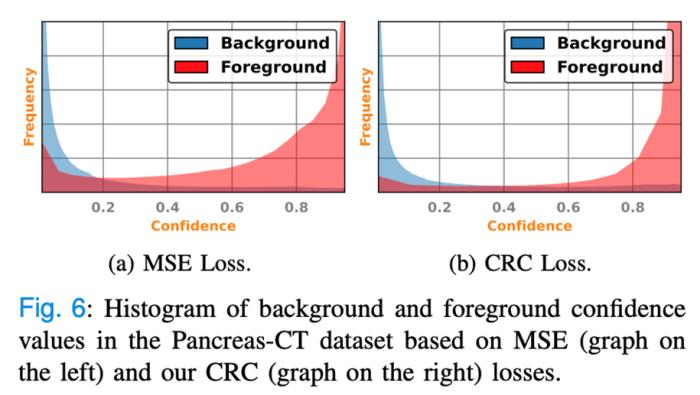

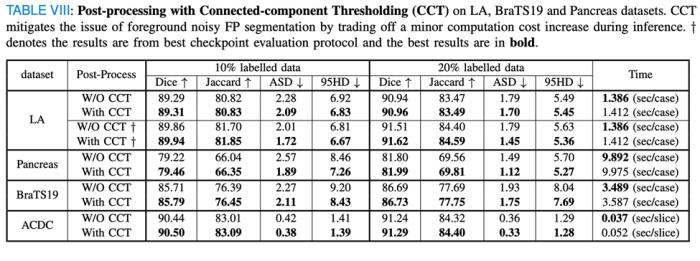

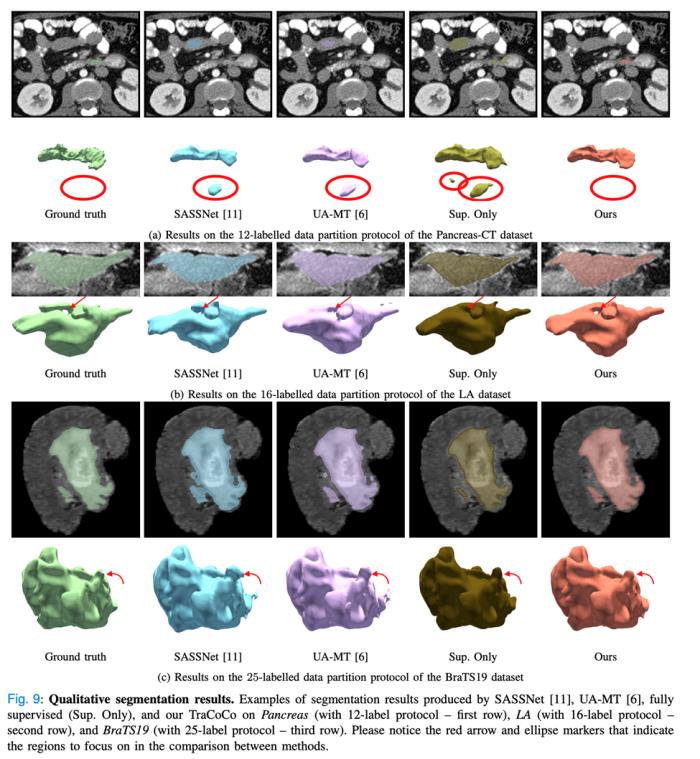

此外,該團隊提出了一種新的“Confident Regional Cross entropy (CRC)”損失,該損失提高了訓練收斂性,并保持了對共訓練偽標簽錯誤的魯棒性。該方法在多個3D數(shù)據(jù)基準上達到了最先進的結(jié)果,例如左心房(LA)、胰腺CT(Pancreas)、和腦腫瘤分割(BraTS19)。該方法在一個 2D 切片基準——自動心臟診斷挑戰(zhàn)(ACDC)上也取得了最佳結(jié)果,進一步證明了其有效性。

文章地址:https://ieeexplore.ieee.org/abstract/document/10695462

代碼地址:https://github.com/yyliu01/TraCoCo

背景

3D醫(yī)學圖像分割方法雖然已取得成功,但它們依賴于大量體素級別標注數(shù)據(jù),這是一個亟需解決的問題,因為獲得這些標注的成本非常高。為了克服這一挑戰(zhàn),半監(jiān)督學習(SSL)通過結(jié)合大量未標注數(shù)據(jù)和少量標注數(shù)據(jù)來訓練模型,從而減少對標注數(shù)據(jù)的需求。

最成功的 SSL 方法基于一致性學習,通過最小化模型在未標注數(shù)據(jù)的不同擾動視圖下的響應差異來實現(xiàn)一致性。然而,這些擾動通常保持視圖之間的空間輸入上下文較為一致,這可能導致模型從空間上下文中學習分割模式,而不是從前景對象中學習。

為解決這一問題,研究人員提出了一種新的 SSL 方法,稱為 Translation Consistent Co-training(TraCoCo)。TraCoCo 通過改變輸入數(shù)據(jù)視圖的空間輸入上下文來擾動視圖,使模型能夠從前景對象中學習分割模式。

同時,該研究還提出了一種新的 Confident Regional Cross-Entropy(CRC)損失,該損失旨在提高訓練的收斂性并保持對共訓練偽標簽錯誤的魯棒性。

Translation Consistent Co-training(TraCoCo)

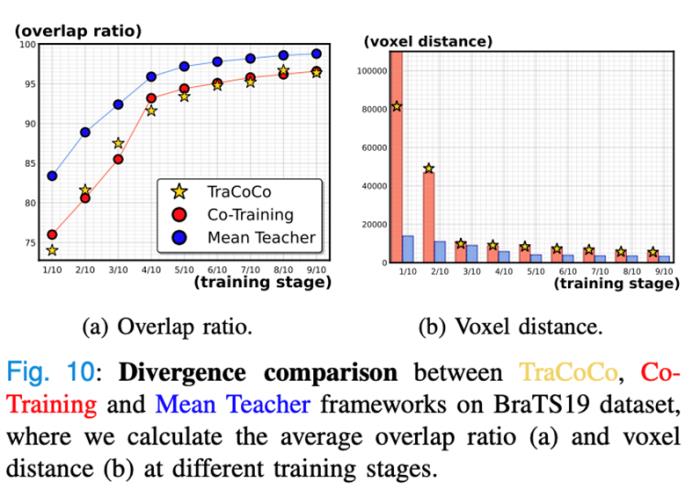

TraCoCo是一種基于互助學習(Co-training)框架的方法,該框架通過翻譯一致性(Translation Consistency)來擾動輸入數(shù)據(jù)的空間上下文,從而減少模型對背景模式的“記憶”,確保模型專注于前景對象的分割。

模型框架

TraCoCo 包含兩個初始參數(shù)不同的獨立網(wǎng)絡(通常為 VNet或 3D-UNet)。輸入數(shù)據(jù)通過隨機裁剪生成兩個子體積(sub-volumes),這兩個子體積的空間上下文不同,但在體素網(wǎng)格中存在重疊區(qū)域。

模型目標

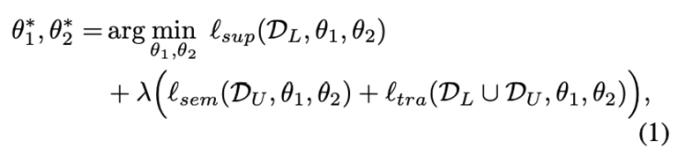

為了確保模型在不同空間上下文下的前景分割結(jié)果一致,TraCoCo 引入了多種損失函數(shù),包括監(jiān)督學習損失、半監(jiān)督學習損失和翻譯一致性損失。本文的方法實現(xiàn)通過最小化以下?lián)p失函數(shù)來進行訓練:

其中,分別由監(jiān)督學習損失,半監(jiān)督學習損失,和翻譯一致性損失組成。

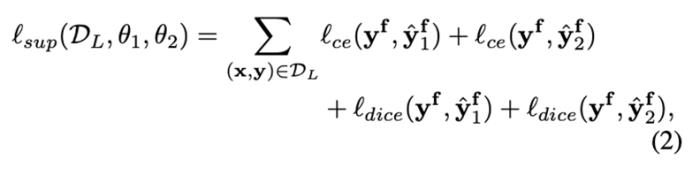

監(jiān)督學習損失(SupervisedLearning Loss)

監(jiān)督學習損失通過帶標注的數(shù)據(jù)集 D_L 進行計算,包括體素級交叉熵損失(Cross-Entropy Loss)和 Dice損失,用來優(yōu)化模型的分割性能。損失函數(shù)定義為:

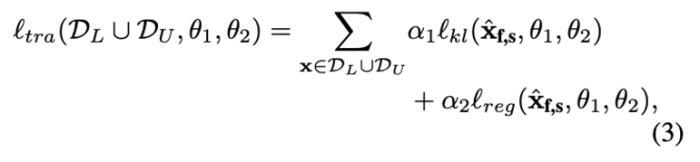

TranslationConsistency Loss

Translation ConsistencyLoss 主要目標是確保模型在不同空間上下文下的分割結(jié)果一致。具體實現(xiàn)過程如下:從訓練體積中隨機提取兩個中心不同的子體積

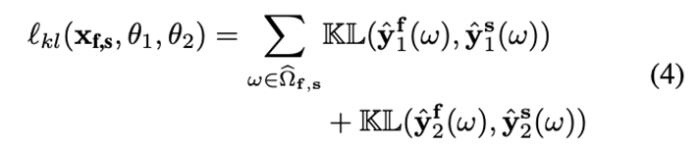

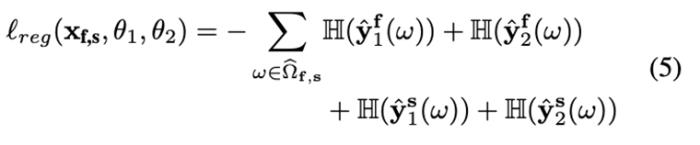

損失函數(shù)定義為:

其中,公式 4 是 Kullback-Leibler(KL)散度,用于計算兩個子體積在重疊區(qū)域的分割結(jié)果之間的差異;公式 5 是基于負熵的正則化損失,用于平衡訓練體素中的前景和背景類。

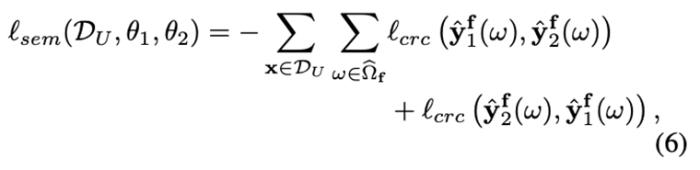

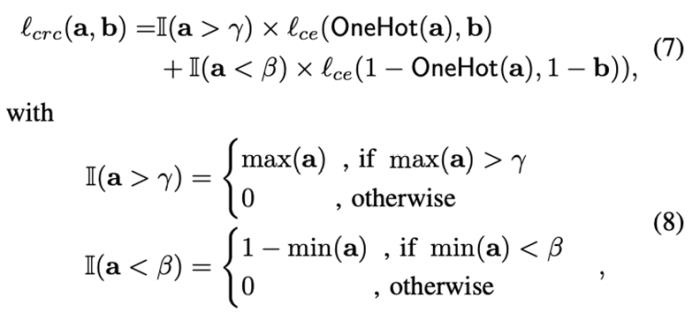

半監(jiān)督學習損失(Semi-supervisedLearning Loss)

半監(jiān)督學習損失用于強化兩個模型之間的分割一致性,Confident Regional Cross-Entropy (CRC) Loss, 其定義為:

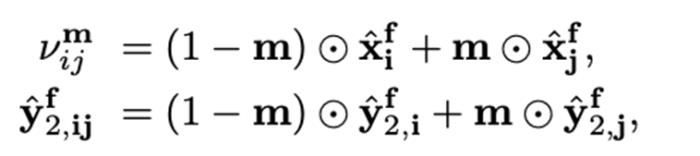

3DCutMix

為了進一步提高訓練的泛化性,本文采用了 3DCutMix 技術(shù)。實現(xiàn)為隨機生成一個 3D 二值掩碼,該掩碼包含一個隨機定義位置和尺寸的“1”方塊。掩碼應用在未標注數(shù)據(jù)和偽標簽上,定義為:

實驗

本文在四個公開的 3D 醫(yī)學圖像半監(jiān)督分割數(shù)據(jù)集上進行了實驗,包括:

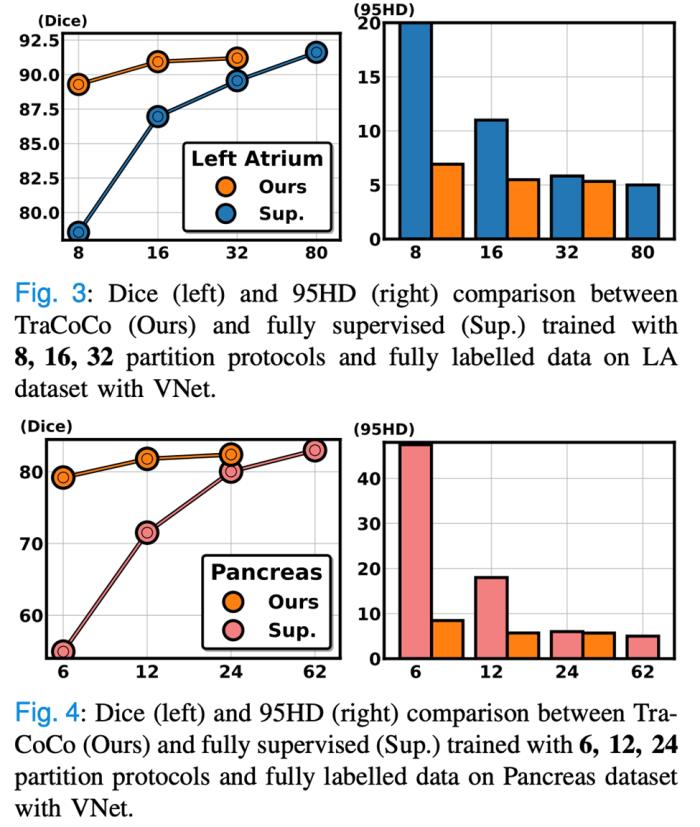

左心房(Left Atrium, LA):100 個 3D MRI 體積,其中 80 個用于訓練,20 個用于測試。

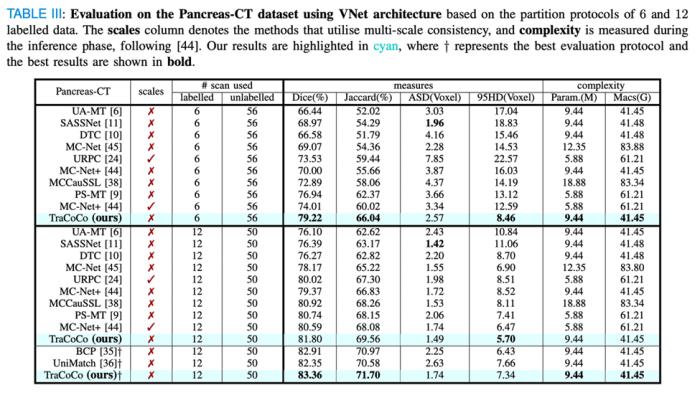

胰腺 CT(Pancreas-CT):82 個對比增強的 CT 掃描,采用特定的預處理步驟。

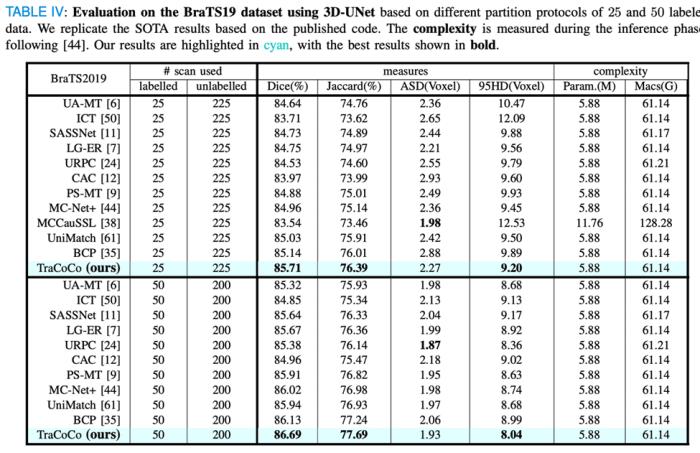

腦腫瘤分割 2019(BraTS19):包含 335 個腦部 MRI 樣本,每個樣本包含四種掃描類型(T1, T1-ce, T2, FLAIR)。

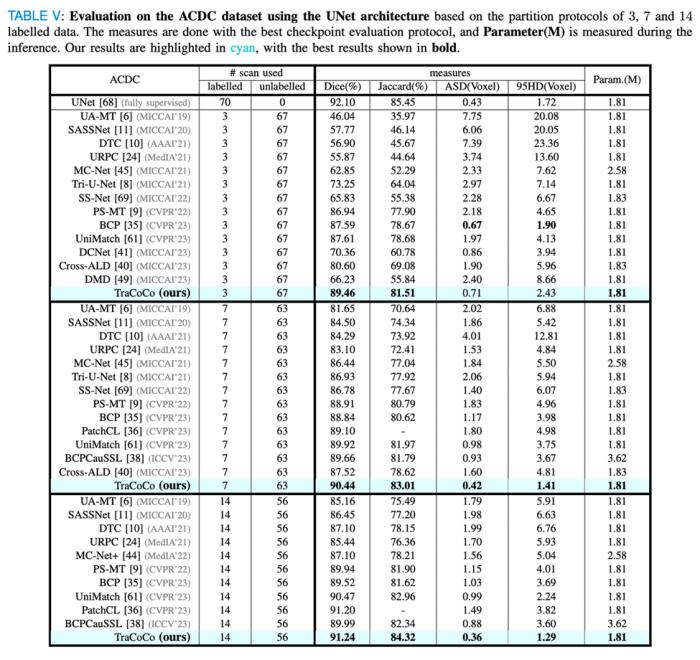

自動心臟診斷挑戰(zhàn)(ACDC):該數(shù)據(jù)集包含 100 個心臟 MRI 掃描,本文使用了其 2D 切片進行半監(jiān)督學習。

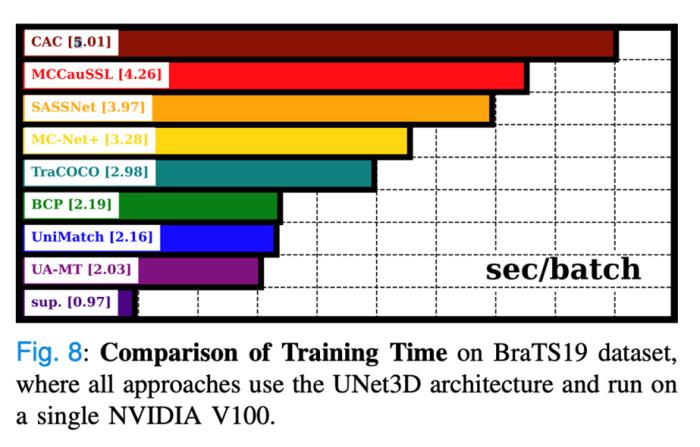

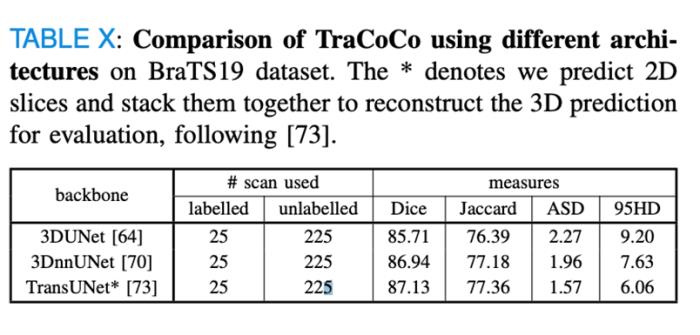

實驗設置:采用了 VNet 和 3D-UNet 作為模型架構(gòu),實驗評估指標包括Dice、Jaccard、平均表面距離(ASD)和 95%Hausdorff距離(95HD)。實驗結(jié)果顯示,TraCoCo 在這些基準測試上均優(yōu)于現(xiàn)有的最先進(SOTA)方法,特別是在標注數(shù)據(jù)較少的情況下。

總結(jié)

本文提出了 TraCoCo 和 CRC 損失在 3D 和 2D 醫(yī)學圖像分割任務中的有效性,證明了其在減少對背景模式的“記憶”以及提高前景對象分割精度方面的能力。

未來的工作計劃包括擴展 TraCoCo 到更多復雜的醫(yī)學圖像任務,并在多模態(tài)醫(yī)學圖像中探索其半監(jiān)督學習能力。

- 免責聲明

- 本文所包含的觀點僅代表作者個人看法,不代表新火種的觀點。在新火種上獲取的所有信息均不應被視為投資建議。新火種對本文可能提及或鏈接的任何項目不表示認可。 交易和投資涉及高風險,讀者在采取與本文內(nèi)容相關(guān)的任何行動之前,請務必進行充分的盡職調(diào)查。最終的決策應該基于您自己的獨立判斷。新火種不對因依賴本文觀點而產(chǎn)生的任何金錢損失負任何責任。

新火種

2024-11-16

新火種

2024-11-16