word2vec作者曝與Ilya等十年積怨:seq2seq也是我的想法

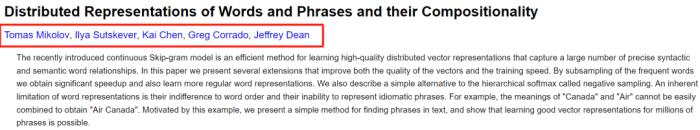

里程碑式論文word2vec獲得NeurIPS時間檢驗獎,可謂實至名歸。

但一作Tomas Mikolov在Facebook上發表的長篇獲獎感言,卻充滿了失望和不滿。

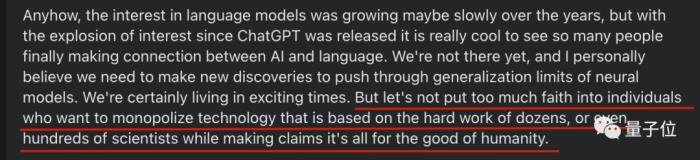

論文最初被ICLR拒稿都算小事了,他還暗諷了OpenAI首席科學家Ilya Sutskever(當時兩人都在谷歌):

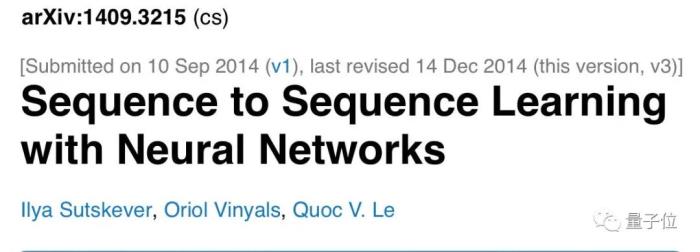

Mikolov話中所指的是word2vec之后又一個里程碑式研究seq2seq,發表于2014年,不出意外的話也將會獲得2024年的NeurIPS時間檢驗獎。

Tomas Mikolov聲稱seq2seq的想法最初來自于他,在谷歌大腦工作期間與Quoc Le和Ilya有過多次討論。

但他跳槽到Facebook后,很驚訝看到最終發表的成果中自己沒有成為共同作者。

從word2vec到seq2seq

最初word2vec論文投稿到首屆ICLR會議(當時還只是一個workshop),盡管接受率高達70%,但還是被據搞了。

這讓Mikolov感慨,審稿人想要預測一篇論文未來的影響是多么困難。

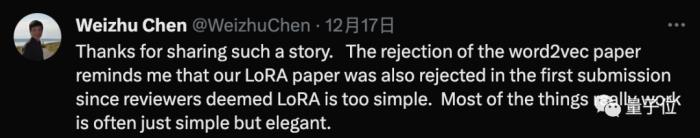

不少研究者都有同感,如今在大模型與AI繪畫都大量應用的LoRA作者微軟Weizhu Chen透露,當初第一次投稿時也被拒了,因為審稿人認為太簡單。

Mikolov這些年聽到了很多對word2vec的評論,正面負面都有,但并沒有真正在網絡上回應過。

借著這次獲獎加10周年的機會,Mikolov分享了一些這篇經典論文的背后故事。

首先是很多人抱怨word2vec的代碼很難理解,甚至有人以為Mikolov是故意讓大家看不懂的。

現在他澄清了“不,我還沒那么邪惡”,只是在等待被批準發布代碼的幾個月中試圖讓它更短、更快,最終代碼被過度優化了。

盡管word2vec是Mikolov被引用次數最高的論文,但他卻從未認為這是自己最有影響力的項目。

實際上word2vec最初是他的RNNLM項目中一個子集,這個項目很快被人們遺忘了。

RNNLM開始于2010年,深度學習還處在黑暗時代,Mikolov列舉了其中首次展示的想法:

循環神經網絡的可擴展訓練,他提出了梯度裁剪(Gradient Clipping)神經語言模型首次生成文本,他從2007年開始就展示這樣的例子動態評估字符和子詞級的神經語言建模神經語言模型適應,現在被稱為微調第一個公開可用的語言模型評測基準,也就是修改后的Penn Treebank數據集

2012年,Mikolov從捷克布爾諾理工大學博士畢業后加入了谷歌大腦。

他表示自己很幸運,那里有大量神經網絡的信徒,允許自己研究word2vec、展示其潛力,但他不想給人們留下一切都很完美的印象。

在word2vec之后,Mikolov想通過改進谷歌翻譯來普及神經語言模型。開始與Franz Och的團隊合作,期間提出了幾個可以補充甚至取代當時機器翻譯的模型。

核心想法在他加入谷歌大腦之前就已經提出,也就是在不同語言句子對上訓練,然后使用生成模型翻譯看到的第一句話。

當時在短句子上效果很好,較長句子效果還不佳。他與谷歌大腦中的其他人(主要是Quoc Le和Ilya Sutskever)多次討論過這個項目,他們在自己跳槽到Facebook后接手。

……

大家看到Mikolov的長篇感言,也是百感交集。

康奈爾大學助理教授Volodymyr Kuleshov借word2vec被拒稿的故事,鼓勵大家不要因論文同行評議過程而灰心,“好的想法終會得到應有的認可”。

也有人認為,Mikolov指出的貢獻分配、引用數量和影響力等問題,不光是NLP的問題,而是整個AI領域都存在。

- 免責聲明

- 本文所包含的觀點僅代表作者個人看法,不代表新火種的觀點。在新火種上獲取的所有信息均不應被視為投資建議。新火種對本文可能提及或鏈接的任何項目不表示認可。 交易和投資涉及高風險,讀者在采取與本文內容相關的任何行動之前,請務必進行充分的盡職調查。最終的決策應該基于您自己的獨立判斷。新火種不對因依賴本文觀點而產生的任何金錢損失負任何責任。

新火種

2023-12-21

新火種

2023-12-21