基于CPU服務器實現Llama2等應用落地,英特爾展示五代至強可擴展芯片實踐

本周,英特爾數據中心產品技術媒體分享會在北京舉行。多位英特爾技術專家為我們從多個角度,以實踐應用的角度解析了最新一代服務器 CPU 產品的技術特性及獨特價值。

當前,AI 技術落地的速度正在加快,有全球調研結果顯示,58% 的企業期待在近未來導入生成式 AI 等技術。預計到 2026 年,生成式 AI 的市場規模將達到 3000 億美元,這其中包括硬件、軟件、解決方案等。約會有 80% 以上的公司,會在 2026 年之前會導入某種程度的生成式 AI 以提高企業生產力。

據預測,到 2026 年,有 50% 以上的邊緣應用也會采用 AI 技術。到 2028 年,還將有 80% 以上的 PC 會轉換成 AIPC,通過 AI 提升桌面端生產力。

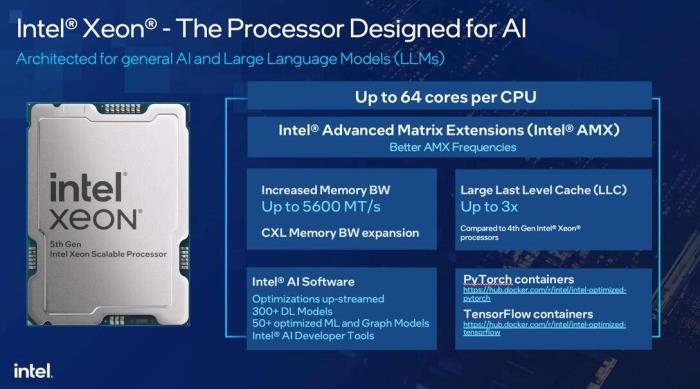

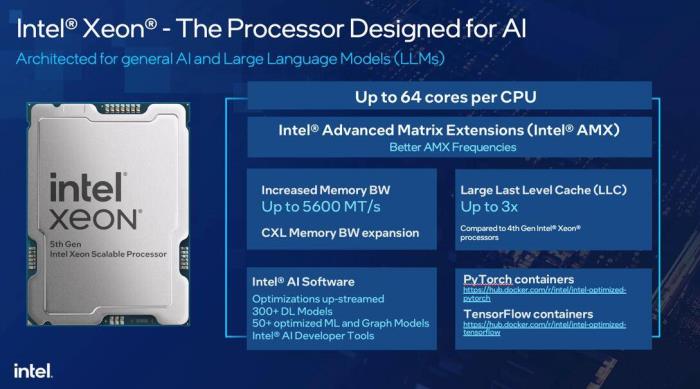

在這樣的背景下,英特爾去年底發布了第五代英特爾至強可擴展處理器。與上代產品相比,其在核心數,以及多種性能指標上都有很大提升。第五代至強最多搭載 64 核心,英特爾通過 AI 相關的新指令集,如 AMX、AVX 等進一步提高了性能,這些性能提升對一些生成式 AI 應用帶來了很大幫助。

在 AI 相關的參數上,新一代服務器芯片也有了提升。第五代至強在業界數據中心級的處理器當中,擁有較高內存帶寬,達到 5600MT/s,也增加了三倍三級緩存。

隨第五代至強的發布,英特爾在深度學習社區已貢獻了超過 300 個模型,也支持了 50 個以上對新一代 CPU 優化過模型。此外,英特爾也加大了對主流大模型、AI 框架優化兼容的投入,讓使用 PyTorch 和 TensorFlow 開發的資產可以無縫拓展至英特爾至強可擴展處理器上。

基于硬件和軟件的優化,第五代至強和上代相比在 AI 訓練、實時推理、批量推理上,基于不同的算法,都可以獲得不同程度的性能提升,最高能達到 40%。

活動中,英特爾展示了通用服務器熱門生成式 AI 大模型,如 GPT-J(6B)和 Llama2(13B)在一些通用場景中推理上的性能。

在聊天機器人、內容生成、代碼生成或搜索等應用上,第五代至強從性能上可以滿足應用需求,second token 生成的響應時間小于 100ms。

在滿足 AI 應用的同時,使用 CPU 進行大模型推理也可以在性價比上滿足需求,不論是在 BF16 或 int8 精度上,英特爾展示的用例都可以滿足 100ms 的需求。

第五代至強可擴展處理器的性能同時得到了合作伙伴的驗證。阿里云、百度云分別論證了基于第五代至強能夠運行 Llama2 70B 參數的推理。實踐證明使用第五代至強,在 Llama2 70B 參數的模型下,通過一個四節點的服務器,可以達到 87.5 毫秒的推理延遲性能。

有合作伙伴認為,在全盤考慮部署和運維成本等因素后,企業導入基于至強的生成式 AI 服務,如聊天機器人、知識庫問答等基礎的大模型使用,比基于服務器的云服務的初期導入成本低一半左右。

英特爾表示,在模型調優、推理和應用上,使用基于 CPU 的通用服務器是具有性價比的選擇。尤其是當企業面臨多種任務負載,如聊天機器人、內容生成、摘要分析等時。目前,百度云基于第五代至強 CPU 的服務器已在提供大模型服務。在京東基于第五代至強的應用中可以看到,和前一代的處理器相比,在 Llama2 13B 的模型上,獲得了 50% 的性能提升。

「整體來看,在一些通用型應用,如會議紀要提取、大綱總結、內容分析,以及一些生成任務,尤其是最近較熱門的文生圖、聊天機器人、代碼生成等生產力提升的應用中,使用通用算力,尤其是基于第五代至強的服務器是具有優勢的,」英特爾市場營銷集團副總裁、資深技術專家莊秉翰表示。「因此,我們非常有信心能夠滿足生成式 AI 模型的更多工作負載需求。」

在活動中,英特爾分享了未來至強可擴展處理器的發展路線圖。

基于現在的第五代至強,英特爾計劃發布下一代的性能核,也就是高主頻、高性能的 CPU 核架構,為主流和復雜的數據中心的應用進行性能優化。面向目前流行的虛擬算力機制,用戶可以獲得非常好的性能提升。

同時對于新興的,尤其是基于云原生的設計,英特爾提供能效核設計,每瓦性能可以做到相對極致,因為該版本核心較為精簡,可以提高 CPU 和服務器的核心密度,所以它會支持面向云的高密度超高能效運算進行優化。

值得關注的是,英特爾近兩年保持著密集的新產品發布節奏。該公司表示,在強大的執行力推動下,未來產品的研發和推出進度均在按期進行。

- 免責聲明

- 本文所包含的觀點僅代表作者個人看法,不代表新火種的觀點。在新火種上獲取的所有信息均不應被視為投資建議。新火種對本文可能提及或鏈接的任何項目不表示認可。 交易和投資涉及高風險,讀者在采取與本文內容相關的任何行動之前,請務必進行充分的盡職調查。最終的決策應該基于您自己的獨立判斷。新火種不對因依賴本文觀點而產生的任何金錢損失負任何責任。

新火種

2024-11-17

新火種

2024-11-17