字節版Sora火爆24小時,同名論文再次被熱議

“不需要再等OpenAI的鴿王Sora了”。?

字節版Sora終于來了,這一次還憋了個大的——

一口氣推出Seaweed和PixelDance兩款豆包視頻模型,支持文生/圖生視頻,時長可達10s。

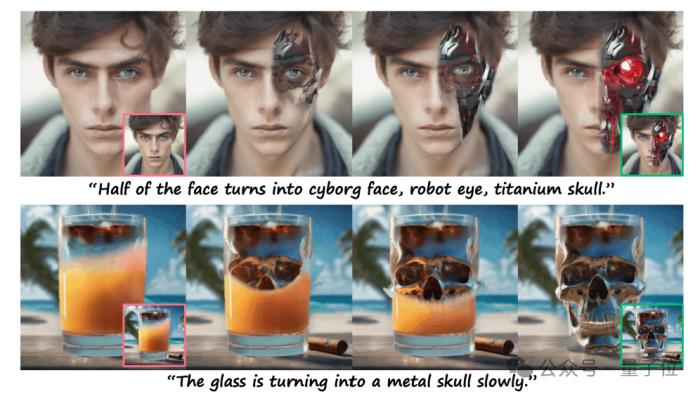

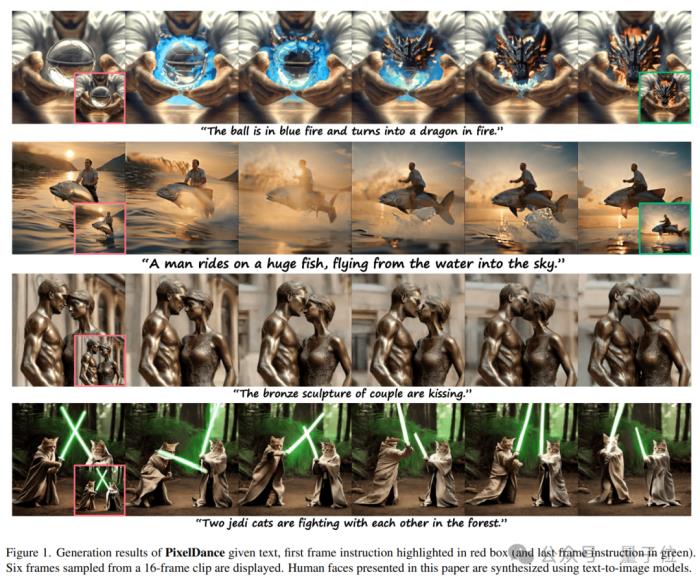

以PixelDance為例,其最大特色在于多主體交互,一致性多鏡頭生成。

啥意思??——直接來看幾個官方demo。

First kill,現在手上有這樣一張原圖:

若使用當前大多視頻模型,一般只能進行到“摘墨鏡”這個環節;而PixelDance能解鎖時序性多拍動作指令。(摘完墨鏡還能站起來,并走向雕像)

還有類似電視劇的飆戲名場面(多個主體),各自眼神、動作,一整個拿捏。

Double kill,飽受吐槽的PPT動畫有新解了。PixelDance擁有變焦、環繞、平搖、縮放、目標跟隨等多鏡頭話語言能力。

關鍵來了,在一致性方面,PixelDance號稱能10秒講述完整故事。

說人話就是,在一句提示詞內,實現多個鏡頭切換,同時保持主體、風格和氛圍的一致性。

另外,PixelDance支持多種風格比例。(說你呢Runway)

小結一下,字節版Sora這次主打多主體交互、酷炫運鏡、一致性多鏡頭以及多風格比例。

發布會一結束,網友們的期待值也是拉滿了,嗷嗷待哺內測資格!

與此同時,字節研究團隊一篇PixelDance同名論文,也被扒了出來,再次引發熱議。???

背后論文揭示「PixelDance」原型??

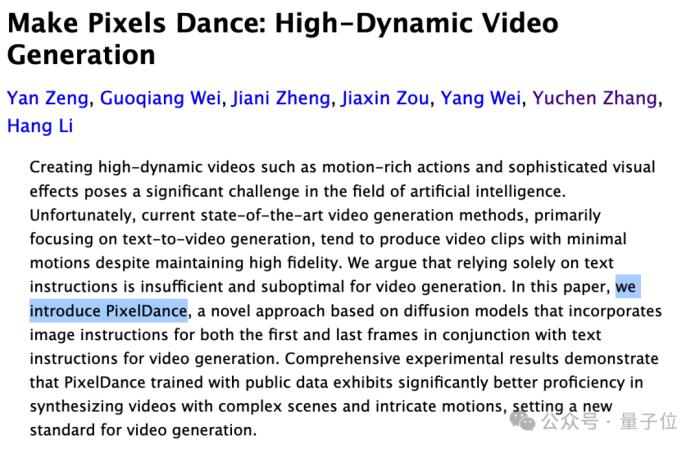

背后論文揭示「PixelDance」原型??字節團隊此前入選CVPR 2024的論文,就提出了名為一種PixelDance的模型。?

先劃重點,團隊采用的方法可以概括為:

首先,團隊采用廣泛使用的2D UNet作為擴散模型,該模型由一系列空間下采樣層和一系列空間上采樣層構建,并插入了跳躍連接。

具體來說,它由兩個基本模塊構建,即2D卷積模塊和2D注意力模塊。

通過插入時間層將2D UNet 擴展為3D變體,其中在2D卷積層之后插入1D時間卷積層,2D注意力層之后插入1D時間注意力層。

模型可以通過圖像和視頻聯合訓練,在空間維度上保持高保真生成能力。

不過對于圖像輸入,1D時間操作被禁用。團隊在所有時間注意力層中使用雙向自注意力。

其次是指令注入。具體來說,PixelDance基于<文本,首幀,尾幀>指令。

文本指令源于使用詳細的文本注釋以精確描述視頻的幀和動作首幀圖像指令描述了視頻片段的主要場景尾幀圖像指令(在訓練和推理過程中可選使用)描繪了視頻片段的結尾,并提供了額外的控制

這里要插一句,與文本指令相比,圖像指令更加直接且易于獲取——使用真實視頻幀作為訓練中的圖像指令。

據了解,文本指令由預訓練的文本編碼器編碼,并通過交叉注意力融入擴散模型。

圖像指令由預訓練的VAE編碼器編碼,并與受擾的視頻潛變量或高斯噪聲一起作為擴散模型的輸入。

在訓練過程中,團隊使用(真實的)首幀指令來強制模型嚴格遵循該指令,從而保持連續視頻片段之間的一致性。

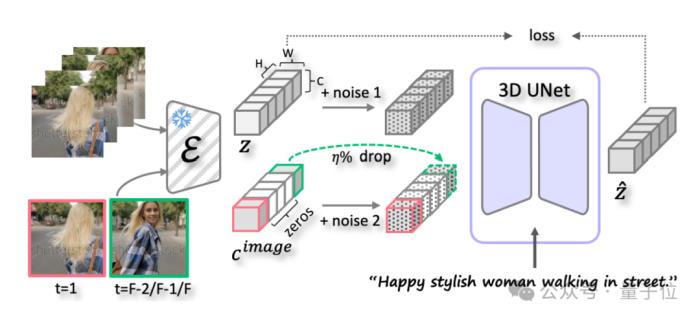

當然了,PixelDance獨特之處在于使用尾幀指令的方式。

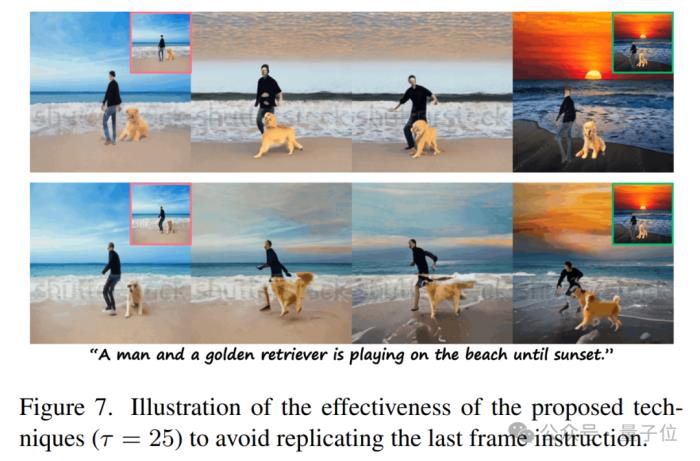

簡單說,團隊有意避免讓模型完全復制尾幀指令,因為在推理過程中提供一個完美的尾幀是很困難的,模型應該能夠處理用戶提供的粗略草稿,并作為指導。

為了實現這一點,團隊開發了三項技術:

1、在訓練過程中,尾幀指令是從視頻片段的最后三幀(真實的)中隨機選擇的。2、向指令中引入了噪聲,以減少對指令的依賴性并提高模型的魯棒性。3、在訓練中以一定概率(例如 25%)隨機丟棄尾幀指令。

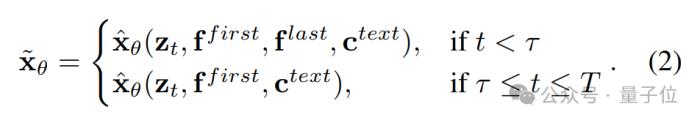

相應地,團隊提出了一種簡單但有效的推理策略。

概括起來就是,在前τ次去噪步驟中,利用尾幀指令引導視頻生成朝向期望的結束狀態。

在剩余的步驟中,指令被丟棄,允許模型生成時間上更連貫的視頻。

通過調整τ,可以控制尾幀指令對生成結果的影響。

接下來,團隊在WebVid-10M數據集上訓練了視頻擴散模型,該數據集包含大約1000萬個短視頻片段——

平均時長為18秒,分辨率通常為336 × 596,且每個視頻都附有與視頻內容松散相關的文本描述。

不過WebVid-10M存在一個問題,即所有視頻上都帶有水印,這導致生成的視頻中也會包含水印。

因此,團隊將訓練數據擴展為另外自收集的50萬個無水印視頻片段,它們包含真實世界的實體,如人類、動物、物體和風景,并附有粗粒度的文本描述。

盡管這一額外數據集只占了很小比例,但團隊驚訝地發現:

最終,PixelDance在視頻-文本數據集和圖像-文本數據集上進行聯合訓練。

對于視頻數據,從每個視頻中隨機采樣16個連續幀,每秒4幀。

此外,按照之前的工作,采用LAION-400M作為圖像-文本數據集;每8次訓練迭代使用一次圖像-文本數據。

自論文發布之后,到產品上線這段時間具體又做了哪些改進,目前還不得而知。

由于剛發布,目前只能簡單看到官方提及:

感興趣的話可以親自上手試一試來感受一下,目前豆包視頻模型已在火山引擎開啟企業用戶的邀請測試;個人用戶可在字節旗下的即夢AI申請內測。

官方聲稱,未來將逐步開放給所有用戶。

那么,你期待這次的字節版sora嗎?

- 免責聲明

- 本文所包含的觀點僅代表作者個人看法,不代表新火種的觀點。在新火種上獲取的所有信息均不應被視為投資建議。新火種對本文可能提及或鏈接的任何項目不表示認可。 交易和投資涉及高風險,讀者在采取與本文內容相關的任何行動之前,請務必進行充分的盡職調查。最終的決策應該基于您自己的獨立判斷。新火種不對因依賴本文觀點而產生的任何金錢損失負任何責任。

新火種

2024-10-06

新火種

2024-10-06