免費GPT-4o來襲,音頻視覺文本實現「大一統」

作者 | 賴文昕

今天凌晨,即北京時間5月14日1點整,OpenAI 召開了首場春季發布會,CTO Mira Murati 在臺上和團隊用短短不到30分鐘的時間,揭開了最新旗艦模型 GPT-4o 的神秘面紗,以及基于 GPT-4o 的 ChatGPT,均為免費使用。

此前,有傳言稱 OpenAI 將推出 AI 搜索引擎,旨在與谷歌明天舉辦的 I/O 開發者大會一較高下,一度引發了公眾的熱烈討論。

不過 Sam Altman 隨后在 X(原推特)上表示,要展示的并非 GPT-5 或搜索引擎,而是一些令人期待的創新成果,他本人對此充滿期待,認為其像魔法一樣神奇。

那么,GPT-4o 是否真的如 Sam Altman 所說,是 OpenAI 帶來的「新魔法」呢?

多模態實時語音助手,更快更全更有情感

登臺后,Mira Murati 宣布了 ChatGPT 的桌面版本和新 UI,緊接著就介紹了本場發布會的主角——GPT-4o 。

在發布會上,Mira Murati 與團隊成員 Mark Chen、Barret Zoph一起,重點展示了基于 GPT-4o 的 ChatGPT 在不同任務中的實際表現,尤其展現了其語音能力。

若用關鍵詞加以總結,搭載 GPT-4o 的 ChatGPT 可謂是又快、又全、又有情感。

與 ChatGPT 對話時,用戶不必等 ChatGPT 說完,可以隨時插話;模型能夠實時響應,不存在尷尬的幾秒延遲。

在 Mark 表示自己很緊張且捕捉到他急促的呼吸后,ChatGPT 還會提醒需要冷靜情緒,識別其呼吸節奏并引導他做深呼吸。

模型能夠以各種不同的風格生成聲音。無論對話時讓 ChatGPT 用唱歌的方式、機器人機械音還是戲劇化的語氣講故事,它都能迅速反應并輸出。

基于 GPT-4o 強大的視覺能力,用戶還可以語音讓 ChatGPT 分析頁面上的數據圖表。

更強大的是,打開攝像頭后寫下一道數學題,ChatGPT 還會一步步引導該如何解下一步,其講解的清晰度與耐心堪比幼教。

ChatGPT的「同傳能力」也不容小覷,OpenAI 團隊還在現場展示了一波英語和意大利語的實時互譯,中間實現零延遲。

更有意思的是,ChatGPT 在對話中還會使用語氣詞,甚至是向 OpenAI 團隊開玩笑和表達感謝。在「看到」他們寫下「我愛 ChatGPT」的文字后,ChatGPT 甚至會在發出撒嬌的聲音后,再表揚其貼心。

ChatGPT 甚至還能和用戶「視頻聊天」。在演示中,Barret 讓 ChatGPT 猜測自己的情緒,在他開始露出笑臉后,ChatGPT 直接語音回復「你看起來很開心,笑容燦爛,還有點激動。」

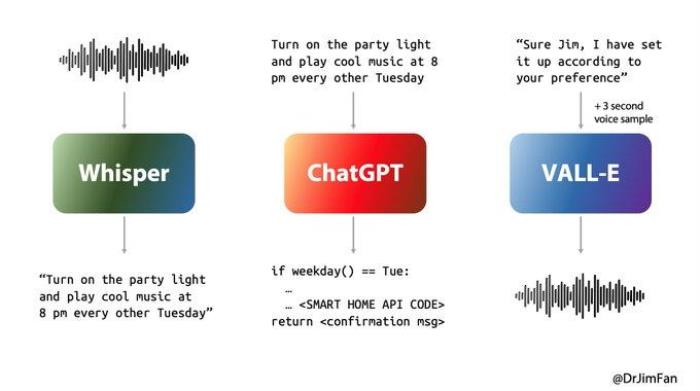

英偉達首席 AI 科學家 Jim Fan 曾講述過當前實時語音助手(如 Siri )的困境,即很難創造出沉浸式的使用體驗。

用戶在和 AI 語音助手對話時要經歷三個階段:語音識別(ASR),將音頻轉換為文本,例如 Whisper;大語言模型(LLM)規劃接下來的話語,將第一階段的文本轉換為新的文本; 語音合成(TTS),將新文本轉換回音頻,如 ElevenLabs 或 VALL-E 。

如果簡單地按順序執行,就會產生巨大的延遲,特別是當每一步都需要等待幾秒時,用戶體驗就會急劇下降,哪怕合成的音頻聽起來非常真實,也會讓用戶格外「出戲」,就更別提沉浸式的使用體驗了。

以往的 ChatGPT 語音模式也是如此,依賴三個獨立模型工作,平均延遲時間為 2.8 秒 (GPT-3.5) 和 5.4 秒 (GPT-4),語音助手也總會出現信息丟失,既不能判斷語調、多個說話者或背景噪音,也不能輸出笑聲、唱歌或表達情感。

而現在,GPT-4o 的音頻輸入響應時間最短為232毫秒,平均響應時間為320毫秒,與人類在對話中的反應時間極為相似。

作為一個全新的單一模型,GPT-4o 能端到端地跨文本、視覺和音頻,所有輸入和輸出都由同一個神經網絡處理,直接一步到位,在用戶輸入后(文本、語音、圖像、視頻均可)直接生成音頻回答。

GPT-4o ,一款免費的全能 GPT-4

Mira Murati 在發布會上表示,GPT-4o 最棒的地方在于,它將 GPT-4 的智能提供給每個人,包括免費用戶,將在未來幾周內迭代式地在公司產品中推出。

GPT-4o 中的字母 o 指 omni,在拉丁語詞根中是「全」的意思,是涵蓋了文字、語音、圖片、視頻的多模態模型,接受任何模態的組合作為輸入,并能生成任何模態的組合輸出。

據 OpenAI 官網,GPT-4o 不僅在文本和代碼處理的性能上與GPT-4 Turbo持平,而且在 API 調用上速度更快,價格更是降低了50%。

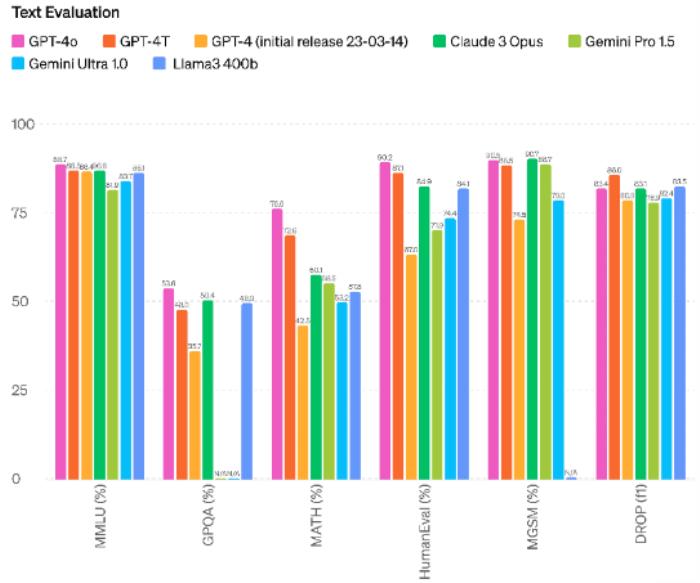

文本能力測試

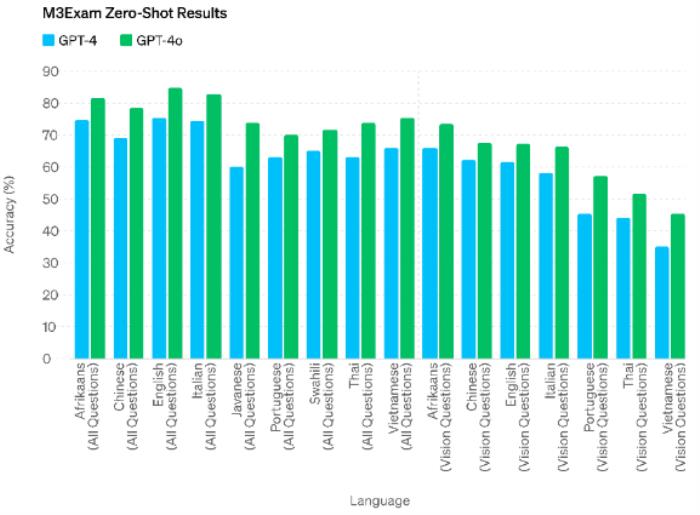

與GPT-4對比多語言考試能力

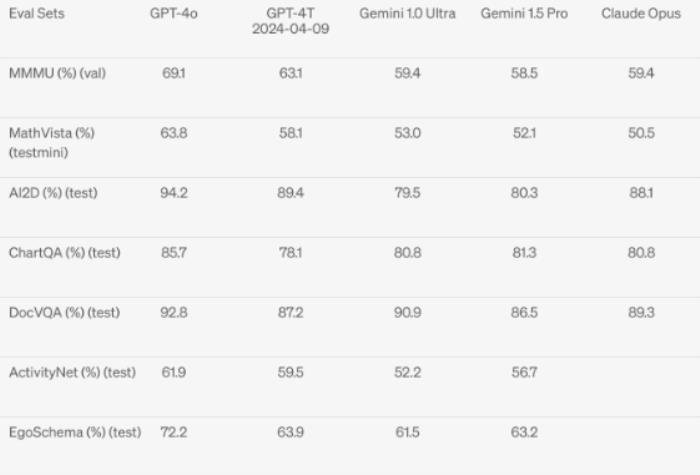

更重要的是,GPT-4o 的視覺理解能力在相關基準上取得了壓倒性的勝利。

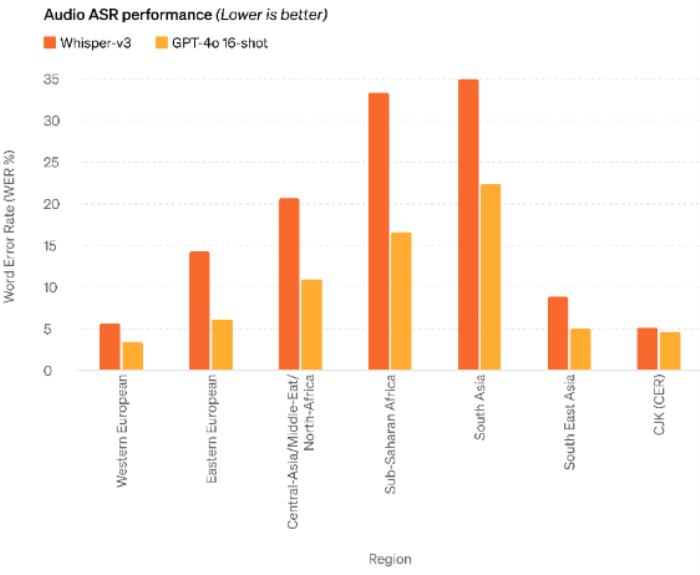

在音頻方面,GPT-4o 的語音識別(ASR)也比 OpenAI 的語音識別模型 Whisper 性能更佳(越低越好)。

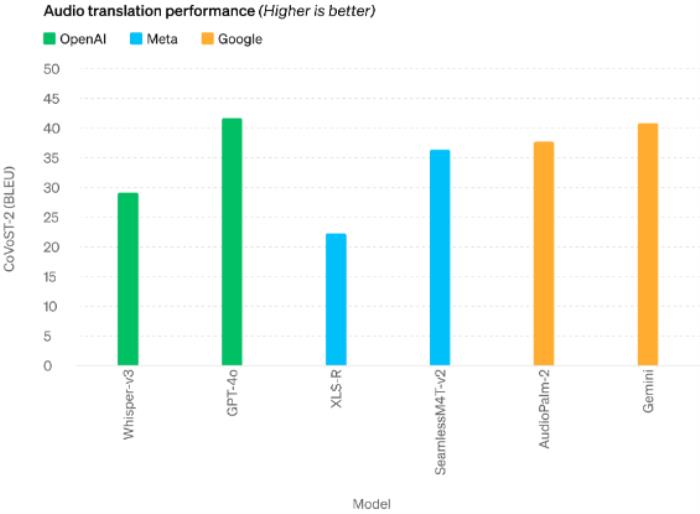

與 Meta、谷歌的語音轉寫模型相比,GPT-4o 同樣領先(越高越好)。

若落實到實際生活的使用中,GPT-4o 究竟能給普羅大眾帶來什么變化呢?

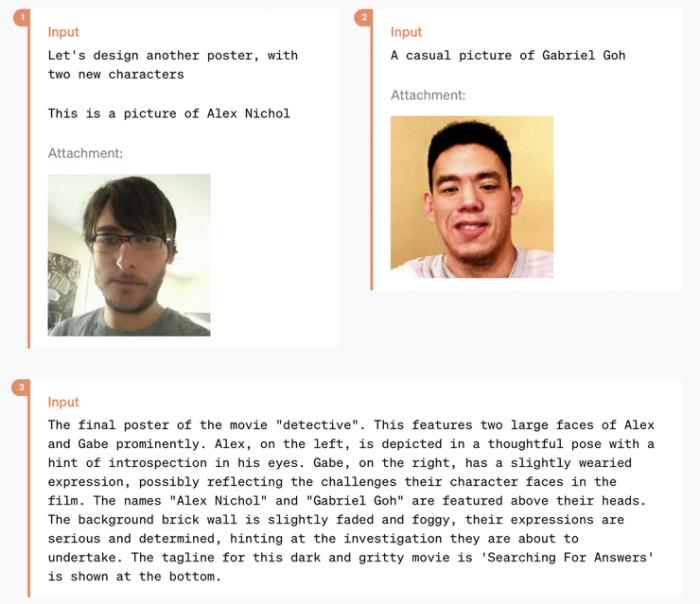

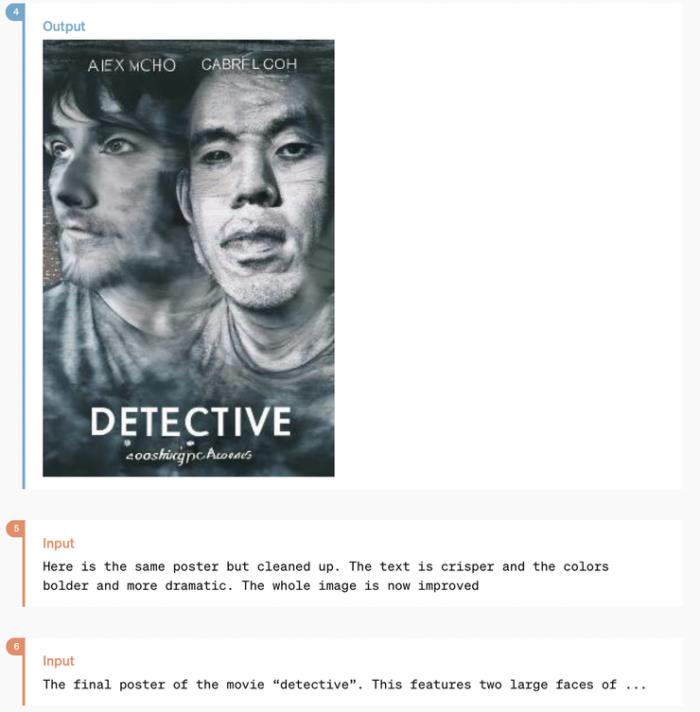

OpenAI的官網展示了 GPT-4o 在海報創作、三維重建、字體設計、會議總結等等一系列充滿可能性的應用。

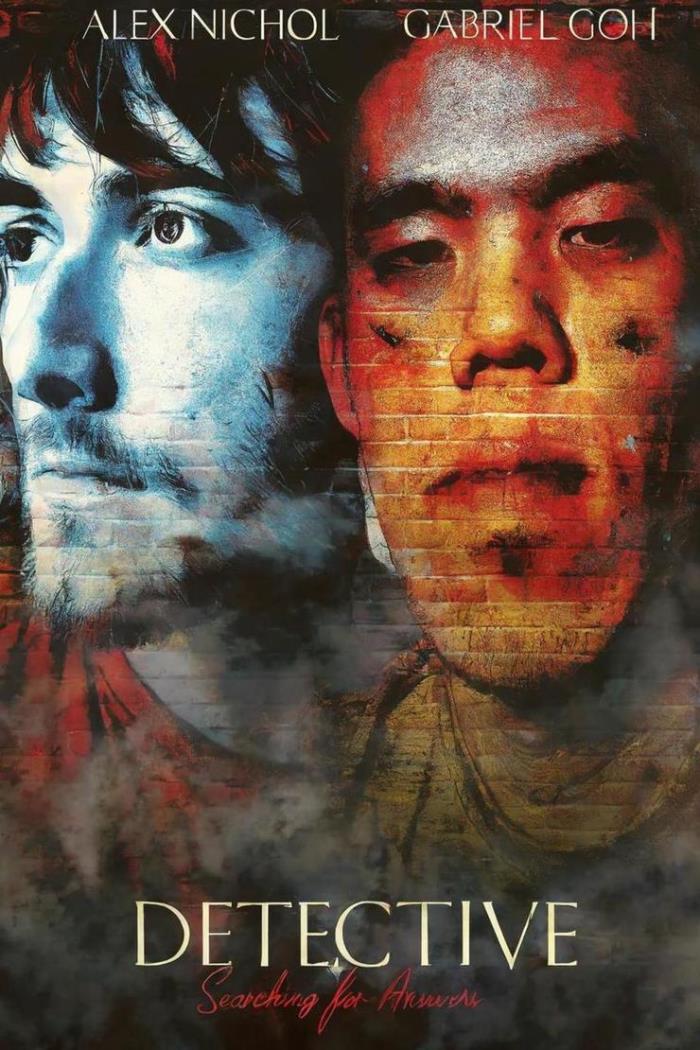

比如,在輸入人物圖片、海報元素以及想要的風格后,GPT-4o 就能給用戶生成一張電影海報。

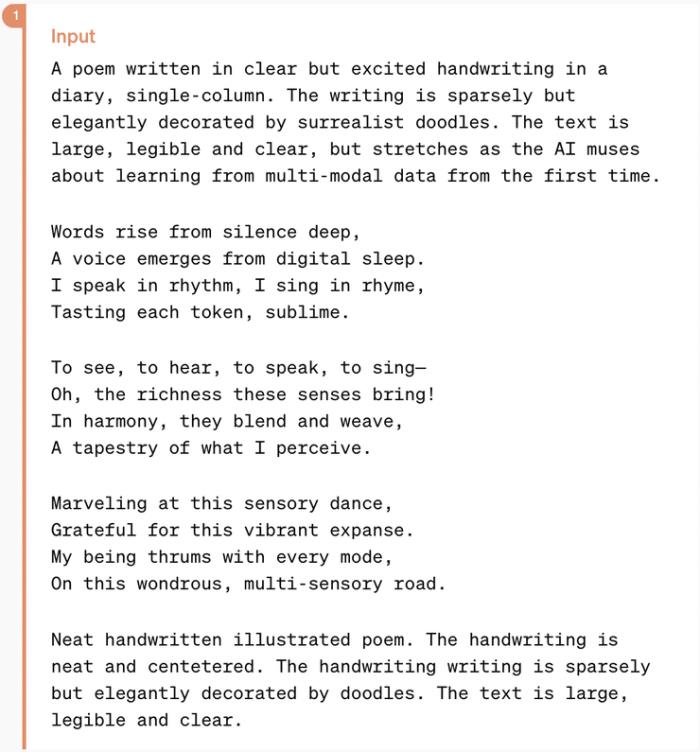

或者,根據輸入的詩歌文本,GPT-4o 能生成用手寫體寫著詩歌、畫著畫的單行本圖片。

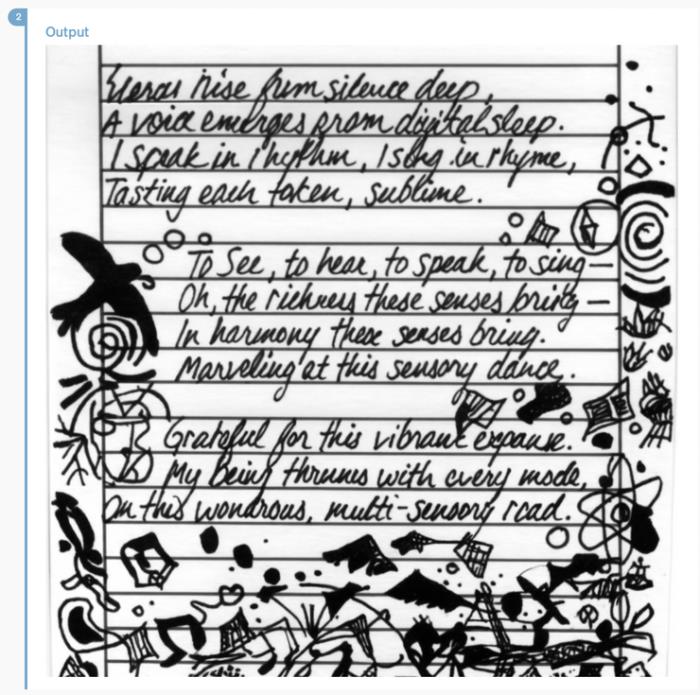

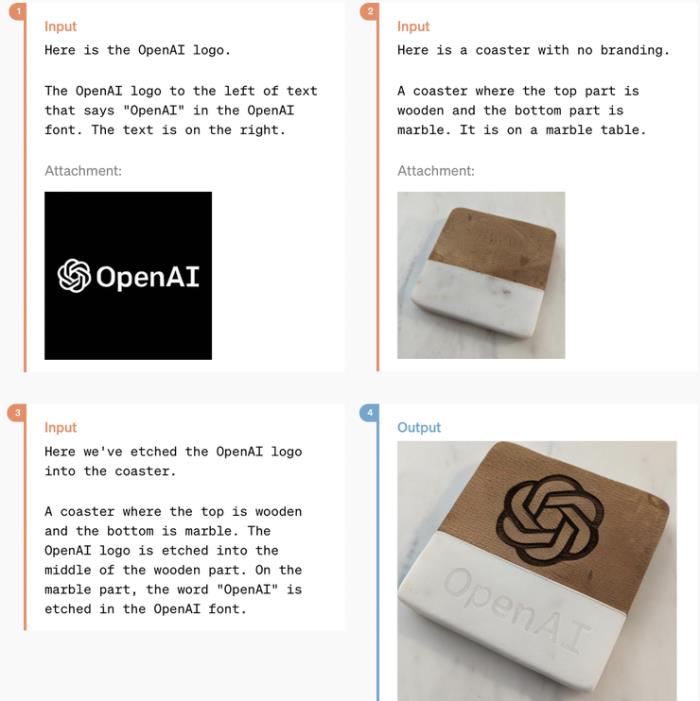

在輸入6張 OpenAI 的 logo圖后,GPT-4o 能三維重建出其立體動圖。

甚至還可以讓 GPT-4o 幫忙把 logo 印在杯墊上。

「今天,有 1 億人使用 ChatGPT 來創作、工作、學習,以前這些高級工具只對付費用戶可用,但現在,有了 GPT-4o 的效率,我們可以將這些工具帶給每個人。」Mira Murati 如是說道。

寫在后面

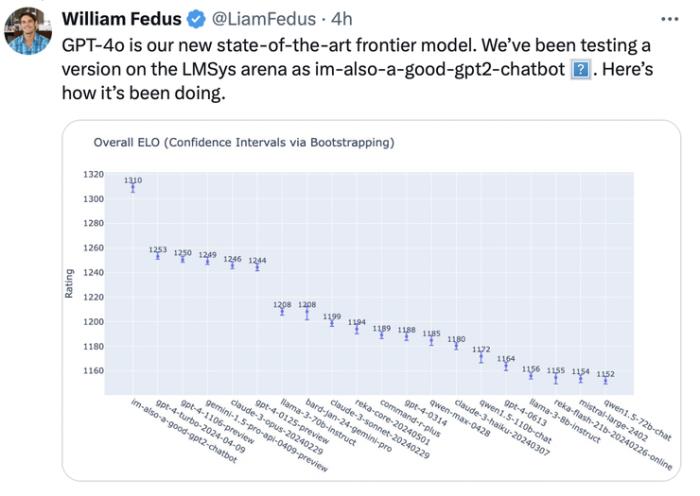

發布會之外,OpenAI 研究員 William Fedus 透露,此前在大模型競技場參與A/B測試并碾壓全場的模型「im-also-a-good-gpt2-chatbot」,就是本次登場的 GPT-4o 。

截至2024年3月,OpenAI 在不到十年的運營時間內,已經完成了10輪的融資,累計籌集資金超過了140億美元,其估值在2月的融資交易中已經飆升至800億美元。

伴隨著狂飆的市值,OpenAI 的技術版圖已經橫跨了多個 AI 的關鍵領域,形成了一個全面而深入的產品矩陣。

API 產品線提供了包括 GPT 模型、DALL·E 模型、Whisper 語音識別模型在內的多樣化服務,并通過對話、量化、分析、微調等高級功能,為開發者提供技術支持;ChatGPT 為核心的產品線分別推出了個人版和企業版。

在音樂生成領域,OpenAI 也有一定的技術積累,比如經過訓練的深度神經網絡 MuseNet,可預測并生成 MIDI 音樂文件中的后續音符,以及能生成帶人聲音樂的開源算法 Jukebox。

再加上年初春節假期期間毫無征兆推出的 AI 視頻生成大模型 Sora,更是讓網友們感嘆「現實,不存在了。」

毋庸置疑,OpenAI 是大模型這場擂臺賽中當之無愧的擂主,其技術與產品的迭代更是整個行業的風向標,不少大模型創業者都遇過「OpenAI 不做,沒人投;OpenAI 一做,人人投」的融資奇觀。

但隨著 Claude 3 和 Llama 3 的緊追與 GPT Store 上線2個月慘遭「滑鐵盧」,不少 AI 行業從業者開始對 OpenAI 祛魅,認為「大模型護城河很淺,一年就趕上了。」

現在看來,OpenAI 果然還是 OpenAI。

本文作者 anna042023 將持續關注AI大模型領域的人事、企業、商業應用以及行業發展趨勢,歡迎添加作者交流,互通有無。

- 免責聲明

- 本文所包含的觀點僅代表作者個人看法,不代表新火種的觀點。在新火種上獲取的所有信息均不應被視為投資建議。新火種對本文可能提及或鏈接的任何項目不表示認可。 交易和投資涉及高風險,讀者在采取與本文內容相關的任何行動之前,請務必進行充分的盡職調查。最終的決策應該基于您自己的獨立判斷。新火種不對因依賴本文觀點而產生的任何金錢損失負任何責任。

新火種

2024-05-15

新火種

2024-05-15