Sora還沒開源,但這家國產AIGC視頻公司已經靠還原現實賺錢了

最近AIGC的落地,又有了一些熱議和爭論。

在金沙江創投主管合伙人朱嘯虎的爆款采訪中,他表達了對自研大模型商業閉環的悲觀,但又堅定地表示非常看好應用,“我信仰AGI,但我信仰應用啊,信仰能馬上商業化的。”

在他的犀利表達中,一家應用公司意外走紅。

它就是AIGC視頻廣告公司FancyTech(時代涌現)。

對國內大模型五小虎不愿一看的朱嘯虎,提到FancyTech,真的是不吝溢美之詞,直夸很酷。

夸它什么呢?主要是兩點,一是效果好,二是能馬上變現。

FancyTech商業成績如何,還要等我們進一步挖掘;而論效果,我們搜尋來了網上的視頻,確實不錯。

但誰會只相信品牌放出的demo呢(手動狗頭)???

搜索之下,我們發現FancyTech的免費測試鏈接——那還等什么,直接沖啊。

FancyTech真的fancy嗎?

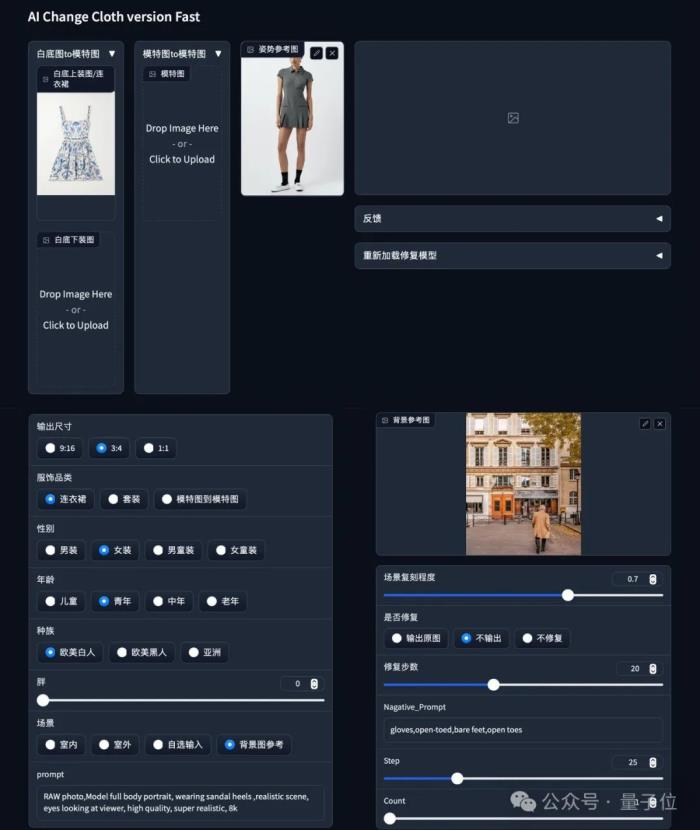

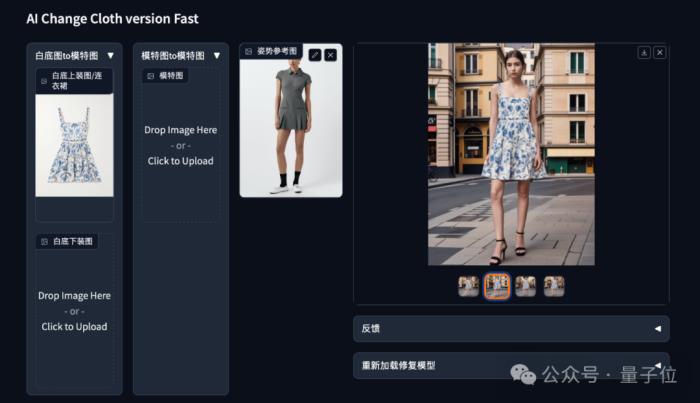

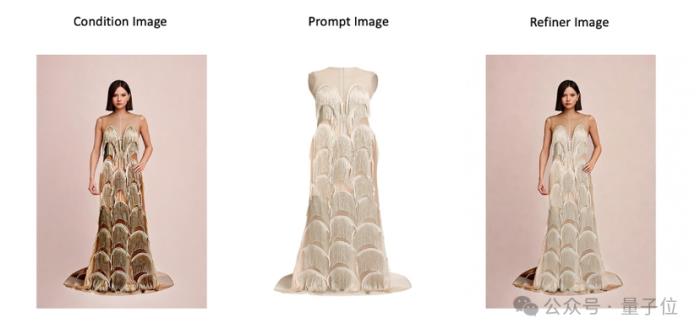

實測第一站,我們率先體驗的是FancyTech還原現實的換裝功能。

簡單來說就是基于一張商品圖,可以生成模特上身圖,并且是能自定義姿勢、自定義背景、自定義臉的那種。

說實話,AIGC的風這么大,給模特換裝已經不是啥稀奇功能了,甚至這一塊的開源力量也不小。

但之前接觸過類似Google的Tryon Diffusion等,都沒有FancyTech這樣能夠進行詳細的自定義。

就上手體驗而言,FancyTech的體驗比較傻瓜式。

首先需要上傳一張服裝圖像,接著上傳可供參考的模特姿勢,同時選擇模特的性別、人種等,繼而再上傳(最少)一張背景參考圖,就能得到最終的模特上身效果。

衣服整體還原效果還是挺真實的。

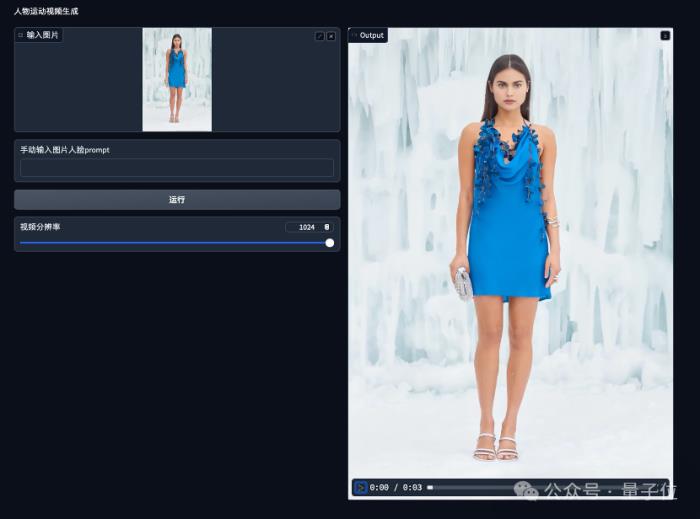

實測第二站,是FancyTech另外一個主打的功能,圖生視頻。

上傳任意一張圖片,點擊下方的運行鍵即可。

等待時間大概在35s左右,我們得到了這樣一個效果:

模特有眨眼動作,肢體中心也有自然的輕微轉移,商品、模特都沒有變形。

我們還試著多跑幾次,每次出來的效果都很穩定。

而相同的事情丟給同為AIGC視頻生成工具的Pika干,得到的效果是這樣的:

動作幅度更大,但商品細節似乎有模糊處理。不知是否是模特表情夸張引起的五官變形,恐怖谷效應撲面而來。

兩者對比,能看出FancyTech生成的視頻結果在商品實物還原方面,還是很能打的。

為了試驗它的效果穩定與否,我們又對比了一組。

這是FancyTech的效果:

這是Pika的效果:

這一組效果也都還不錯,并且能感受到,FancyTech也可以有較大的人物動作幅度,有接近真人模特的動作展示,視頻時間也能達到4s左右。

在給品牌使用的流程上,這些生成都是自動化的,從生成圖片到視頻、再到發布,都不需要人工參與。

就怎么說呢,跟某寶上售賣服裝配的展示視頻好像也沒差?

看了一下別人利用FancyTech做出的商品廣告,比我們這種純小白做的,那是酷炫多了。

最最重要的是,看起來不穿幫,對現實場景有比較好的還原,不會一眼假是AI做的:

技術上是如何實現的?

親身體驗下來,FancyTech是有兩把刷子在身上的。

定位也很明晰:聚焦電商和廣告視頻領域,利用AI驅動生成商品表達視頻,能基于用戶反饋調整視頻細節,還能附帶畫外音、音樂、字幕等。

而且與市場上很多的AI視頻生成工具,包括Sora、Pika等在內,FancyTech采用的方式不是文字生成視頻,而是圖片生成視頻。

但這樣的AIGC視頻生成效果,背后究竟是通過什么原理實現的?是基于某些開源方案打造,還是重新純自研?

帶著種種問題,我們向FancyTech求解了一下背后的技術細節。

“FancyTech是自研的全鏈路底層技術,然后配合工程化能力。”對方倒也沒藏著掖著,直接亮出來了自家的技術實現方案。“我們學習了大量的熱門視頻,自研的模型來寫腳本,再通過AI Agent串聯各模型生成視頻。”

整體來說,FancyTech的工作流包含以下三個組成部分:

視頻模型:生成素材,提升素材豐富度;AI Agent:自動化生成,提升交付效率;數據效果反饋:自動優化素材,提升發布效果。

三者形成循環,實現數據驅動,達到持續優化視頻生成效果的目的。

更進一步的,我們則就最基本的視頻模型方面進行了了解。

以前,AI無法真正取代商品展示拍攝,是因為效果不盡人意,尤其是難以模擬3D場景的真實動態。

但看看剛才親自試出來的效果,不管是連衣裙本身面料和重量帶來的垂墜感,還是模特動作變換導致的裙擺擺動,FancyTech都能展現出自然效果。

是怎么做到的呢?

一是FancyTech自己組建了數據標注團隊,在訓練過程中收集了大量的真實數據,進行清洗、標注,從而擁有了質量夠高的數據集。

這樣一來,就非常有利于最終產出優質效果的視頻。

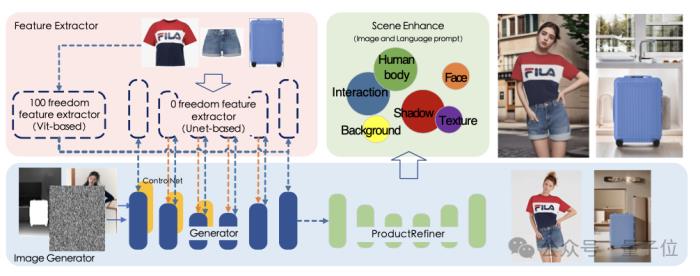

二是構建覆蓋多類型商品的場景圖生成框架,實現全自動化、多品類、多種組合搭配的商品生成、場景生成、細節復原與增強。

為了精確保持商品細節并進行合理變化,FancyTech還自研了圖像特征提取器,將圖像特征分成100自由度(合理變化)和0自由度特征(保持細節)。

第四點是,針對不同商品和細分品類,團隊訓練了自己的多模態(文+圖)圖像生成模型DeepVideo。

在自研模型的基礎上,FancyTech團隊采用元學習和強化學習的訓練方案,持續提升不同控制條件下的泛化能力。

第五點也是FancyTech著重強調介紹的一點,是團隊自研商品細節增強模型,ProductRefiner。

ProductRefiner負責的功能是加強細節復原,此外,還能描述輸入可選細節,進一步提升商品細節展現。

在訓練過程中,ProductRefiner選用了自監督訓練方法,無需構建成對數據集,極大地降低了成本。

而且能對模特的上身和下身著裝進行分割,在保證輸入圖像背景不變的前提下,對上衣和下衣進行修復和還原。

阿里系創始團隊

就在這樣的技術加持下,去年一年,FancyTech和超過500個國內外品牌進行合作,日均生成視頻量超過10萬。

而且根據朱嘯虎公開的說法,FancyTech是在賺錢的:去年收入達到5000多萬,(比他投資時的2022年)漲了五六倍。

在基礎大模型業務商業化路徑仍然不分明的時候,聚焦特別場景,能有這樣一個成績,FancyTech背后團隊究竟是什么來歷?

據新火種了解,成立于2020年的FancyTech,背后是一支阿里系團隊。

其創始人兼CEO,William Li,花名空界,曾是天貓奢品Luxury Pavilion初代負責人,也在手機淘寶歷任分享平臺和用戶社群的產品運營負責人。

創始團隊的其他成員,也都來自于手淘、天貓、阿里云等資深算法、運營及技術崗位。

看到這里,你一定也對FancyTech能深諳電商展示玩法不足為奇了。

現在,成立快4年的FancyTech已經將算法團隊擴大至近百人規模,其中算法團隊近20人,數據標注團隊約50人。

在我們聯系上FancyTech的時候,這支隊伍剛剛對產品進行了一次迭代,視頻長度從原來的2s,拓展至4s左右。

那么,有技術,有市場,有商業化,FancyTech的下一步又有什么打算?

新火種得到的答案是這樣的:Sora的出現,把其他所有的視頻模型公司都打回了同一起跑線上——這對我們來說反而有利。

我們走商業化路線,追求的是商品的還原,而Sora驗證了下一步該怎么樣去增強持續性。

目前,FancyTech內部算法團隊已經開始投入自家Transformer+Diffusion框架的研發,預計在今年4、5月份會拿出成果。

是的沒錯,盡管有了Sora那樣驚艷世人的模型出場,FancyTech的目標倒是一直沒變過:

“我們希望成為長視頻賽道里,對現實還原得最好的公司。”

- 免責聲明

- 本文所包含的觀點僅代表作者個人看法,不代表新火種的觀點。在新火種上獲取的所有信息均不應被視為投資建議。新火種對本文可能提及或鏈接的任何項目不表示認可。 交易和投資涉及高風險,讀者在采取與本文內容相關的任何行動之前,請務必進行充分的盡職調查。最終的決策應該基于您自己的獨立判斷。新火種不對因依賴本文觀點而產生的任何金錢損失負任何責任。

新火種

2024-03-12

新火種

2024-03-12