科學(xué)家構(gòu)建多模態(tài)LLM框架,進(jìn)行3D腦CT放射學(xué)報(bào)告生成

編輯 | 爛菜葉

多模態(tài)大型語(yǔ)言模型 (MLLM) 已經(jīng)改變了現(xiàn)代醫(yī)療保健的格局,其中自動(dòng)放射學(xué)報(bào)告生成 (RRG) 正在成為一種尖端應(yīng)用。

雖然基于 2D MLLM 的 RRG 已經(jīng)得到充分認(rèn)可,但其在 3D 醫(yī)學(xué)圖像中的實(shí)用性仍未得到充分開發(fā)。

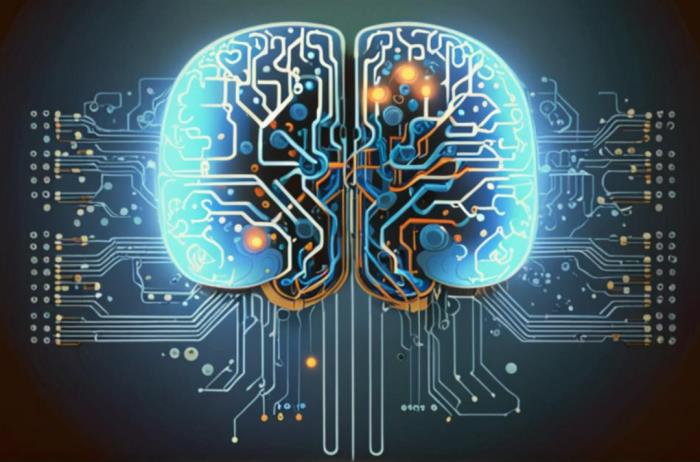

在這方面,臺(tái)北榮民總醫(yī)院(Taipei Veterans General Hospital)、臺(tái)灣陽(yáng)明交通大學(xué)(National Yang Ming Chiao Tung University)以及美國(guó)加州大學(xué)的研究人員整理了 3D-BrainCT 數(shù)據(jù)集(18,885 個(gè)文本掃描對(duì))并開發(fā)了 BrainGPT,這是一種專為 3D CT RRG 設(shè)計(jì)的臨床視覺指令調(diào)整 (CVIT) 模型。

該團(tuán)隊(duì)還提出了面向特征的放射學(xué)任務(wù)評(píng)估 (FORTE),這是一種捕捉生成報(bào)告的臨床本質(zhì)的評(píng)估方案。

測(cè)試表明 BrainGPT 的平均 FORTE F1 得分為 0.71(degree?=?0.661; landmark?=?0.706; feature?=?0.693, and impression?=?0.779),并且在類圖靈測(cè)試中,74% 的 BrainGPT 生成的報(bào)告與人類書寫的基本事實(shí)無(wú)法區(qū)分。

該研究以「Towards a holistic framework for multimodal LLM in 3D brain CT radiology report generation」為題,于 2025 年 3 月 6 日發(fā)布在《Nature Communications》。

現(xiàn)代醫(yī)療保健中的人工智能 (AI) 實(shí)施徹底改變了醫(yī)院在患者診斷、疾病干預(yù)和臨床研究方面的日常實(shí)踐。雖然卷積神經(jīng)網(wǎng)絡(luò) (CNN) 已經(jīng)攻克了圖像分類和特征分割方面的一些主要任務(wù),但 CNN 輸出相對(duì)受上下文限制,并且不如完整的書面診斷報(bào)告那么令人擔(dān)憂。

鑒于這一臨床差距,已建立了用于胸部 X 光 (CXR) 解釋的早期報(bào)告生成模型。其中,基于 LLM 的 CXR 報(bào)告生成的成功激發(fā)了跨學(xué)科領(lǐng)域科學(xué)家對(duì)人機(jī)界面的探索興趣,其中多模態(tài)大型語(yǔ)言模型 (MLLM) 可以作為醫(yī)療專家的助手。

為了評(píng)估 MLLM 在放射學(xué)報(bào)告生成 (RRG) 中的準(zhǔn)備情況,臺(tái)北榮民總醫(yī)院的研究人員調(diào)查了相關(guān)工作并確定了迄今為止 MLLM 放射學(xué)應(yīng)用中的三個(gè)客觀限制:

(1)研究最多的 CXR 模式缺乏足夠的病變多樣性來(lái)反映現(xiàn)實(shí)世界的診斷挑戰(zhàn),(2)在解釋體積掃描時(shí)尚未充分測(cè)試最大模型容量,(3)沒有可用于衡量 MLLM 報(bào)告信息密度和保真度的通用評(píng)估指標(biāo)。

新方案

這些未解決的問(wèn)題共同阻礙了具有影響力的醫(yī)學(xué) MLLM 的發(fā)展。在最新的研究中,該團(tuán)隊(duì)在通過(guò)解決以下問(wèn)題來(lái)提高 MLLM 在放射學(xué)中的適應(yīng)性:

(1)他們整理了一個(gè)大規(guī)模 3D 腦 CT 數(shù)據(jù)集(18,885 個(gè)文本掃描對(duì)),其中包含豐富的病變細(xì)節(jié),包括神經(jīng)元和血管 CT 特征的程度、空間標(biāo)志和診斷印象。

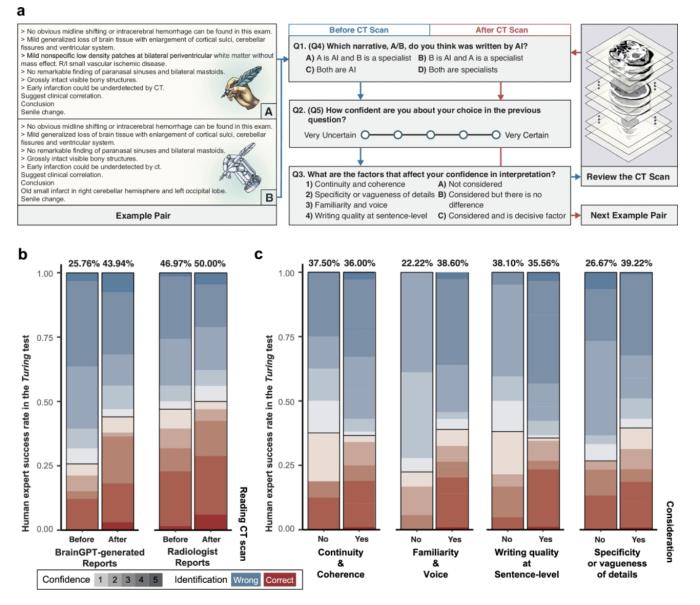

(2)研究人員提出了臨床視覺指令調(diào)整 (CVIT) 概念,以增強(qiáng)開源Otter基礎(chǔ)模型的醫(yī)學(xué)領(lǐng)域知識(shí)。在這種情況下,CVIT 增強(qiáng)型 BrainGPT 模型展示了多圖像字幕(Image Captioning)功能,并對(duì)體積腦 CT 掃描進(jìn)行了臨床合理的解釋。BrainGPT 模型的診斷準(zhǔn)確性和語(yǔ)言風(fēng)格在 CQ500 數(shù)據(jù)集上進(jìn)行了外部驗(yàn)證,并包括 11 名醫(yī)生評(píng)估員進(jìn)行類似圖靈測(cè)試的語(yǔ)言風(fēng)格評(píng)估。

(3)團(tuán)隊(duì)提出了一種面向特征的放射學(xué)任務(wù)評(píng)估 (FORTE) 評(píng)估結(jié)構(gòu),來(lái)評(píng)估 MLLM 生成字幕的應(yīng)用前景。FORTE 的變量包括診斷放射學(xué)句子中的四個(gè)基本關(guān)鍵字組成部分(程度、標(biāo)志、特征和印象)。通過(guò)進(jìn)一步檢查生成的內(nèi)容和評(píng)估分?jǐn)?shù)之間的相關(guān)性,他們建議使用句子配對(duì)和否定消除對(duì) MLLM 輸出進(jìn)行預(yù)處理可以增強(qiáng)對(duì)齊并過(guò)濾掉不相關(guān)的圖像描述。

圖示:使用 MLLM 從 3D 腦部 CT 掃描生成放射學(xué)報(bào)告的示意圖概述。(來(lái)源:論文)

性能評(píng)估與討論

之前,Hamamci 團(tuán)隊(duì)研究表明,生成模型能夠以最先進(jìn)的 (SOTA) 水平生成 3D 胸部 CT 報(bào)告(BLEU-1?=?46、BLEU-4?=?36.9、METEOR?=?29.5、ROUGE-L?=?45.9)。

然而,他們的定制 Transformer 模型需要在單個(gè) NVIDIA A100 GPU 上進(jìn)行 7 天的訓(xùn)練,而這里開發(fā)的 BrainGPT 模型只需要在兩個(gè) NVIDIA A100 GPU 上進(jìn)行 12 小時(shí)的微調(diào)。

此外,Google AI 的 Med-Gemini-3D 可以生成 3D CT 報(bào)告,但只有 53% 的報(bào)告在人體評(píng)估中被認(rèn)為具有臨床有效性。使用大規(guī)模 Google TPUv4 加速器艙的高計(jì)算成本使得這種方法不適用于資源有限的一般研究。

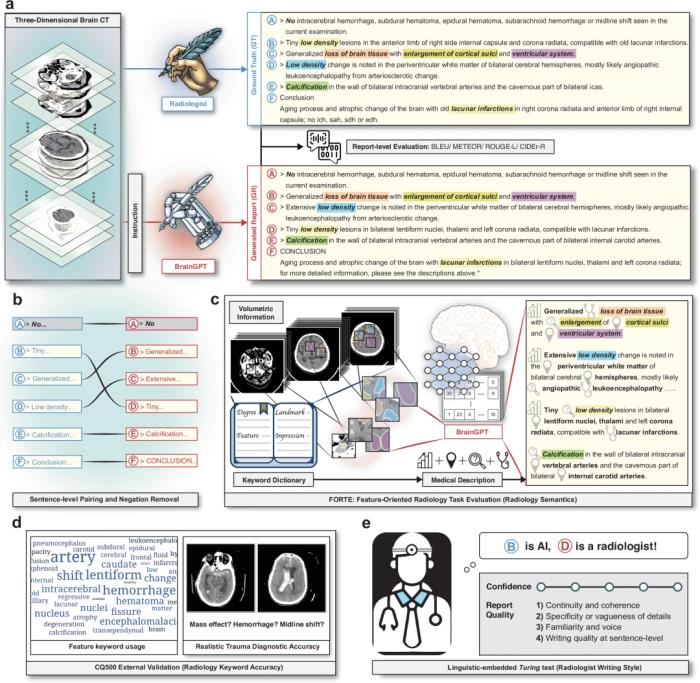

相比之下,BrainGPT 使用端到端開源 Otter 框架(CLIP ViT-L/14 視覺編碼器和 LlaMA-7B),允許進(jìn)行實(shí)驗(yàn)復(fù)制和檢查點(diǎn)共享。此外,BrainGPT 的訓(xùn)練成本降低,可以實(shí)現(xiàn)高效的視覺指令調(diào)整,提高模型性能并根據(jù)專業(yè)或風(fēng)格要求定制響應(yīng)。

圖示:采用臨床視覺指令調(diào)整 (CVIT) 從基線 Otter 模型對(duì) BrainGPT 進(jìn)行微調(diào)。(來(lái)源:論文)

雖然該團(tuán)隊(duì)沒有修改 Otter 模型結(jié)構(gòu),但他們將 SOTA 級(jí)性能歸因于 RVIT 和 CVIT 的綜合作用。

之前,Singhal 團(tuán)隊(duì)首先探索了醫(yī)學(xué)領(lǐng)域中特定于任務(wù)的 RVIT,并報(bào)告說(shuō),聊天機(jī)器人的性能隨著醫(yī)學(xué) QA 上下文示例啟動(dòng)而得到改善。同樣,Med-PaLM M 使用圖像提示(CXR 和病理幻燈片)以及臨床指導(dǎo)來(lái)指導(dǎo) MLLM 完成多模態(tài)醫(yī)療任務(wù)。

與這些研究相呼應(yīng),這里的 CVIT 模型(BrainGPT 模板、BrainGPT 關(guān)鍵字)在腦 CT 字幕制作方面的表現(xiàn)優(yōu)于 RVIT 模型。這表明,精細(xì)的專家級(jí)指導(dǎo)設(shè)計(jì)可能會(huì)優(yōu)化臨床字幕制作任務(wù)的模型結(jié)果。

圖示:通過(guò)醫(yī)生參與的圖靈測(cè)試評(píng)估 BrainGPT 報(bào)告的語(yǔ)言準(zhǔn)備情況。(來(lái)源:論文)

研究人員還強(qiáng)調(diào),傳統(tǒng)指標(biāo)不適合評(píng)估臨床字幕任務(wù)。醫(yī)學(xué)圖像報(bào)告有助于鑒別診斷,因此具有復(fù)雜的釋義、高標(biāo)記數(shù)(>100)和大量負(fù)面描述的特點(diǎn),這與常見的指標(biāo)評(píng)估背景相沖突。

他們還觀察到一種「解讀狂歡」行為,其中 BrainGPT 從多對(duì)象腦 CT 上下文中提供脫靶(但不是幻覺)診斷敘述。這種行為是有害的,因?yàn)?(1) 脫靶效應(yīng)可能會(huì)排除原發(fā)疾病焦點(diǎn)(例如中風(fēng)或腦腫瘤),以及 (2) 擴(kuò)大敘述可能會(huì)稀釋傳統(tǒng)指標(biāo),導(dǎo)致無(wú)效評(píng)估。

為此,F(xiàn)ORTE 作為一個(gè)評(píng)估框架,由句子配對(duì)、否定刪除和 4 類關(guān)鍵詞提取組成,它可以連貫地限制模型幻覺、增強(qiáng)解釋收斂性,并為醫(yī)療保健提供者提供即時(shí)放射學(xué)印象。

研究人員對(duì)不同的評(píng)估指標(biāo)進(jìn)行了皮爾遜相關(guān)性分析,并報(bào)告稱 FORTE 方法比相對(duì)單一的傳統(tǒng)指標(biāo)涵蓋了更廣泛的醫(yī)學(xué)語(yǔ)義維度。它與人類專家評(píng)估和 DocLens 評(píng)分的相關(guān)性都達(dá)到中等到高度,進(jìn)一步證明了這一點(diǎn)。

此外,F(xiàn)ORTE 框架是可定制的,可以在各種醫(yī)療任務(wù)之間轉(zhuǎn)移,沒有任何焦點(diǎn)限制,該團(tuán)隊(duì)的 GitHub 頁(yè)面上提供了可互換的分類關(guān)鍵字庫(kù)作為關(guān)鍵字 JSON 文件,并針對(duì)胸部 X 光、低劑量計(jì)算機(jī)斷層掃描 (LDCT)、腹部 CT 和腦部 CT 任務(wù)展示了一些示例。

在 FORTE 框架內(nèi),BrainGPT 取得了令人稱贊的表現(xiàn),F(xiàn)1 得分達(dá)到 0.589,與一般醫(yī)學(xué)疾病識(shí)別中最先進(jìn)的 (SOTA) 性能相當(dāng),在先前的基準(zhǔn)研究中報(bào)告的準(zhǔn)確率為 59.2%。

自然語(yǔ)言處理實(shí)驗(yàn)中的人類專家評(píng)估是在不同的實(shí)驗(yàn)設(shè)計(jì)下進(jìn)行的,并且服務(wù)于不同的研究目的。因此,在不同情況下,得到的觀點(diǎn)往往不一致且不可比。因此,相關(guān)研究采用定量(完整性、正確性、簡(jiǎn)潔性)和定性(內(nèi)容、語(yǔ)言、結(jié)構(gòu))測(cè)量來(lái)剖析區(qū)分合成臨床報(bào)告和人工報(bào)告的引人注目的特征。

通過(guò)采用具有客觀語(yǔ)言標(biāo)準(zhǔn)的類似設(shè)計(jì),研究人員發(fā)現(xiàn)審閱者成功率和答案交替原因(「可疑措辭」和「都沒有提到關(guān)鍵特征」)都與寫作風(fēng)格(「熟悉度和語(yǔ)氣」和「細(xì)節(jié)的具體性或模糊性」)有關(guān),而不是與句子級(jí)的寫作質(zhì)量和連貫性有關(guān)。一項(xiàng)獨(dú)立的提示研究也強(qiáng)調(diào)了醫(yī)學(xué)報(bào)告寫作風(fēng)格的重要性。

有趣的是,他們觀察到輸入案例不平衡會(huì)影響字幕寫作風(fēng)格,這可能與一般模型訓(xùn)練期間觀察到的過(guò)度擬合有關(guān)。

局限性與結(jié)語(yǔ)

該研究同樣存在幾個(gè)局限性,或許在未來(lái)的工作中加以解決。

首先,這是一項(xiàng)試點(diǎn)體積腦 CT 字幕研究,沒有對(duì)應(yīng)的 MLLM 模塊進(jìn)行基準(zhǔn)測(cè)試,因此研究人員無(wú)法證明 SOTA 級(jí)別的有效性;但是,他們應(yīng)用了外部驗(yàn)證來(lái)確保腦 CT 模塊中的字幕有效性。

其次,BrainGPT 是在退化導(dǎo)向數(shù)據(jù)上進(jìn)行訓(xùn)練的,因此無(wú)法捕捉 CQ500 中的惡性腫瘤和急性創(chuàng)傷特征。這一現(xiàn)象反映出訓(xùn)練材料可能會(huì)為最終模塊的靈活性打下基礎(chǔ)。因此,團(tuán)隊(duì)建議納入不同的疾病病因,以進(jìn)行鑒別診斷,從而提高 MLLM 對(duì)邊界腦 CT 特征的概括。

最后,該團(tuán)隊(duì)進(jìn)行了 CVIT 并發(fā)明了面向臨床的評(píng)估(句子配對(duì)、否定消除和 FORTE),但他們沒有試驗(yàn)改變模型主干是否有利于腦 CT 標(biāo)記。未來(lái)的研究途徑可能是比較多模型結(jié)果并微調(diào) CT 的視覺編碼器和語(yǔ)言模型。

論文鏈接:https://www.nature.com/articles/s41467-025-57426-0

- 免責(zé)聲明

- 本文所包含的觀點(diǎn)僅代表作者個(gè)人看法,不代表新火種的觀點(diǎn)。在新火種上獲取的所有信息均不應(yīng)被視為投資建議。新火種對(duì)本文可能提及或鏈接的任何項(xiàng)目不表示認(rèn)可。 交易和投資涉及高風(fēng)險(xiǎn),讀者在采取與本文內(nèi)容相關(guān)的任何行動(dòng)之前,請(qǐng)務(wù)必進(jìn)行充分的盡職調(diào)查。最終的決策應(yīng)該基于您自己的獨(dú)立判斷。新火種不對(duì)因依賴本文觀點(diǎn)而產(chǎn)生的任何金錢損失負(fù)任何責(zé)任。

新火種

2025-03-14

新火種

2025-03-14