2024年AI十大故事,透視技術變革與未來挑戰

2024 年,人工智能技術持續改變著我們的生活和工作方式。IEEE Spectrum 精選了年度最具影響力的 10 個 AI 故事,從技術突破到社會影響,全方位展現了 AI 發展的現狀與挑戰。這些故事不僅反映了生成式 AI 的革命性進展,也揭示了其存在的局限與爭議。

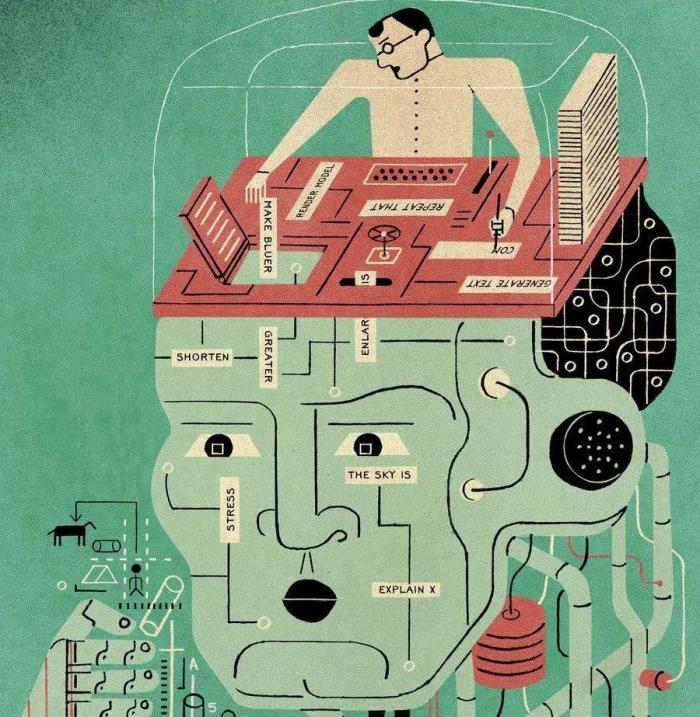

提示工程的終結:AI 正在取代人類設計師

自ChatGPT問世以來,提示工程(prompt engineering)迅速成為熱門領域。然而,最新研究顯示,AI 在優化提示詞方面已全面超越人類專家。VMware研究發現,盡管算法生成的提示詞看似怪異,卻能帶來更優的性能表現。

在圖像生成領域,Intel Labs 開發的 NeuroPrompts 工具通過強化學習優化提示詞,同樣證實了這一點。然而,這并不意味著提示工程師將被淘汰,而是正在向更全面的 LLMOps 工程師轉型,負責 AI 系統的可靠性、安全性和合規性等多個維度。

版權困境:生成式 AI 的創作邊界在哪里?

研究發現,Midjourney 和 DALL-E 3 等生成式 AI 系統即使在沒有直接提示的情況下,也可能產生與受版權保護內容高度相似的作品。這不僅暴露了 AI 訓練數據的合法性問題,也挑戰著現有的知識產權保護體系。

雖然一些公司嘗試通過過濾提示詞來減少侵權風險,但長期來看,確保訓練數據獲得合法授權才是根本解決方案。推動行業建立透明的數據使用機制,平衡創新與權益保護,成為當務之急。

解碼 ChatGPT:AI 編程能力的真相與局限

格拉斯哥大學的研究團隊對 ChatGPT 的編程能力進行了全面評估。結果顯示,ChatGPT 在處理 2021 年前的編程問題時表現出色,簡單題目的成功率高達 89%,但面對 2021 年后的新問題時,表現急劇下降,困難題目的成功率僅為 0.66%。這一差異凸顯了 AI 缺乏真正的理解力和批判性思維。

不過,在代碼運行效率和內存占用方面,ChatGPT 生成的解決方案往往優于 50% 的人類代碼。研究建議,開發者在使用 AI 輔助編程時應提供更多上下文信息,并注意規避潛在的安全隱患。

AI 助教時代:編程教育的革命與隱憂

生成式 AI 的普及正在推動計算機科學教育的深刻變革。教育工作者正在調整教學策略,減少對代碼語法的機械訓練,轉而強調問題分解、測試調試等高階技能。多所高校的實踐表明,AI 工具讓學生能夠嘗試更具挑戰性的項目,為培養更深層次的思維能力創造了條件。

斯坦福大學助教 Johnny Chang 建議學生在使用 AI 前先獨立思考,將 AI 視為學習的「副駕駛」而非「自動駕駛」。盡管 AI 應用存在著作權和偏見等問題,但擁抱這一變革有助于縮小學術教育與行業需求之間的差距。

算法與勞工:數據時代的權益之爭

2020 年初,Shipt 外賣平臺突然改變了配送員的薪資計算方式。面對不透明的「工作量」算法,工人 Willy Solis 與 MIT 研究員合作開發了數據分析工具,收集并分析了 5600 多份工資單。結果顯示 40% 的工人收入減少,其中一半人降幅超過 10%,約三分之一的收入低于州最低工資標準。

這場數據抗爭雖未獲得公司直接回應,但推動了零工經濟中算法透明度的立法進程。歐盟已要求平臺向工人說明算法決策過程,為算法時代的勞工保護樹立了標準。

圖說AI:2024產業圖譜

斯坦福 AI 指數報告揭示了 2024 年 AI 產業的關鍵走向。

投資趨勢:盡管科技領域整體投資降溫,生成式 AI 領域仍保持強勁增長。

技術格局:Google 主導基礎模型研發,但閉源模型的高成本和環境影響引發擔憂。

人才流向:70% 的 AI 博士選擇企業發展,反映產業對人才的巨大需求。

商業應用:近八成財富 500 企業積極布局 AI,42% 實現降本增效。

政策環境:全球 33 國共頒布 148 項 AI 相關法律,突顯治理重要性。

KAN 網絡:可解釋 AI 的突破性進展

研究人員開發的 Kolmogorov-Arnold 網絡(KAN)開創了神經網絡設計的新范式。不同于傳統網絡學習權重,KAN 的突觸學習復雜的激活函數,這一創新大幅提高了模型的可解釋性。在物理定律預測等任務中,KAN 使用少量參數就能達到遠超傳統網絡的精度。研究人員可以直觀地分析網絡結構,甚至將復雜模型簡化為單行函數,為科學發現提供了新工具。

智慧交通:AI 能否拯救世界最擁堵的科技之城?

印度班加羅爾因快速發展的科技產業而成為全球最擁堵的城市之一。為應對交通問題,前芯片工程師、現任交通警察專員 M.N. Anucheth 開發的 ASTraM 系統,通過 AI 分析多源數據預測擁堵熱點,并實時調整交通管理策略。

然而,專家指出技術創新只能在有限范圍內改善狀況,城市基礎設施的滯后才是問題根源。這個案例提醒我們,AI 應用需要與城市規劃和基礎建設協同推進。

倫理危機:技術濫用與兒童權益保護的博弈

AI 圖像生成工具被惡意用戶濫用于制作危害未成年人的內容,引發行業警醒。雖然Hugging Face等平臺采取了下架問題模型等措施,但專家呼吁在源頭加強管控。「安全設計」原則要求企業在開發階段就注重數據清理、內容追蹤等保護機制,以技術和制度雙重手段防范 AI 濫用。

硅谷速生記:創業公司的人工智能與人工現實

初創公司 AllDone 的案例揭示了 AI 創新背后的現實。在獲得 450 萬美元投資后,公司一邊在硅谷開發算法,一邊依靠菲律賓外包團隊充當「人工智能」處理日常任務。這些工人以每小時 2 美元的工資完成大量人工操作,支撐著平臺的快速增長。這種依賴廉價勞動力的模式引發了對技術進步中全球不平等的思考。

這十個故事展示了 2024 年 AI 發展的全貌:技術創新帶來效率提升和能力突破,同時也伴隨著版權保護、算法公平、勞工權益等深層次挑戰。在推動 AI 發展的同時,我們需要更加重視其對社會、倫理和法律層面的影響,構建負責任的 AI 發展之路。

相關鏈接:https://spectrum.ieee.org/top-ai-stories-2024

- 免責聲明

- 本文所包含的觀點僅代表作者個人看法,不代表新火種的觀點。在新火種上獲取的所有信息均不應被視為投資建議。新火種對本文可能提及或鏈接的任何項目不表示認可。 交易和投資涉及高風險,讀者在采取與本文內容相關的任何行動之前,請務必進行充分的盡職調查。最終的決策應該基于您自己的獨立判斷。新火種不對因依賴本文觀點而產生的任何金錢損失負任何責任。

新火種

2025-02-07

新火種

2025-02-07