谷歌更新Transformer架構,更節省計算資源!50%性能提升

谷歌終于更新了Transformer架構。

最新發布的Mixture-of-Depths(MoD),改變了以往Transformer計算模式。

它通過動態分配大模型中的計算資源,跳過一些不必要計算,顯著提高訓練效率和推理速度。

結果顯示,在等效計算量和訓練時間上,MoD每次向前傳播所需的計算量更小,而且后訓練采樣過程中步進速度提高50%。

這一方法剛剛發布,就馬上引發關注。

MoE風頭正盛,MoD已經來后浪拍前浪了?

還有人開始“算賬”:

所以MoD如何實現?

迫使大模型關注真正重要信息

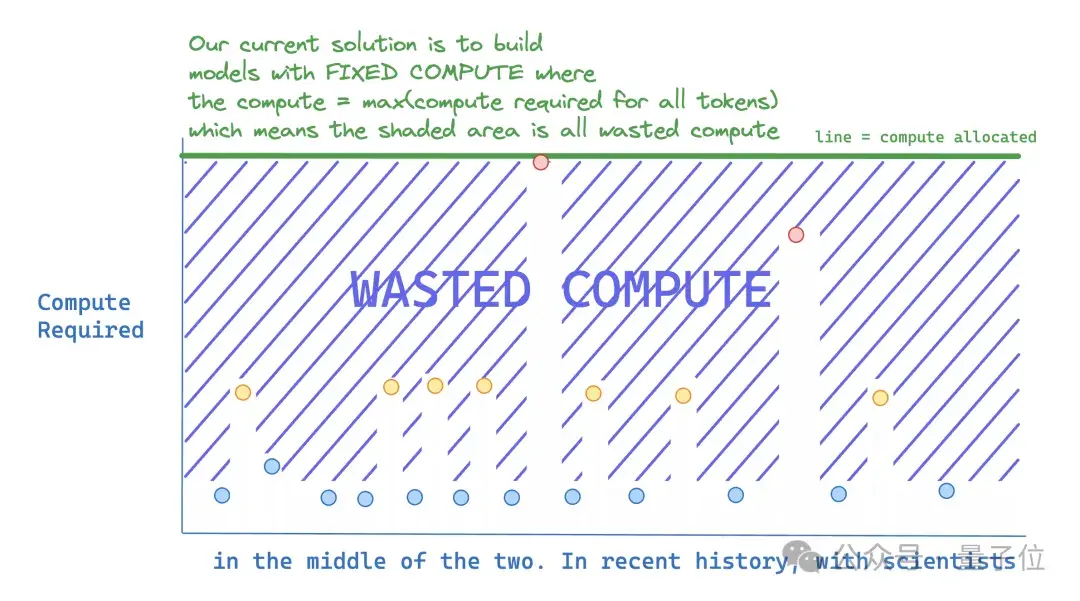

這項研究提出,現在的大模型訓練和推理中,有很多計算是沒必要的。

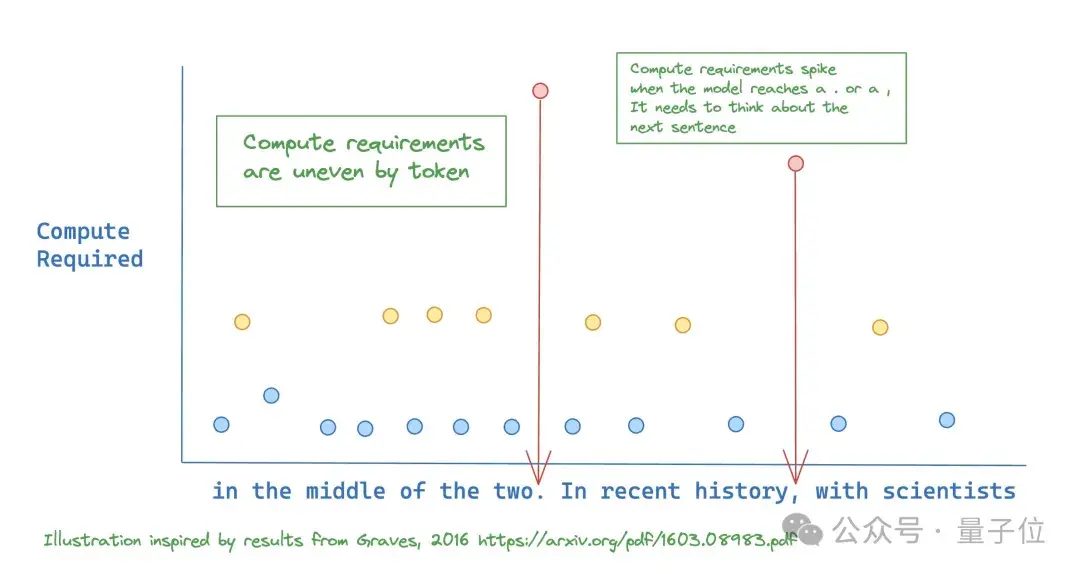

比如預測下一個句子很難,但是預測句子結束的標點符號很簡單。如果給它們分配同樣的計算資源,那么后者明顯浪費了。

在理想情況下, 模型應該只給需要準確預測的token分配更多計算資源。

所以研究人員提出了MoD。

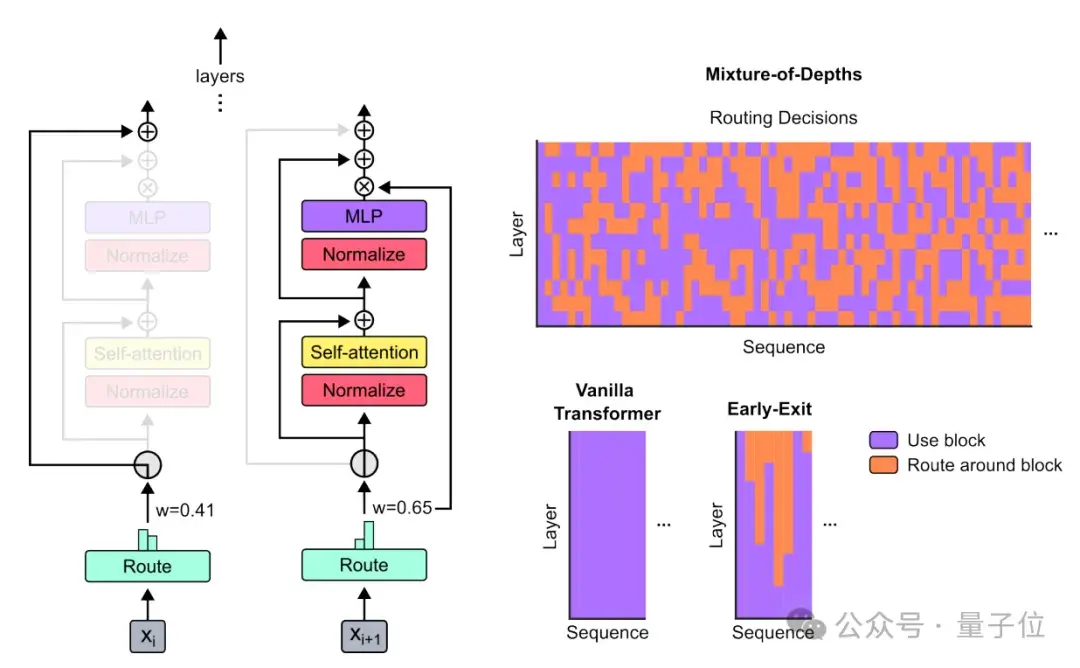

它在輸入序列中的特定位置動態分配FLOPs(運算次數或計算資源),優化不同層次的模型深度中的分配。

通過限制給定層的自注意力和MLP計算的token數量,迫使神經網絡學會主要關注真正重要的信息。

因為token數量是事先定義好的,所以這個過程使用一個已知張量大小的靜態計算圖,可以在時間和模型深度上動態擴展計算量。

下圖右上圖中的橙色部分,表示沒有使用全部計算資源。

這種方法在節省計算資源的同時,還能提高效率。

這些模型在等效的FLOPS和訓練時間上與基線性能相匹配,但每次前向傳播所需的FLOP更少,并且在訓練后采樣時提速50%。

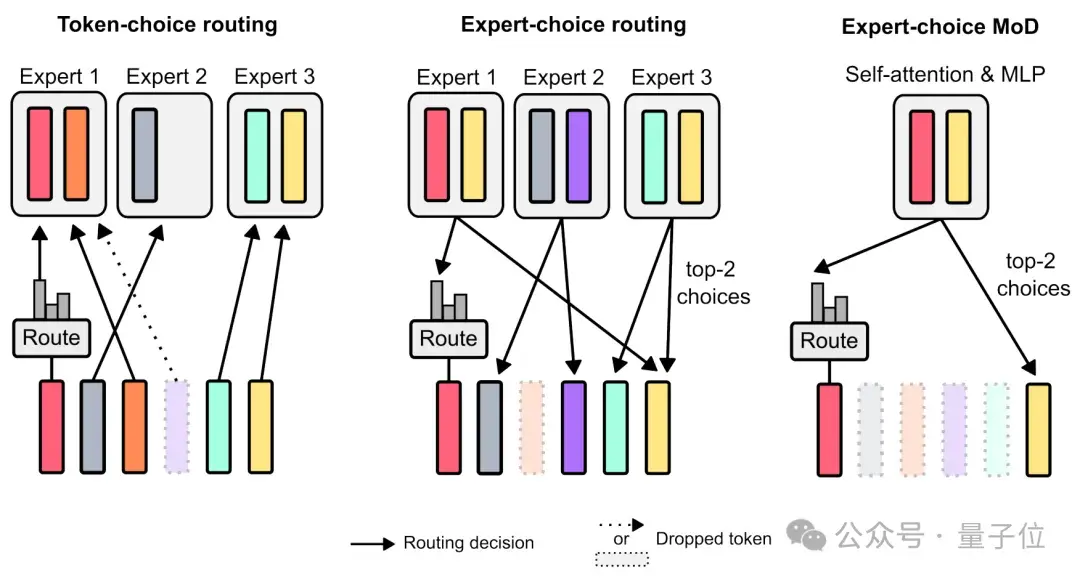

對比來看,如果為每一個token生成一個概率分布,每個token根據最高概率被送去對應的“專家”,可能會導致負載不平衡。

如果反過來,這能保障負載平衡,但是可能導致某些token被過度處理或處理不足。

最后來看論文中使用的Expert-choice MoD,router輸出的權重被用于確定哪些token將使用transformer虧啊計算。權重較大的token將參與計算,權重較小的token將通過殘差連接繞過計算,從而解決每次向前傳播的FLOPs。

最后,研究團隊展示了MoD在不同實驗中的性能表現。

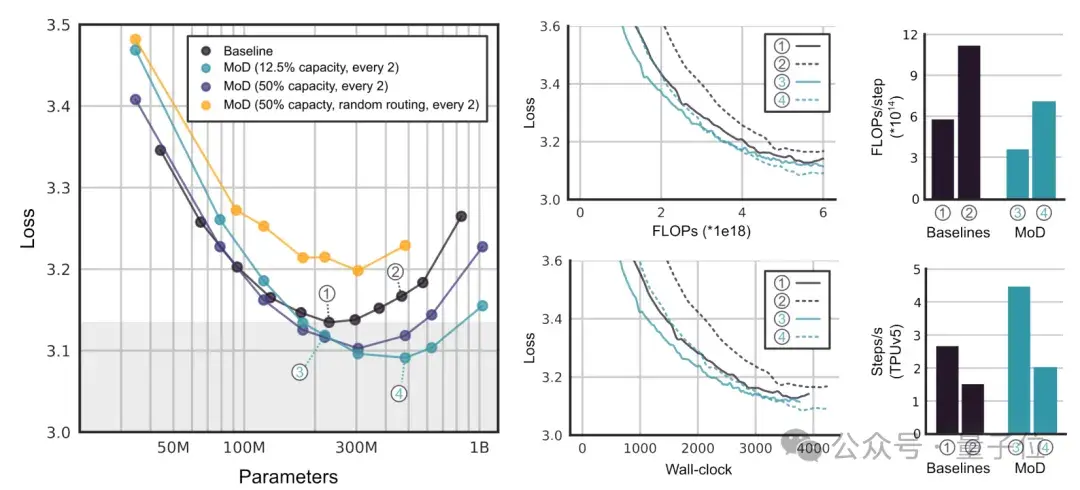

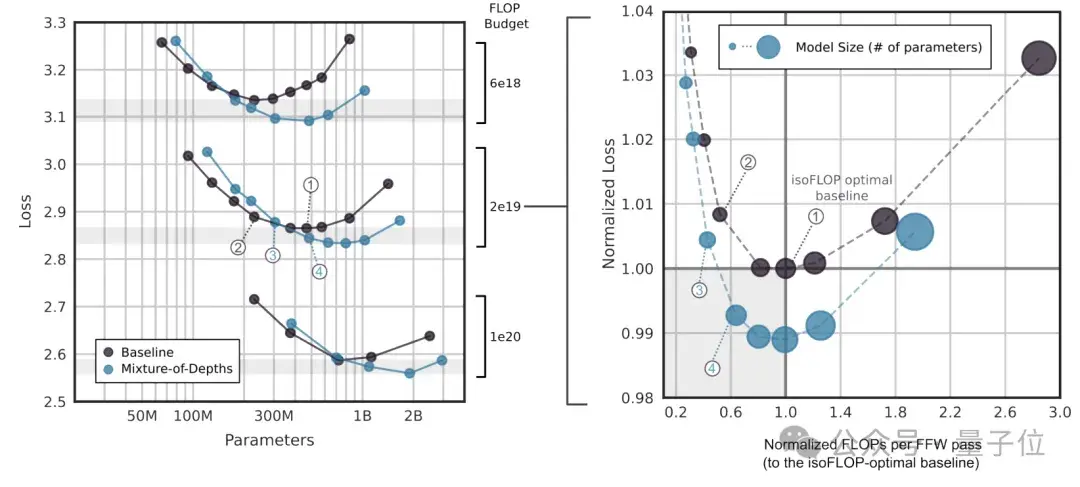

首先,他們使用相對較小的FLOP預算(6e18),以確定最佳超參數配置。

通過這些實驗,作者發現MoD方法能夠“拉低并向右推移”isoFLOP基線曲線,這意味著最優的MoD方法在更低的損失水平上擁有更多的參數。

通過isoFLOP分析,比較6e18、2e19和1e20 FLOPs的總計算預算下的模型性能。

結果顯示,在更多FLOP預算下,FLOP最優的MoD仍然比基線模型有更多的參數。

存在一些MoD變體,在步驟速度上比isoFLOP最優基線模型更快,同時實現更低的損失。這表明在訓練之外,MoD的計算節省仍然有效。

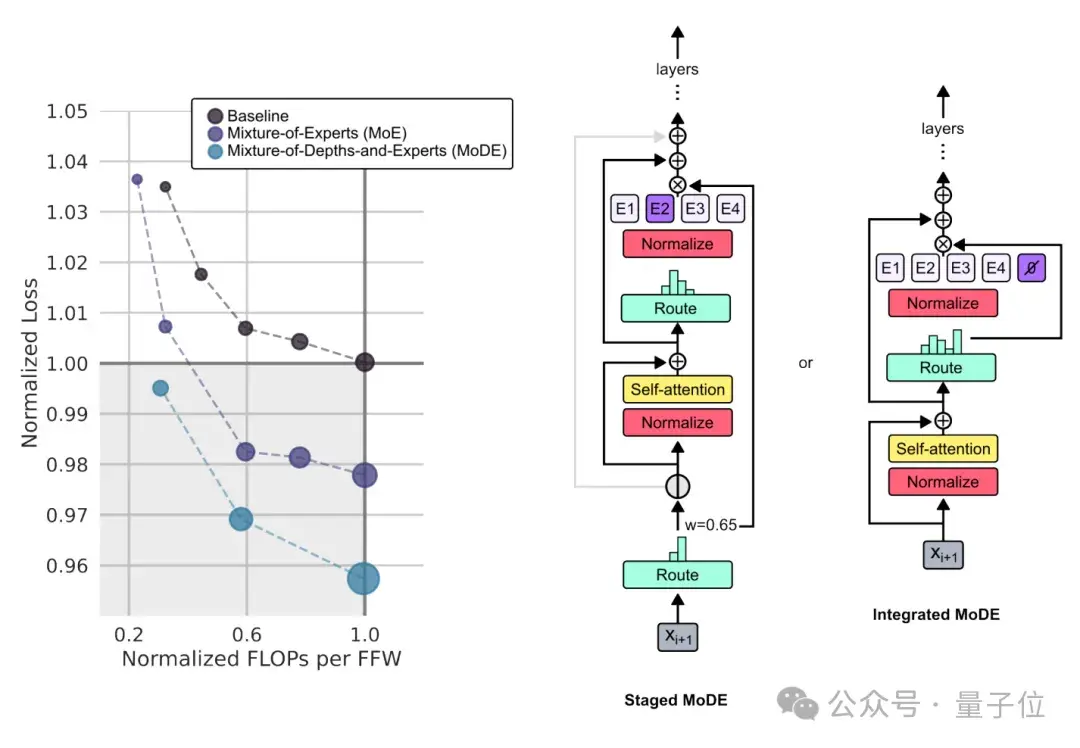

同時,研究團隊還探討了MoD和MoE結合的可能性——MoDE。

結果表明而這結合能提供更好的性能和更快的推理速度。

網友:聯想到了ResNet

網友:聯想到了ResNet

MoD推出后馬上引發了不小關注。

有人感慨,MoE還沒有弄清楚呢,MoD都已經來了!

這么高效的方法,讓人馬上聯想到了ResNet。

不過和ResNet不同,MoD跳過連接是完全繞過層的。

還有人表示,希望這種方法是完全動態的,而不是每個層固定百分比。

這項研究由DeepMind和麥吉爾大學共同帶來。

主要貢獻者是David Raposo和Adam Santoro。

他們二人都是DeepMind的研究科學家。此前共同帶來了神作《Relational inductive biases, deep learning, and graph networks》。

這篇論文目前被引次數超過3500次,論文核心定義了Inductive bias(歸納偏置)概念。

- 免責聲明

- 本文所包含的觀點僅代表作者個人看法,不代表新火種的觀點。在新火種上獲取的所有信息均不應被視為投資建議。新火種對本文可能提及或鏈接的任何項目不表示認可。 交易和投資涉及高風險,讀者在采取與本文內容相關的任何行動之前,請務必進行充分的盡職調查。最終的決策應該基于您自己的獨立判斷。新火種不對因依賴本文觀點而產生的任何金錢損失負任何責任。

新火種

2024-04-07

新火種

2024-04-07