谷歌推新型生成式AI模型IGN單步即可生成逼真圖像

要點:

1. UC伯克利和谷歌提出的冪等生成網絡(IGN)是一種新型生成式AI模型,能夠通過單步生成逼真圖像,不需要多步迭代。

2. IGN與傳統的生成對抗網絡(GAN)和擴散模型不同,它是一個自對抗模型,同時完成生成和判別,并嘗試在單個步驟中將輸入映射到目標數據分布。

3. 通過實驗證明,雖然IGN目前生成結果無法與最先進的模型競爭,但在推理方面更加有效,可以輸出一致性更高的結果,具有潛在的醫學圖像修復應用。

站長之家11月14日 消息:生成式AI模型的新范式要來了。UC伯克利谷歌提出冪等生成網絡(IGN),只需單步即可生圖。當前,生成式AI模型,比如GAN、擴散模型或一致性模型,通過將輸入映射到對應目標數據分布的輸出,來生成圖像。通常情況下,這種模型需要學習很多真實的圖片,然后才能盡量保證生成圖片的真實特征。

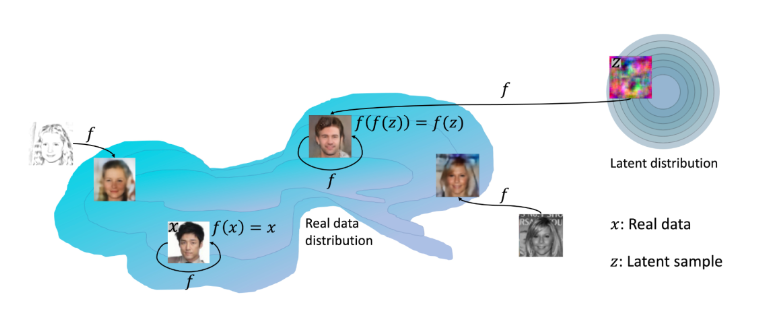

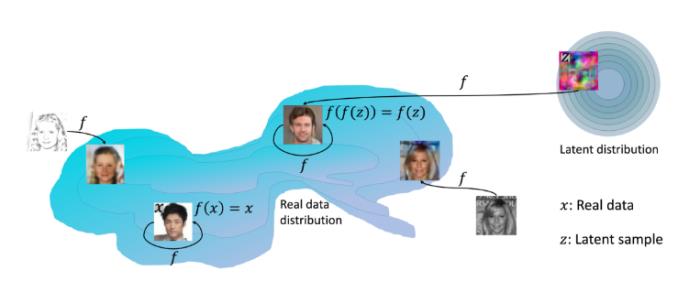

最近,來自UC伯克利和谷歌的研究人員提出了一種全新生成模型——冪等生成網絡(IGN)。IGNs可以從各種各樣的輸入,比如隨機噪聲、簡單的圖形等,通過單步生成逼真的圖像,并且不需要多步迭代。這一模型旨在成為一個「全局映射器」(global projector),可以把任何輸入數據映射到目標數據分布。

論文地址:https://arxiv.org/abs/2311.01462

有趣的是,《宋飛正傳》中一個高效的場景竟成為研究人員的靈感來源。這個場景很好地總結了「冪等運算符」(idempotent operator)這一概念,是指在運算過程中,對同一個輸入重復進行運算,得到的結果總是一樣的。

IGN與GAN、擴散模型有兩點重要的不同之處:與GAN不同的是,IGN無需單獨的生成器和判別器,它是一個「自對抗」的模型,同時完成生成和判別。與執行增量步驟的擴散模型不同,IGN嘗試在單個步中將輸入映射到數據分布。位于同一空間,即它們的實例具有相同的維度。

研究人員承認,現階段,IGN的生成結果無法與最先進的模型相競爭。在實驗中,使用的較小的模型和較低分辨率的數據集,并在探索中主要關注簡化方法。當然了,基礎生成建模技術,如GAN、擴散模型,也是花了相當長的時間才達到成熟、規模化的性能。研究人員在MNIST(灰度手寫數字數據集)和 CelebA(人臉圖像數據集)上評估IGN,分別使用28×28和64×64的圖像分辨率。

研究人員采用了簡單的自動編碼器架構,其中編碼器是來自DCGAN的簡單五層鑒別器主干,解碼器是生成器。訓練和網絡超參數如表1所示。圖4顯示了應用模型一次和連續兩次后兩個數據集的定性結果。如圖所示,應用IGN 一次 (f (z)) 會產生相干生成結果。然而,可能會出現偽影,例如MNIST數字中的孔洞,或者面部圖像中頭頂和頭發的扭曲像素。

再次應用 f (f (f (z))) 可以糾正這些問題,填充孔洞,或減少面部噪聲斑塊周圍的總變化。表明,當圖像接近學習流形時,再次應用f會導致最小的變化,因為圖像被認為是分布的。作者通過執行操作證明IGN具有一致的潛在空間,與GAN所示的類似,圖6顯示了潛在空間算法。

研究人員還驗證通過將來自各種分布的圖像輸入到模型中以生成其等效的「自然圖像」,來驗證IGN「全局映射」的潛力。研究人員通過對噪聲圖像x+n 進行去噪、對灰度圖像原始圖像x,這些逆任務是不適定的。IGN能夠創建符合原始圖像結構的自然映射。如圖所示,連續應用f可以提高圖像質量(例如,它消除了投影草圖中的黑暗和煙霧偽影)。通過以上結果可以看出,IGN在推理方面更加有效,在訓練后只需單步即可生成結果。它們還可以輸出更一致的結果,這可能推廣到更多的應用中,比如醫學圖像修復。

- 免責聲明

- 本文所包含的觀點僅代表作者個人看法,不代表新火種的觀點。在新火種上獲取的所有信息均不應被視為投資建議。新火種對本文可能提及或鏈接的任何項目不表示認可。 交易和投資涉及高風險,讀者在采取與本文內容相關的任何行動之前,請務必進行充分的盡職調查。最終的決策應該基于您自己的獨立判斷。新火種不對因依賴本文觀點而產生的任何金錢損失負任何責任。

新火種

2023-11-20

新火種

2023-11-20