ChatGPT真實參數只有200億,首次被微軟曝光!網友驚:要開源了?

突然間,整個大模型圈都在談論同一件事。

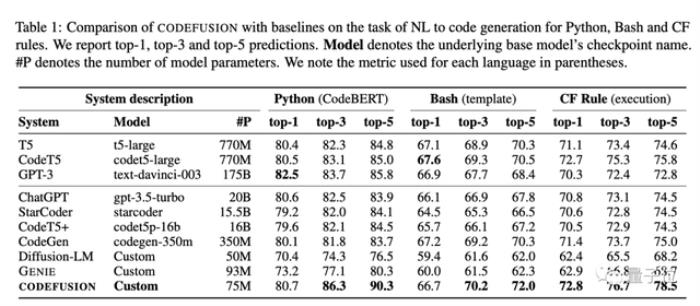

微軟論文里一張「乍一看不足為奇」的統計圖,泄露了“天機”。

引領全球風暴的ChatGPT,背后大模型參數竟只有200億???

論文一經發布,就吸引了國內外眾多關注。

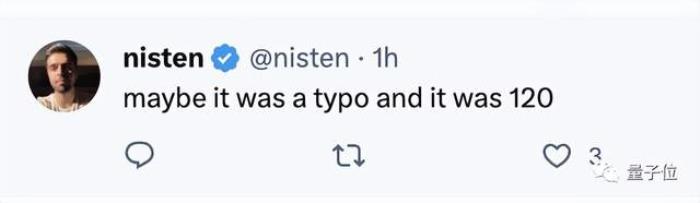

不少網友還不相信:確定不是拼寫錯了?

有網友表示:難怪OpenAI對開源這么緊張。又或者,這也許是為OpenAI開源做準備。

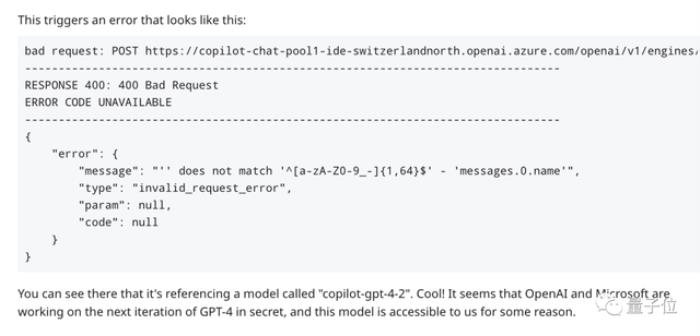

無獨有偶,就在前幾天有網友在GitHub Copilot的API中發現了疑似GPT-4新型號:copilot-gpt-4-2,所擁有的知識更新到了2023年3月。

這篇論文說了啥?

這篇論文說了啥?除了泄露機密,這篇論文本身也值得一看:業內首個用擴散模型做代碼生成。

研究團隊設想了這樣一個場景:

用自然語言生成代碼的自回歸模型也有類似的局限性:不太容易重新考慮之前生成的tokens。

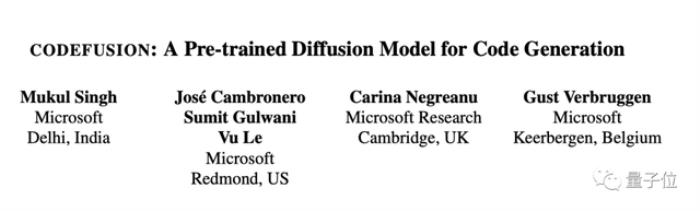

微軟研究員提出了采用編碼-解碼架構的CODEFUSION,主要包括編碼器、解碼器、去噪器以及Classification Head,將自然語言輸入編碼為連續表示,然后將其附加條件輸入Diffusion模型中用高斯噪聲進行迭代去噪。

為了生成語法正確的代碼,去噪后輸入解碼器中獲得代碼tokens,通過針對代碼的連續段落去噪(CPD)任務預訓練CODEFUSION。

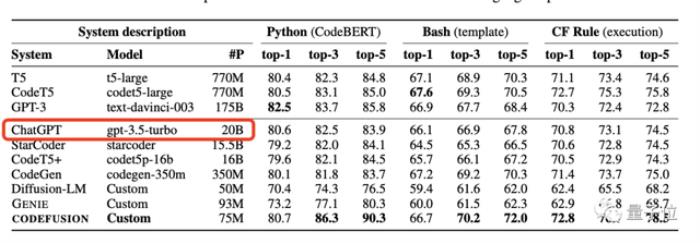

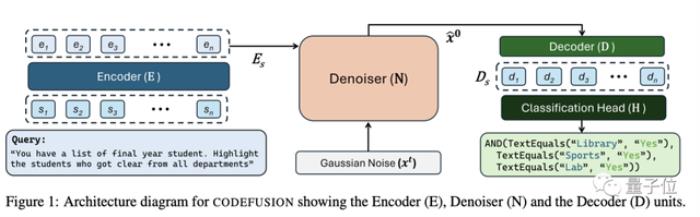

在Python、Bash和Excel條件格式化(CF)規則三個語言任務上評估了CODEFUSION。

結果顯示其7500萬參數規模CODEFUSION性能,同200億參數的GPT-3.5-turbo接近,而且還生成更加多樣化的代碼。

與純文本生成的diffusion模型相比,CODEFUSION生成更多語法正確的代碼;與自動回歸模型相比,生成更加多樣化的候選代碼。

與最先進的自回歸系統(350M-175B 參數)相比,在前 1 名的準確率方面表現相當,而在前 3 名和前 5 名的準確率方面,由于其在多樣性與質量之間取得了更好的平衡,其表現優于自回歸系統。

結果這原本只是一次再正常不過的性能比較,沒想到引起軒然大波。

也有人開始了陰謀論,或許這是OpenAI開源的“前菜”,故意而為之——

因為不少大模型已經追趕上來了,而且早在今年5月,路透社就曾爆料OpenAI準備開源新大語言模型。

One More Thing

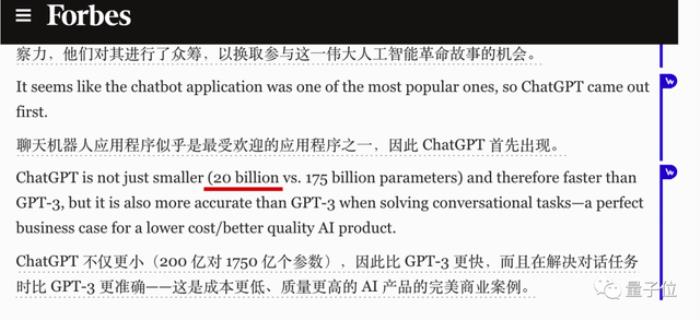

One More Thing值得一提的是,早在今年2月份福布斯一則新聞報道里,就曾透露過ChatGPT只有200億參數。

當時標題是「越大越好嗎?為什么 ChatGPT VS GPT-3 VS GPT-4 的 “戰斗 “只是一次家庭聊天?」

只是當時沒有太多人在意。

參考鏈接:[1]https://twitter.com/felix_red_panda/status/1718916631512949248[2]https://x.com/teortaxesTex/status/1718972447024623898?s=20[3]https://www.reddit.com/r/singularity/comments/17jrepb/microsoft_paper_claims_chatgpt_35_has_20_billion/[4]https://www.zhihu.com/question/628395521[5]https://www.reddit.com/r/ChatGPT/comments/17ht56t/new_leaks_about_upcoming_developments_with_openai/?share_id=txV27HR0zw0TjV8dLXf4l[6]https://www.forbes.com/sites/forbestechcouncil/2023/02/17/is-bigger-better-why-the-chatgpt-vs-gpt-3-vs-gpt-4-battle-is-just-a-family-chat/amp/

- 免責聲明

- 本文所包含的觀點僅代表作者個人看法,不代表新火種的觀點。在新火種上獲取的所有信息均不應被視為投資建議。新火種對本文可能提及或鏈接的任何項目不表示認可。 交易和投資涉及高風險,讀者在采取與本文內容相關的任何行動之前,請務必進行充分的盡職調查。最終的決策應該基于您自己的獨立判斷。新火種不對因依賴本文觀點而產生的任何金錢損失負任何責任。

新火種

2023-11-01

新火種

2023-11-01