騰訊混元發布并開源圖生視頻模型:讓照片開口說話唱歌AI神器

3月6日消息,今日,騰訊混元宣布發布圖生視頻模型并對外開源,同時上線對口型與動作驅動等玩法,并支持生成背景音效及2K高質量視頻。

企業和開發者可在騰訊云申請使用API接口,用戶通過混元AI視頻官網即可體驗。

開源內容包含權重、推理代碼和LoRA訓練代碼,支持開發者基于混元訓練專屬LoRA等衍生模型,目前在Github、HuggingFace等主流開發者社區均可下載體驗。

據介紹,基于圖生視頻的能力,用戶只需上傳一張圖片,并簡短描述希望畫面如何運動、鏡頭如何調度等,混元即可按要求讓圖片動起來,變成5秒的短視頻,還能自動配上背景音效。

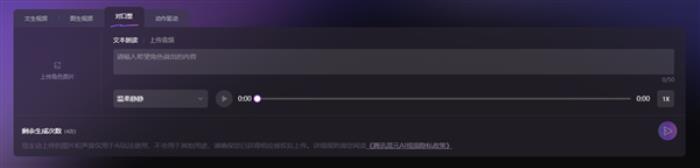

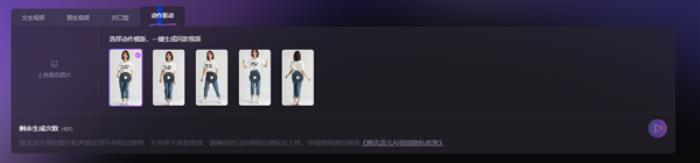

此外,上傳一張人物圖片,并輸入希望“對口型”的文字或音頻,圖片中的人物即可“說話”或“唱歌”;使用“動作驅動”能力,還能一鍵生成同款跳舞視頻。

騰訊混元表示,此次開源的圖生視頻模型,是混元文生視頻模型開源工作的延續,模型總參數量保持 130 億,模型適用于多種類型的角色和場景,包括寫實視頻制作、動漫角色甚至CGI角色制作的生成。

相關推薦

- 免責聲明

- 本文所包含的觀點僅代表作者個人看法,不代表新火種的觀點。在新火種上獲取的所有信息均不應被視為投資建議。新火種對本文可能提及或鏈接的任何項目不表示認可。 交易和投資涉及高風險,讀者在采取與本文內容相關的任何行動之前,請務必進行充分的盡職調查。最終的決策應該基于您自己的獨立判斷。新火種不對因依賴本文觀點而產生的任何金錢損失負任何責任。

新火種

2025-03-07

新火種

2025-03-07