國(guó)產(chǎn)AI可以拍微電影了!4K、60幀高清畫質(zhì),自帶音效

國(guó)產(chǎn)AI,正式把視頻生成拉進(jìn)了有聲電影時(shí)代。

自從Sora引爆視頻生成之后,基本上所有AI生成的視頻都屬于“默片”的效果,也就是沒有對(duì)應(yīng)的音效(注意不是配樂)。

但現(xiàn)在,音效是可以直接自帶了!而且還是4K、60幀高清畫質(zhì)的那種。

那么AI視頻生成現(xiàn)在能到什么水平?

我們直接拿這個(gè)國(guó)產(chǎn)AI做了個(gè)微電影,請(qǐng)看VCR:

如何?是不是已經(jīng)有電影的那個(gè)feel了?

這個(gè)國(guó)產(chǎn)AI,正是智譜剛升級(jí)的新清影,總體來(lái)看有三大特點(diǎn):

電影級(jí)效果:除了剛才提到的4K、60幀高清之外,還支持10秒時(shí)長(zhǎng)和任意比例視頻。模型能力全面提升:背后的CogVideoX模型更懂復(fù)雜prompt,能夠保持人物等主體的連貫性,效果更逼真。自帶音效:引入CogSound模型,能夠自動(dòng)根據(jù)視頻內(nèi)容生成匹配的音效,這個(gè)月將正式上線清言APP。如此一來(lái),AI已經(jīng)具備了制作像上面這樣微電影(或短視頻)的全要素,而且在操作上也是非常簡(jiǎn)單。

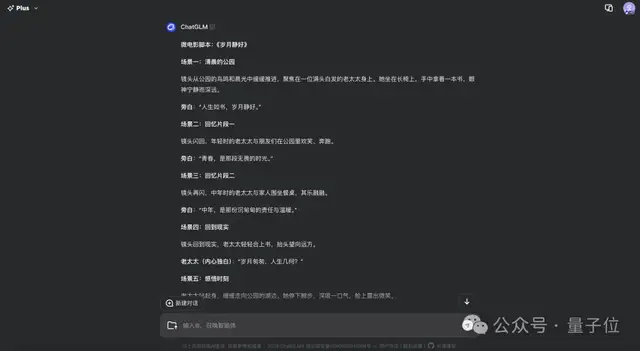

我們先把一個(gè)主題“喂給”智譜清言的GLM 4 Plus,讓它幫我們生成微電影的腳本:

然后我們?cè)儆梦纳鷪D的AI,生成幾張高清大圖,以開頭片段為例,Prompt是這樣的:

再進(jìn)入新清影的圖生視頻界面,把這張圖像傳上去,并填寫想要效果的prompt:

接著在下方面選擇基礎(chǔ)參數(shù)即可:

在靜候片刻之后,一段電影級(jí)別、自帶音效的高清視頻片段就這么水靈靈的誕生了。

重復(fù)上面的方法,我們便可以得到后邊的那些視頻片段。

至于旁白部分,采用的則是智譜在前不久剛發(fā)布的GLM-4-Voice情感語(yǔ)音模型,可以做到宛如真人配音。

嗯,打得就是一套智譜的AI組合拳。

而聯(lián)想人類從第一部無(wú)聲電影(1895年)到第一部有聲電影(1927年),足足花費(fèi)了32年。

若是從Sora算起,那么AI生成的視頻從無(wú)聲到有聲,耗時(shí)僅僅9個(gè)月。

此時(shí)此刻,“AI一天,人間一年”這句話,是真真兒的具象化了。

隨意一段視頻,秒出有聲電影片段那么智譜的CogSound模型還能hold住什么樣的音效?

我們這就來(lái)一波實(shí)測(cè)。

實(shí)測(cè)方法也是非常簡(jiǎn)單,我們會(huì)截取電影中的視頻片段作為輸入,考驗(yàn)的就是它能否對(duì)視頻內(nèi)容深入理解,并生成沒有違和感的音效。

Round 1:自然環(huán)境

我們先取一段雨天傍晚房間里的一個(gè)視頻,把它“喂”給CogSound模型(注:以下原視頻都是無(wú)聲的),生成出來(lái)的音效是這樣的:

CogSound精準(zhǔn)地get到了“下雨”這個(gè)關(guān)鍵元素,從音效上來(lái)看也是毫無(wú)違和感。

再來(lái)欣賞一段由清影生成、CogSound加音效的視頻片段:

Round 2:動(dòng)物世界

我們?cè)賮?lái)試試CogSound能否看視頻識(shí)別出動(dòng)物的聲音:

CogSound不僅生成出了獅子?jì)寢尩统恋慕新暎舶l(fā)覺到了它們處于自然環(huán)境之下,還配上了鳥鳴的聲音。

Round 3:多種樂器

接下來(lái),我們上個(gè)難度,輸入一段有多個(gè)樂器演奏的視頻頻段:

可以看到,從視頻一開始的畫面來(lái)看,薩克斯這個(gè)樂器應(yīng)當(dāng)是“主角”,所以在樂器混合的音效中,薩克斯的聲音是最大的。

而當(dāng)薩克斯手用力吹奏的時(shí)候,CogSound配的音效竟也有了音樂上的起伏,說(shuō)實(shí)話,這一點(diǎn)確實(shí)是有點(diǎn)令人意外。

但要非挑個(gè)問題的話,或許鏡頭在轉(zhuǎn)向鋼琴的時(shí)候,樂器的音效上,鋼琴聲音變大一些會(huì)更好些。

Round 4:科幻電影

最后,我們?cè)佟拔埂币粋€(gè)超級(jí)復(fù)雜的視頻片段——《流浪地球》:

講真,若不是知道這是CogSound生成的,很多人應(yīng)該都會(huì)認(rèn)為它是電影原聲了吧。

由此可見,不論“喂”給CogSound模型什么類型的視頻,它都可以做到對(duì)視頻內(nèi)容的精準(zhǔn)理解,并且給出對(duì)應(yīng)音效。

除此之外,在視頻本身生成的能力上,智譜的CogVideo也有了大幅的提升。

例如生成的下面這位老爺爺,情緒和表情的變化,宛如在看一個(gè)電影片段:

還有像非常科幻的火焰老虎:

而從上面兩個(gè)例子中,我們也不難發(fā)現(xiàn),CogVideoX現(xiàn)在是可以支持多種比例視頻的生成。

那么接下來(lái)的問題就是:

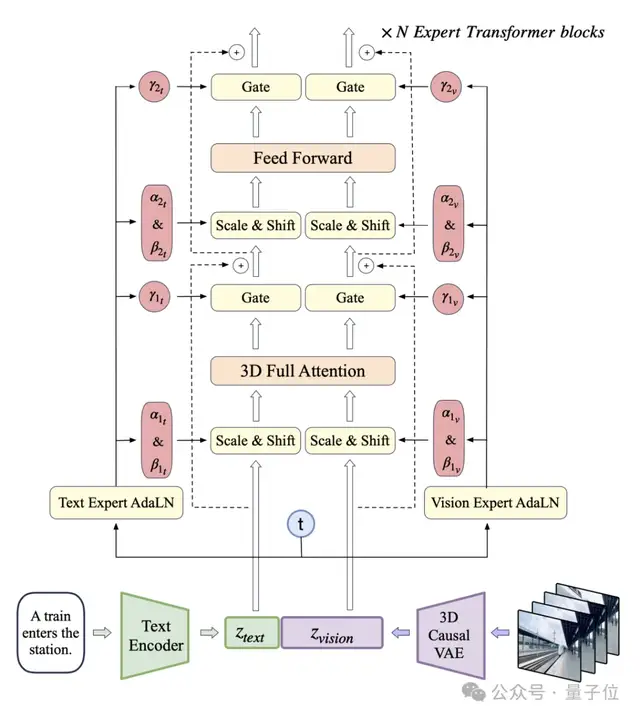

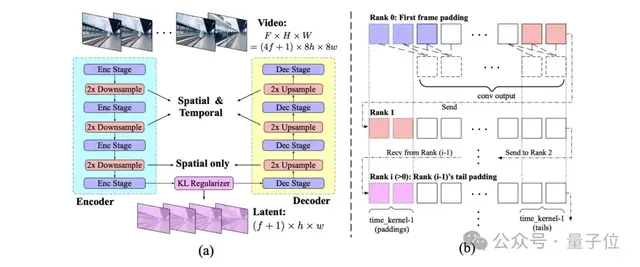

怎么做到的?首先是CogVideo的升級(jí),主要集中體現(xiàn)在了內(nèi)容連貫性、可控性和訓(xùn)練效率等方面的能力提升。

其整體的模型框架如下圖所示,是基于多個(gè)專家Transformer模塊,通過文本編碼器將輸入的文本轉(zhuǎn)化為潛在向量,再經(jīng)由3D卷積和多層專家模塊處理,生成連續(xù)的視頻序列。

整個(gè)過程可視為將自然語(yǔ)言描述轉(zhuǎn)化為動(dòng)態(tài)視覺內(nèi)容的復(fù)雜系統(tǒng)。

在模型架構(gòu)設(shè)計(jì)中,CogVideoX特別采用了因果3D卷積(Causal 3D Convolution),以高效捕捉時(shí)空維度上的復(fù)雜變化,使得模型能夠更加精確地理解和生成富有細(xì)節(jié)的場(chǎng)景。

同時(shí),該模型引入了專家自適應(yīng)層歸一化(AdaLN),通過動(dòng)態(tài)調(diào)整不同模塊的特性,從而在視覺表現(xiàn)上實(shí)現(xiàn)更自然、更具連貫性的視頻生成。

為了應(yīng)對(duì)視頻壓縮與計(jì)算效率的挑戰(zhàn),CogVideoX采用了3D VAE結(jié)構(gòu),通過對(duì)視頻特征在空間和時(shí)間上的下采樣,大幅降低了視頻存儲(chǔ)與計(jì)算開銷。

這意味著即便在資源有限的計(jì)算環(huán)境下,CogVideoX仍能生成高質(zhì)量的視頻內(nèi)容,顯著提升了其應(yīng)用的可行性。

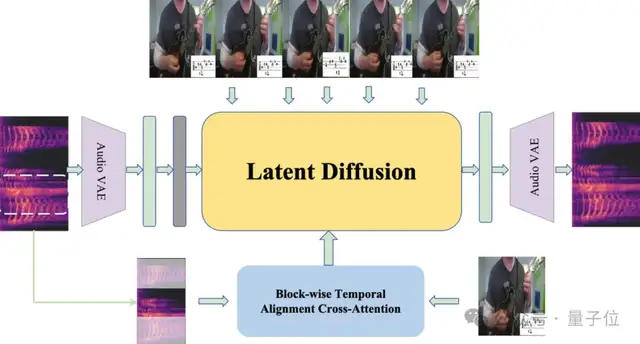

如果說(shuō)CogVideoX負(fù)責(zé)生成可視的動(dòng)態(tài)內(nèi)容,那么CogSound則賦予這些畫面以聽覺上的生命。

CogSound是一種為無(wú)聲視頻自動(dòng)生成音效的模型,能夠基于視頻內(nèi)容智能合成背景音樂、對(duì)話音頻及環(huán)境音效,其架構(gòu)如下圖所示:

CogSound的核心技術(shù)依托于GLM-4V的多模態(tài)理解能力,能夠精確解析視頻中的語(yǔ)義和情感,并生成匹配的音效。

例如,在展示森林景觀的視頻中,CogSound能夠生成鳥鳴和風(fēng)吹樹葉的聲音;而在城市街景中,則會(huì)生成車流與人群的背景噪音。

為實(shí)現(xiàn)這一目標(biāo),CogSound利用了潛空間擴(kuò)散模型(Latent Diffusion Model),通過將音頻特征從高維空間進(jìn)行壓縮并再擴(kuò)展,從而有效地生成復(fù)雜音效。

此外,CogSound通過塊級(jí)時(shí)間對(duì)齊交叉注意力(Block-wise Temporal Alignment Cross-attention)機(jī)制,確保生成的音頻在時(shí)間維度和語(yǔ)義上與視頻內(nèi)容高度一致,避免了傳統(tǒng)音畫合成中常見的錯(cuò)位和不協(xié)調(diào)問題。

這便是智譜CogVideoX能力提升和CogSound背后的技術(shù)秘笈了。

短視頻邁入了AI時(shí)代這是智譜在很早之前便提出的一個(gè)認(rèn)知,而隨著此次CogSound的發(fā)布,其多模態(tài)的矩陣可謂是再添一塊拼圖。

而它的多模態(tài)之路,可以追溯到2021年,具體到細(xì)節(jié)領(lǐng)域分別是:

文本生成(GLM)、圖像生成(CogView)、視頻生成(CogVideoX)、音效生成(CogSound)、音樂生成(CogMusic)、端對(duì)端語(yǔ)音(GLM-4-Voice)、自主代理(AutoGLM)。

若問這一步步走來(lái),對(duì)現(xiàn)在的技術(shù)和行業(yè)帶來(lái)了哪些改變,答案或許是——

起碼在短視頻制作領(lǐng)域,是時(shí)候可以邁入AI時(shí)代了。

首先就是更高質(zhì)量、更符合物理世界規(guī)則的生成視頻,在內(nèi)容邏輯和視覺上基本上可以夠到短視頻制作的門檻。

加之CogVideoX還支持非常多的尺寸,更符合用戶在各種場(chǎng)景下的制作需求。

而最為關(guān)鍵的一點(diǎn),隨著CogSound把視頻生成拉進(jìn)“有聲電影”時(shí)代,使得輸出的結(jié)果不僅滿足了視覺的要求,更是符合了真實(shí)物理世界中的聽覺要求。

正如智譜所言:

據(jù)悉,CogSound即將在智譜清言上線,而且智譜還將發(fā)布音樂模型CogMusic。

加之此前已經(jīng)發(fā)布的GLM-4-Voice人聲模型,智譜可以說(shuō)是把視頻生成中的“音”這塊全面hold住。

總而言之,現(xiàn)在做短視頻,或許就成了有想法就能實(shí)現(xiàn)的事兒了。

- 免責(zé)聲明

- 本文所包含的觀點(diǎn)僅代表作者個(gè)人看法,不代表新火種的觀點(diǎn)。在新火種上獲取的所有信息均不應(yīng)被視為投資建議。新火種對(duì)本文可能提及或鏈接的任何項(xiàng)目不表示認(rèn)可。 交易和投資涉及高風(fēng)險(xiǎn),讀者在采取與本文內(nèi)容相關(guān)的任何行動(dòng)之前,請(qǐng)務(wù)必進(jìn)行充分的盡職調(diào)查。最終的決策應(yīng)該基于您自己的獨(dú)立判斷。新火種不對(duì)因依賴本文觀點(diǎn)而產(chǎn)生的任何金錢損失負(fù)任何責(zé)任。

新火種

2024-11-09

新火種

2024-11-09