中富金石:ChatGPT多模態重磅升級加速AI應用端需求

事件刺激:

今年以ChatGPT為代表的AI科技點燃市場熱度,隨著ChatGPT、Midjourney等現象級爆品出現,微軟、Adobe、Salesforce、Zoom等軟件巨頭紛紛推出商業化產品,當前海外已進入商業落地階段。ChatGPT引領的AI技術,將迎來大模型時代,作為大模型的基建底座,推動存算傳需求激增。

最新消息:

9月26日,微軟宣布Copilot將以初期版本形式推出,隨后在今年秋天擴展到必應、Edge瀏覽器以及微軟365 Copilot,而全球版 Copilot將在11月1日起面向企業用戶提供服務。New Bing中集成DALL 3模型以加強圖像AI功能,并向Bing聊天企業版提供多模態可視化搜索和圖像創建工具,將加速AI應用端需求。

9月21日,華為云加速器—盤古大模型AI生態加速營在上海開營,作為中國首個全棧自主的AI大模型,盤古3.0包括"5+N+X"三層架構,將幫企業熟悉盤古、昇騰技術能力,加速AI驅動的規模化成長。

關注邏輯:

多模態AI加速突破,圖生文能力打開GPT應用

9月20日,OpenAI宣布推出新版文生圖AI工具DALL-E3,DALL-E3通過集成ChatGPT能力實現多項升級。此前,根據TheInformation報告,OpenAI即將推出多模態大模型GPT-vision。9月25日,根據OpenAI官網信息,ChatGPT即將在兩周內對Plus和Enterprise用戶開放一系列新功能,包括圖像讀取與理解(即圖生文),以及語音對話能力。用戶可以通過語音直接對ChatGPT對話,而ChatGPT也可以直接以語音的方式回復用戶,使用一種新的文生語音模型,其中可選的五種聲音由chatgpt向配音演員特別定制而來。

隨著人工智能感知、交互和生成能力的快速發展,多模態大模型正推動人工智能邁進“通感”時代,應用場景和生態也將進一步豐富。多模態功能已成為各家AI大模型的必爭之地。Meta最近推出AudioCraft,通過AI生成音樂;谷歌Bard及必應機器人均已部署多模式功能;蘋果也在試驗AI生成語音Personal Voice。而語音與圖像數據大小顯著高于文本,多模態大模型的訓練推理算力需求將大幅攀升。

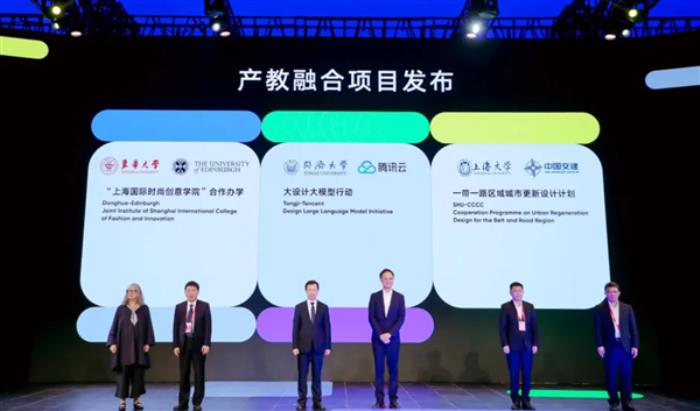

國內”大模型國家隊“組建,大模型進入快速發展期

今年5月,國家啟動大模型標準化工作,設立大模型專題組,其中百度、華為、阿里、360等入局“大模型國家隊”,展示了目前國內較高水平數個大模型。《中國人工智能大模型地圖研究報告》顯示,從全球已經發布的大模型分布來看,中美兩國數量合計占全球總數的超 80%,美國在大模型數量方面居全球之首,中國目前則已進入大模型快速發展期,與美國保持同步增長態勢。據不完全統計,截止今年5月,中國10億參數規模以上的大模型已發布79個。

截止目前國內已經有上百個大模型產品問世。而從地緣的角度來說,占據C位的還是北京和上海,其中北京的大模型公司數量和研發數量均獨占鰲頭,多達54個;而上海的優勢則在AI算力方面。其他的一線城市如深圳、廣州、杭州等也都有多個大模型創業公司。據統計,國內有11家大模型陸續通過《生成式人工智能服務管理暫行辦法》備案,其中北京5家,上海3家率先上線,廣東2家和安徽1家也陸續開放。從去年到現在,國內已經發生了接近100起以上的大模型行業的融資案例。從整個產業的投入估值來說, 2023年這個行業新增投入大概在150億元到200億元。

萬卡規模、萬億參數,大模型有“高門檻”

大模型的快速迭代,需要高效算力和存儲基礎設施的加持。一方面,算力是大模型的引擎。語言類、視覺類模型容量和相應的算力需求都在快速擴大,金融大模型發展的背后是龐大的算力支撐。如果用“算力當量”(PetaFlops/s-day,PD),即每秒千萬億次的計算機完整運行一天消耗的算力總量,來對人工智能任務所需算力總量進行度量,大模型訓練需要幾百甚至幾千PD的算力支持,意味著需要巨大的算力成本。如當前GPT-4和PaLM-2的算力當量已經達到GPT-3的數十倍,而谷歌正在開發的下一代多模態大模型Gemini,其訓練量碾壓GPT-4,達到后者5倍。

大模型光有算力遠遠不夠,還取決于數據規模和數據質量,近幾年,通用大模型的參數量快速增長。2016年OpenAI發布Gym強化學習平臺,2018年GPT-1問世,模型參數為1.17億,經過不斷迭代,GPT-4參數規模達到1.76萬億。Google從2017年發布Transformer(6500萬參數)架構以來,陸續發布BERT(2018年,3億參數)、T5(2019年,110億參數),參數規模逐步提高。近期,Google發布通才模型PaLM-E,這是全球最大的視覺語言模型,包含5620億參數。

以ChatGPT3.0為例進行拆解,訓練一次的成本約為140萬美元,對于一些規模更大的模型來說,訓練成本介于200萬美元-1200萬美元之間。隨著算力需求持續增長,AI服務器的應用場景更加廣泛。Trendforce預估,預估2022年全球搭載GPGPU的AI服務器年出貨量占整體服務器比重近1%,即約14萬臺。預計2023年其出貨量年成長可達8%,到2026年預計全球搭載GPGPU的AI服務器出貨量將達到22.5萬臺左右,2022-2026年CAGR將達10.8%。根據IDC預測,到2027年中國加速服務器市場規模將達到164億美元其中非GPU服務器市場規模將超過13%。

隨著AI商業化落地節奏加快,后續需求有望逐步釋放,將會對算力多個環節產生增量,大模型整個數據中心的架構都會發生改變,從AI服務器、到存儲、再到網絡的全棧方案都需要適應大模型時代的需求,同時軟件服務公司將為大模型的研發及穩定運行提供安全支撐。

- 免責聲明

- 本文所包含的觀點僅代表作者個人看法,不代表新火種的觀點。在新火種上獲取的所有信息均不應被視為投資建議。新火種對本文可能提及或鏈接的任何項目不表示認可。 交易和投資涉及高風險,讀者在采取與本文內容相關的任何行動之前,請務必進行充分的盡職調查。最終的決策應該基于您自己的獨立判斷。新火種不對因依賴本文觀點而產生的任何金錢損失負任何責任。

新火種

2023-09-27

新火種

2023-09-27