手機流暢運行470億大模型:上交大發布LLM手機推理框架PowerInfer-2,提速29倍

蘋果一出手,在手機等移動設備上部署大模型不可避免地成為行業關注焦點。

然而,目前在移動設備上運行的模型相對較小(蘋果的是3B,谷歌的是2B),并且消耗大量內存,這在很大程度上限制了其應用場景。

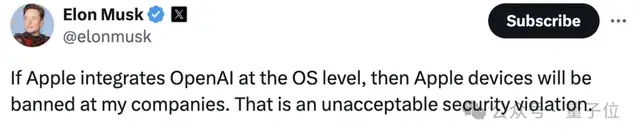

即使是蘋果,目前也需要與OpenAI合作,通過將云端GPT-4o大模型嵌入到操作系統中來提供能力更強的服務。

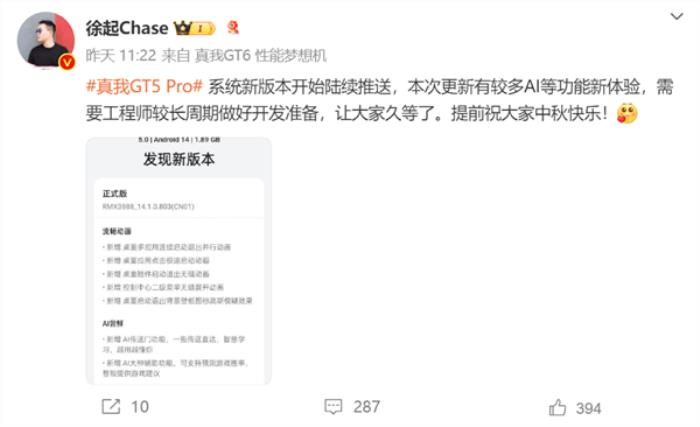

這樣一來,蘋果的混合方案引起了非常多關于數據隱私的討論和爭議,甚至馬斯克都下場討論。

既然終端側本地部署大模型的方案既讓手機用戶享受到AI強大的智能,又能保護好自己的隱私安全,為什么蘋果還要冒著侵犯隱私的風險選擇聯手OpenAI采用云端大模型呢?主要挑戰有兩點:

為了解決上述挑戰,上海交大IPADS實驗室推出了面向手機的大模型推理引擎(目前論文已在arxiv公開):PowerInfer-2.0。

PowerInfer-2.0能夠在內存有限的智能手機上實現快速推理,讓Mixtral 47B模型在手機上達到11 tokens/s的速度。

與熱門開源推理框架llama.cpp相比,PowerInfer-2.0的推理加速比平均達到25倍,最高達29倍。

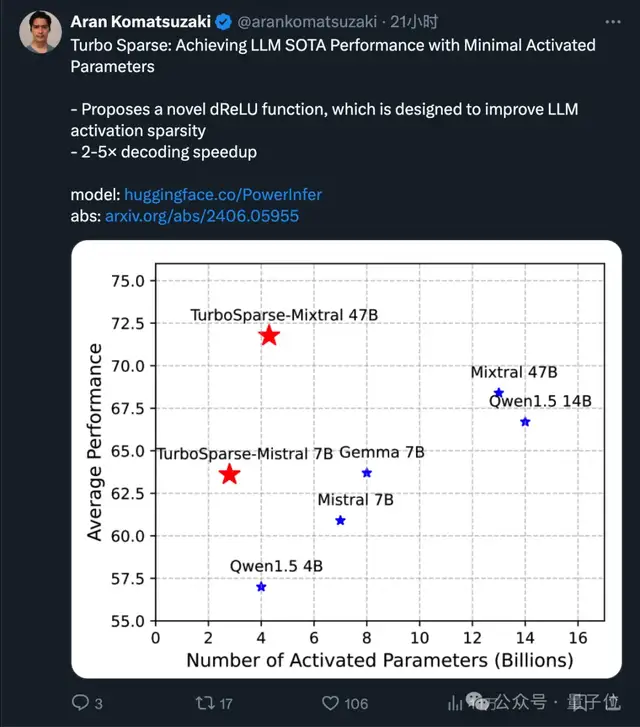

為了充分釋放出PowerInfer-2.0框架的最大潛力,上海交大團隊還提出了配套的大模型優化技術Turbo Sparse,相關論文近期也上傳了arxiv,并且已經在業內引起關注。

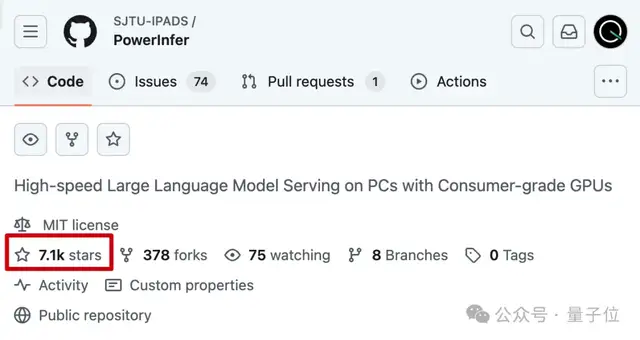

另外值得一提的是,去年底上海交大團隊提出了針對PC場景的快速推理框架PowerInfer-1.0,在4090等消費級顯卡的硬件上,實現了比llama.cpp高達11倍的推理加速,曾連續三天登頂GitHub趨勢榜,5天獲得了5k的GitHub star,目前已達到7.1k star。

相比PC,手機的內存和算力受到的約束更多,那么這次的PowerInfer-2.0是如何針對手機場景加速大模型推理呢?

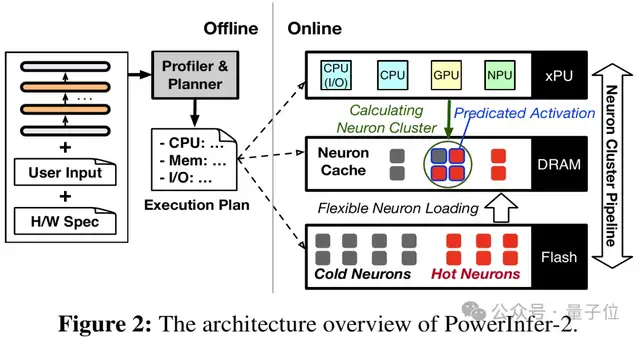

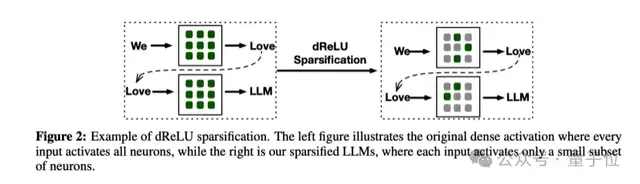

首先,針對手機運行內存(DRAM)不足的問題,PowerInfer-2.0利用了稀疏模型推理時的一個特點:每次只需要激活一小部分神經元,即“稀疏激活”。沒有被激活的神經元即使不參與AI模型的推理計算,也不會對模型的輸出質量造成影響。

稀疏激活為降低模型推理的內存使用創造了新的機會。為了充分利用稀疏激活的特性,PowerInfer-2.0把整個神經網絡中的神經元分成了冷、熱兩種,并在內存中基于LRU策略維護了一個神經元緩存池。

近期頻繁激活的”熱神經元”被放置在運行內存中,而“冷神經元”只有在被預測激活的時候,才會被拉進內存,大幅降低了內存使用量。

其實冷熱神經元分類,是繼承自PowerInfer-1.0已有的做法。

而在去年12月,蘋果在面向端側的大語言模型推理方案“LLM in a Flash”中提出了和神經元緩存類似的“滑動窗口”技術。但這些工作主要針對的都是PC環境,直接遷移到手機環境,還會遇到新的難題。

首先手機平臺的硬件條件遠不及PC,無論是算力、內存總量還是存儲帶寬,都與PC存在較大差距。

其次,手機硬件平臺存在CPU、GPU、NPU三種異構的計算單元,十分復雜。各大硬件平臺宣發時都會強調一個總算力,實際上是把CPU、GPU、NPU提供的算力加起來。然而真正跑起大模型來,能不能高效利用各種異構算力還是個問題。

針對這一點,PowerInfer-2.0進一步把粗粒度的大矩陣計算分解成細粒度的“神經元簇”。

每個神經元簇可以包含若干個參與計算的神經元。對于不同的處理器,會根據處理器的特性來動態決定劃分出來的神經元簇的大小。

例如,NPU擅長于做大矩陣的計算,那么可以把所有神經元合并成一個大的神經元簇,一起交給NPU計算,這樣就可以充分利用NPU的計算能力。而在使用CPU時,可以拆出多個細粒度的神經元簇,分發給多個CPU核心一起計算。

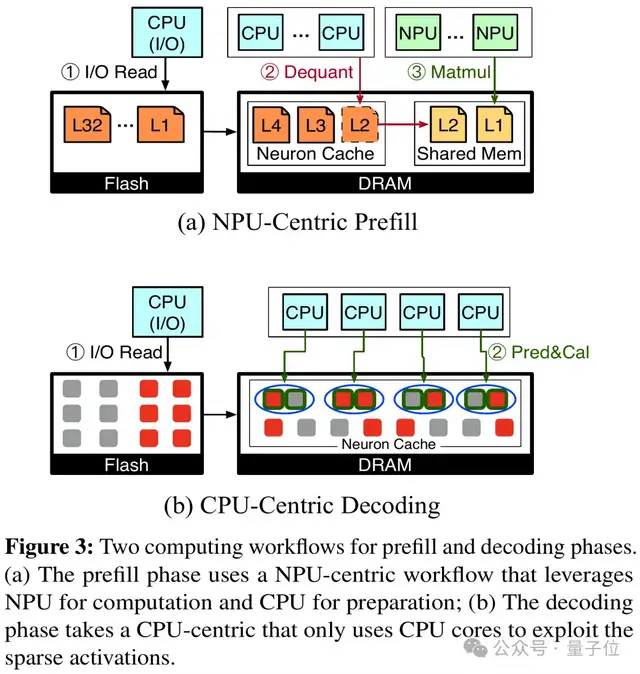

具體而言,PowerInfer-2.0為模型推理的預填充階段(Prefill)和解碼階段(Decoding)分別設計了兩套神經元簇的劃分方案:

預填充階段會一次性輸入很多token,基本上絕大部分神經元都會被激活,因此選擇使用大神經元簇交給NPU計算。CPU此時也沒有閑著,在后臺為NPU執行反量化模型權重的操作。

解碼階段每次只有一個token,具有較高的稀疏性,因此更加適合劃分成若干細粒度的神經元簇,交給CPU靈活調度和執行計算。

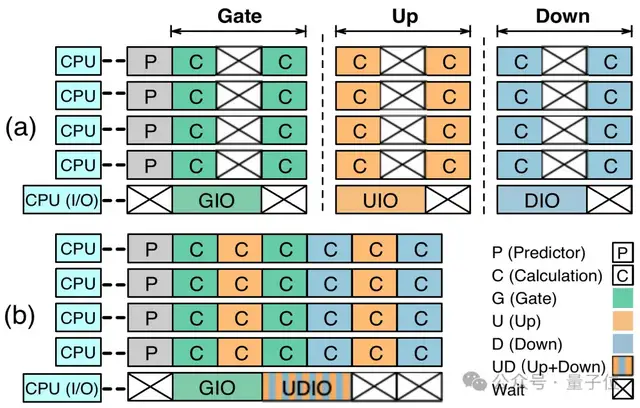

神經元簇這一概念除了能夠更好的適應手機的異構計算環境,還能天然地支持計算與存儲I/O的流水線并行執行。

PowerInfer-2.0提出了分段神經元緩存和神經元簇級的流水線技術,在一個神經元簇等待I/O的同時,可以及時地把另一個已經準備好的神經元簇調度到處理器上進行計算,從而充分隱藏了I/O的延遲。

同時,這種基于神經元簇的流水線打破了傳統推理引擎中逐矩陣計算的方式,可以允許來自不同參數矩陣的神經元簇交錯執行,達到最高的并行效率。

I/O加載神經元的速度對于模型推理也至關重要。

分段緩存會針對不同的權重類型采取不同策略(如注意力權重、預測器權重、前饋網絡權重)采取不同的緩存策略,提高緩存命中率,減少不必要的磁盤 I/O。

緩存還會使用LRU替換算法動態更新每個神經元的實際冷熱情況,確保緩存中放著的都是最熱的神經元。此外PowerInfer-2.0還針對手機UFS 4.0存儲的性能特點,設計了專門的模型存儲格式,提高讀取性能。

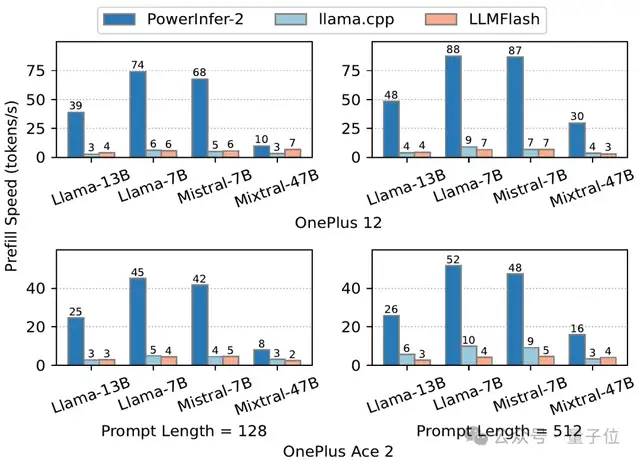

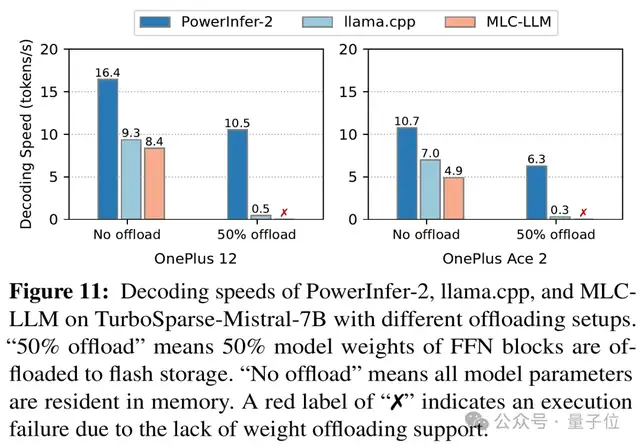

最后再來看一下實測成績,使用一加12和一加Ace 2兩款測試手機,在內存受限的情況下,PowerInfer-2.0的預填充速度都顯著高于llama.cpp與LLM in a Flash(簡稱“LLMFlash”):

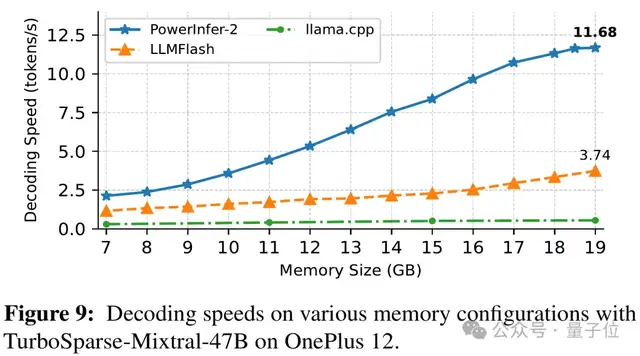

解碼階段同樣是PowerInfer-2.0占據很大優勢。特別是對于Mixtral 47B這樣的大模型,也能在手機上跑出11.68 tokens/s的速度:

而對于Mistral 7B這種可以放進手機運行內存的模型,PowerInfer-2.0可以節約40%內存的情況下,達到與llama.cpp和MLC-LLM同水平甚至更快的解碼速度:

PowerInfer-2.0是一個模型-系統協同設計的方案,也就是需要模型中可預測稀疏性的配合。

如何以低成本的形式調整模型以適配PowerInfer-2.0框架,也是一個重大挑戰。

傳統簡單的ReLU稀疏化會給模型原本的能力造成不小的影響。

為了克服這個問題,上海交大IPADS聯合清華和上海人工智能實驗室提出一個低成本地稀疏化方法,不僅大幅提升模型的稀疏性,還能保持住模型原本的能力!

首先,論文深入分析了模型稀疏化中的問題:

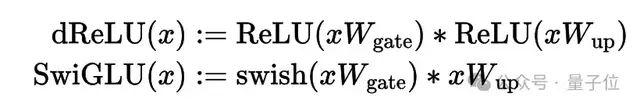

為了提升模型的稀疏度,論文在ReLU基礎上提出dReLU激活函數,采用替換原有激活函數后繼續預訓練的方式增加模型稀疏性。

將SwiGLU替換為dReLU一方面直觀地提高了輸出值中的零元素比例,另一方面能更有效地在稀疏化的過程中復用原本模型訓練完成的gate和up矩陣權重。

為了克服模型能力下降的問題,團隊收集了包括網頁、代碼和數學數據集在內的多樣化繼續訓練語料庫。高質量、多樣化的訓練數據有助于模型在稀疏化后更好地保持和提升性能。

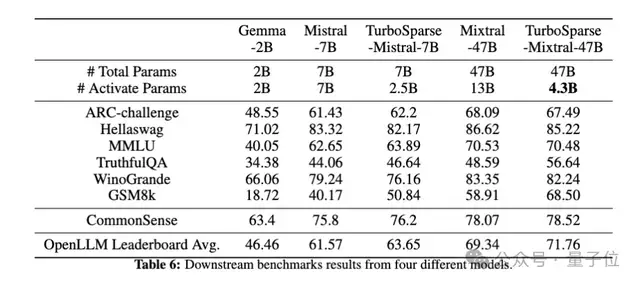

最后,團隊訓練了2個TurboSparse大模型進行驗證,分別是8x7B和7B的大模型。得益于高質量的繼續訓練語料,TurboSparse系列模型模型的精度甚至還能反超原版模型(具體見表6)。

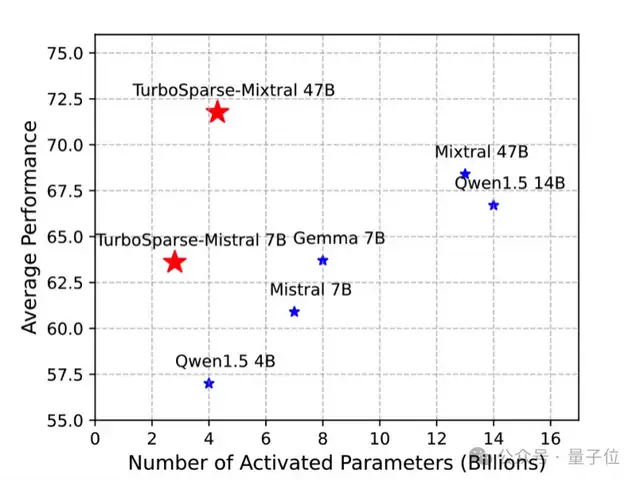

而在稀疏度方面效果也非常顯著。相比于原本的Mixtral模型需要激活13B參數量,TurboSparse-Mixtral只需要激活4.3B的參數量,激活的參數量是原本模型的三分之一。

而關于稀疏化過程的成本問題,TurboSparse論文中介紹,改造過程中模型需要繼續訓練150B tokens,相比于預訓練(假設3T tokens)還不到5%,說明其成本是很低的。

從推理框架和改造模型兩個角度出發,上海交大團隊的成果實現了大語言模型在手機等資源受限場景下的快速推理。

而且這套方案的潛力不止于手機,未來在車載設備、智能家居等方向還有更多應用前景。

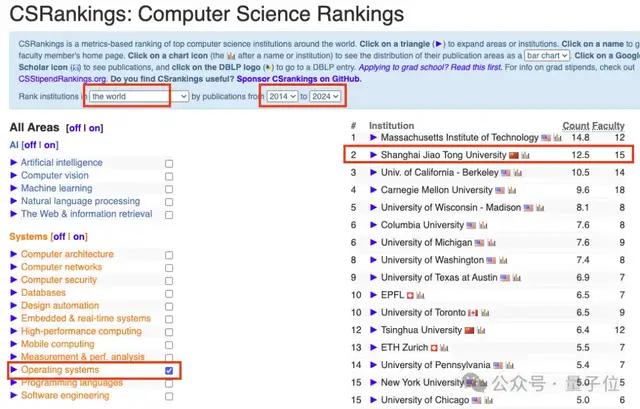

最后再正式介紹一下團隊。上海交通大學并行與分布式系統研究所(簡稱IPADS),由陳海波教授領導,現有13名教師,100多名學生。

IPADS長期從事計算機系統的研究,近10年在權威榜單CSRankings的Operating Systems領域排名全球前二,僅次于MIT;上海交大也是排名前十中唯一上榜的亞洲高校。

目前,上海交大IPADS已經在Huggingface上開放了稀疏化的模型權重。在未來,如果PowerInfer-2.0能夠與手機廠商進一步緊密合作,相信可以加速相關技術走出實驗室,落地到各種真實場景。

- 免責聲明

- 本文所包含的觀點僅代表作者個人看法,不代表新火種的觀點。在新火種上獲取的所有信息均不應被視為投資建議。新火種對本文可能提及或鏈接的任何項目不表示認可。 交易和投資涉及高風險,讀者在采取與本文內容相關的任何行動之前,請務必進行充分的盡職調查。最終的決策應該基于您自己的獨立判斷。新火種不對因依賴本文觀點而產生的任何金錢損失負任何責任。

新火種

2024-06-13

新火種

2024-06-13