馬斯克說人工智能比核彈更危險?監管法案有什么規定?

最近當比爾·蓋茨等互聯網大佬都在歡呼,AI技術將開啟下一個互聯網時代的時候,馬斯克卻說人工智能比核彈更危險,這是怎么回事呢?

馬斯克曾對自己的自傳作者說,我想了想什么東西能真正影響人類社會,想起來三個:互聯網、可持續能源和太空旅行。所以我們發現與他有關聯的公司都圍繞著這三個領域,其中包括大名鼎鼎的OpenAI公司,OpenAI這個名字也是馬斯克起的。

我們將相關關鍵詞在全網進行檢索,發現有多家媒體報道稱,在2023年11月舉行的DealBook峰會上,馬斯克曾公開提到,在他看來人工智能比核彈更危險,并且應該對人工智能實施某種監管。

馬斯克為什么一邊共同創立了最著名的OpenAI,一邊又形容人工智能是危險的事物,甚至作為研發方主動要求相關部門進行監管。那么馬斯克對人工智能究竟是一種什么態度?

公開資料顯示,DealBook峰會2011年由《紐約時報》專欄作家安德魯·索金主持創辦,峰會主要邀請全球具有影響力的政治企業以及文化領袖與精英分享經驗及觀點。在YouTube上的《紐約時報》子賬號“紐約時報活動”中可以看到,在對馬斯克采訪的視頻中,訪談進行到大約60分鐘時,馬斯克提到了了人工智能安全性的問題,他解釋了當初創立OpenAI的初衷,正是基于自己對于人工智能安全性的擔憂。

在人工智能安全性的問題上,谷歌創立人拉里·佩奇和馬斯克的看法并不相同。12月7日《紐約時報》科技版塊發表了一篇文章,內容主要講述的是硅谷的AI爭奪之戰是如何被點燃的。這篇文章開篇就展示了一張圖片,畫中的人物正是拉里·佩奇和馬斯克,再現的場景是2015年在馬斯克生日派對上,當著眾多賓客的面,兩人針鋒相對地就人工智能展開了激烈的辯論,最新出版的《馬斯克傳》也對這場辯論進行了一個段落的描寫。文章和自傳都描寫到關于對待人工智能,馬斯克堅持是要建立防火墻,不能讓人工智能取代人類,那樣的話人類將會滅亡,而拉里·佩奇則認為人類最終將與人工智能機器融合,這只不過是進化的下一個階段。

拉里·佩奇收購的DeepMind和馬斯克創立的OpenAI,或許大家不是很熟悉,但是一定使用或者聽說過他們各自生產研發的人工智能產品。2016年3月,人工智能程序AlphaGo擊敗了世界圍棋冠軍李世石,全球當時有2億人觀看了那場在互聯網上直播的比賽,AlphaGo正是由DeepMind公司開發的。而大名鼎鼎的聊天機器人ChatGPT則是由OpenAI于2022年底發布的,只不過那個時候馬斯克因為公司控制權的問題,已經離開OpenAI四年了,后續的投資方變成了微軟公司,由非盈利轉為盈利模式。雖然創立之初,兩家公司對于人工智能持截然不同的態度,但是客觀上他們都促進了人工智能的發展,尤其是OpenAI,有數據表明每周有1億人在使用這個人工智能的模型,充分展現了人工智能的潛力和風險。

馬斯克拋出人工智能比核彈更危險這一言論的目的,是要求對人工智能進行監管。這讓我們想起今年3月14日GPT-4發布之后不久,馬斯克就和其他1000多名科技界領袖與研究人員呼吁暫停開發比GPT-4更強大的AI系統。他們在公開信當中說,AI開發人員陷入了一場失控的競賽,開發和部署越來越強大的數字思維,以至于所有人甚至包括它們的創造者,也無法理解、預測或可靠地控制它們。暫停開發將為人工智能系統引入共享安全協議提供時間。如果無法快速實施這樣的暫停,政府應該介入并制定暫停期。然而事件后來的發展是,人工智能的開發并沒有按下暫停鍵,但是馬斯克等人的呼吁也并非沒有得到回應。

2023年10月30日,美國總統拜登在白宮簽署人工智能監管行政令,這份名為《安全、可靠和可信賴的開發和使用人工智能》的行政命令包含多項要求,其中包括美國最強人工智能系統的研發人員,需與政府分享其安全測試結果及其他關鍵信息,制定嚴密的合成生物檢查新標準,防范使用人工智能設計危險生物材料的風險等多方面的要求。

馬斯克強調自己是

蔣南頔(中國執業律師):“此前美國對于人工智能的監管更多是停留在討論和輿論層面,一方面此前人工智能技術尚未發展到需要法規進行規制的一個時期,而對于發展初期的新技術政策層面一般會采取較為寬松的態度,以避免過于嚴格的制度規范阻礙技術的發展。那另一方面,各方利益還在沖突和博弈,而今年作為通用人工智能的元年,以ChatGPT為代表的深層次人工智能模型,開啟了通用人工智能模型的新時代,人工智能帶來的希望和風險更為真切地進入人們的視野,其發展速度也使得政策制定者們更真切地感受到了制定相應規則制度的一個迫切性。”

就在美國發布一系列舉措后,布魯塞爾當地時間12月8日,歐洲議會歐盟委員會和27個成員國代表經過30多個小時的談判后,就《人工智能法案》達成協議,該法案被視為全球首部AI領域的全面監管法規。如果歐盟成員國和議會正式批準,預計將在2024年初生效,兩年后全面實施。與美國的監管行政令相比,歐盟的這項法案看上去是更加嚴格和詳細了。

綜合多方報道,《人工智能法案》按照不同的風險類別為人工智能技術應用進行了分類,通過識別不同風險來進行監管,嚴格禁止對人類安全造成不同風險的人工智能系統。其中包括有目的地操縱技術,利用人性弱點或根據社會行為和個人特征進行評價的系統等。人工智能公司要對其算法進行人為控制,提供技術文件,并為高風險應用建立風險管理系統。每個歐盟成員國都將設立一個監管機構,確保這些規則得到遵守。生成式人工智能也就是包含ChatGPT在內的模型,也需要遵守新的透明度要求。

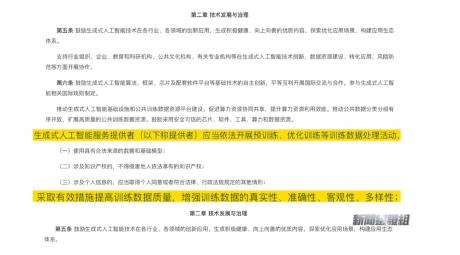

早在2023年7月,中國國家網信辦聯合國家發改委等多個部門正式發布《生成式人工智能服務管理暫行辦法》,從8月15日起實施。辦法要求生成式人工智能服務提供者采取有效措施,提高訓練數據質量,增強訓練數據的真實性、準確性、客觀性、多樣性,也明確了監管的基本原則,即對生成式人工智能服務實行包容審慎和分類分級監管。

從中外來看,人工智能的監管已經成為全世界共同的課題,但是監管的目標卻是一致的,那就是讓人工智能技術健康發展。當然各國也希望自己能在這場革命性的技術競爭當中處于優勢地位。

有網友稱,馬斯克在拋出人工智能比核彈還危險這句話之后還解釋說,雖然目前美國的人工智能技術處于領先地位,但是不能掉以輕心,因為中國的人工智能技術正在趕超,美國的人工智能只能領先12個月而已。馬斯克真的這樣說過嗎?

以關鍵詞進行全網搜索后,我們發現馬斯克關于中美人工智能相差大概12個月的說法,來自于2023年5月的一段視頻采訪。

制作人:梁茵

本期編導:張恒

文字

- 免責聲明

- 本文所包含的觀點僅代表作者個人看法,不代表新火種的觀點。在新火種上獲取的所有信息均不應被視為投資建議。新火種對本文可能提及或鏈接的任何項目不表示認可。 交易和投資涉及高風險,讀者在采取與本文內容相關的任何行動之前,請務必進行充分的盡職調查。最終的決策應該基于您自己的獨立判斷。新火種不對因依賴本文觀點而產生的任何金錢損失負任何責任。

新火種

2024-01-02

新火種

2024-01-02