「AI時(shí)刻」想在手機(jī)上本地跑AI?還是讓子彈飛一會(huì)吧!

Intel 4004

Intel i9-13900K

在2023年的科技領(lǐng)域,無論是桌面還是移動(dòng)處理器,它們都已經(jīng)開始步入了AI的新紀(jì)元。自O(shè)penAI的ChatGPT引發(fā)了AI技術(shù)的爆發(fā)性增長(zhǎng)后,AI已經(jīng)成為了2023年全球科技界的主宰主題。位于科技漩渦中心的處理器市場(chǎng)自然也受到了這股風(fēng)潮的影響。

圖片源自于互聯(lián)網(wǎng)

下半年以來,各大處理器品牌都開始著手布局AI產(chǎn)品線。NVIDIA以其無可匹敵的地位推出了H800和A800等專業(yè)AI計(jì)算加速卡。而在消費(fèi)級(jí)桌面端市場(chǎng),Intel和AMD也不甘示弱,Intel計(jì)劃在其第14代處理器Meteor Lake中首次集成AI加速引擎(NPU),而AMD在2023年發(fā)布的7040系列處理器中集成了AMD Ryzen AI引擎,這是一款專門用于神經(jīng)網(wǎng)絡(luò)AI運(yùn)算的處理單元,最高可實(shí)現(xiàn)每秒十萬億次的AI運(yùn)算。

點(diǎn)擊查看

在移動(dòng)設(shè)備領(lǐng)域,高通和聯(lián)發(fā)科也將AI計(jì)算能力作為其年度旗艦芯片的重點(diǎn)宣傳對(duì)象。蘋果的A17pro和M3也在持續(xù)優(yōu)化其NPU架構(gòu)和增加神經(jīng)引擎的核心數(shù)量,以期在蘋果未來的AI生態(tài)中發(fā)揮出更大的作用。這些新動(dòng)態(tài)都預(yù)示著,AI技術(shù)不僅正在顛覆我們的生活,更在深度重塑全球的科技格局。

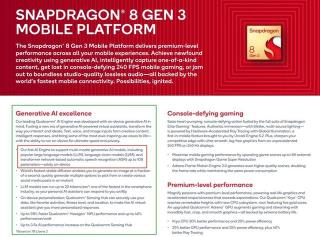

驍龍8Gen3官方宣傳資料

當(dāng)前AI在桌面端上的表現(xiàn)我們有目共睹,LLMs與SDXL為首的應(yīng)用正在對(duì)多個(gè)行業(yè)產(chǎn)生著重要沖擊,而移動(dòng)端側(cè)仿佛在2023Q4也開始了“春秋之戰(zhàn)”。那事實(shí)上,移動(dòng)端側(cè)的AI計(jì)算能力到底如何了呢?作為普通消費(fèi)者是否對(duì)移動(dòng)端本地化AI計(jì)算有所需求呢?

1.7B、10B、13B參數(shù)AI模型,這個(gè)B是個(gè)什么玩意?

AI生成-Midjourney

相信很多小伙伴都看到“高和聯(lián)”兩家旗艦芯片的宣發(fā)時(shí)都會(huì)注意到,他們都將成功運(yùn)行XXB(多少億)參數(shù)AI大語言模型的字眼作為營(yíng)銷重點(diǎn)。

圖片源自于互聯(lián)網(wǎng)

那么這個(gè)B或者說參數(shù)量級(jí)是什么意思?在AI模型領(lǐng)域,"B" 通常代表 "billion",也就是十億,它指的是模型參數(shù)的數(shù)量。例如,"LLama-2-7B" 中的 "7B" 意味著這個(gè)模型有大約70億個(gè)參數(shù)。

Meta開發(fā)的LLama-2-7B模型,服務(wù)于移動(dòng)設(shè)備或低功耗PC

參數(shù)數(shù)量是衡量模型復(fù)雜度的一個(gè)重要指標(biāo)。一般來說,參數(shù)越多,模型的復(fù)雜度越高,對(duì)數(shù)據(jù)的擬合能力越強(qiáng)。簡(jiǎn)單說,這個(gè)數(shù)字很是關(guān)鍵,通常情況下,參數(shù)越多,模型的處理能力和理解復(fù)雜性越強(qiáng),但也需要更多的計(jì)算資源。

豐富的模型參數(shù)數(shù)量如同給一位廚師以豐富的食材原料

AI生成-Midjourney

2.那參數(shù)量越大越好嗎?

不見得,在某些情況下,特化的小模型可能在特定任務(wù)或場(chǎng)景上表現(xiàn)得比大模型更好。這是因?yàn)樾∧P涂梢愿玫蒯槍?duì)特定的任務(wù)進(jìn)行優(yōu)化,而大模型可能在嘗試適應(yīng)更廣泛的任務(wù)時(shí)失去了一些特定性。

例如,假設(shè)我正在開發(fā)一款專注于美容美顏主題的AI大語言模型。我收集了所有關(guān)于美容養(yǎng)顏的網(wǎng)絡(luò)資料,最終模型的參數(shù)量達(dá)到了30億(3B)。盡管參數(shù)量較小,但模型能夠更精確地針對(duì)特定任務(wù)進(jìn)行優(yōu)化,有效避免過擬合問題。同時(shí),模型可以專注于與特定任務(wù)相關(guān)的特征,無需學(xué)習(xí)大型模型中的無關(guān)特征。相比之下,這種專注性使得小型模型在某些方面超越了參數(shù)量為30B或50B的通用大型模型。

AI生成-Midjourney

從某開源AI模型的測(cè)試成績(jī)中,我們也可以看到這一點(diǎn)。在這次測(cè)試中,LLaMA2-13B模型的子項(xiàng)分?jǐn)?shù)和平均分?jǐn)?shù)均優(yōu)于Aquila2-34B模型。

圖片源自于互聯(lián)網(wǎng)

3.主流的AI大語言模型的參數(shù)量是多少?

以我們熟知的ChatGPT為例,其GPT-3.5版本(于2022年12月發(fā)布)擁有1750億(175B)參數(shù)。而目前我們最常用、最熟悉的GPT-4在完整的120層模型中擁有18000億(1800B)參數(shù)。另一個(gè)表現(xiàn)出色的模型,Claude 2,其參數(shù)量為1300億(130B)。

圖片源自于互聯(lián)網(wǎng)

在國(guó)產(chǎn)模型方面,盡管百度的文言一心沒有公開其參數(shù)量,但根據(jù)我們的推算,其最新的4.0版本的參數(shù)量預(yù)計(jì)也已超過千億,即1000億(100B)以上。最近流行的國(guó)內(nèi)大模型月之暗面(Moonshot)的參數(shù)量也超過了千億。在部分小模型中,阿里云的通義千問開源版本達(dá)到了140億(14B)參數(shù)量。

圖片源自于截圖

4.移動(dòng)端處理AI性能的能力

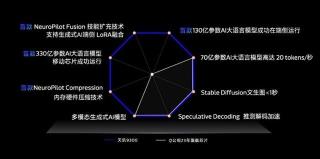

盡管MTK 9300和高通8gen3這兩款旗艦芯片沒有公開其實(shí)際運(yùn)行模型的測(cè)試過程,我們?nèi)钥梢詮乃鼈兊穆暶髦蝎@取一些信息。MTK 9300強(qiáng)調(diào),它可以在運(yùn)行參數(shù)量為70億(7B)的模型時(shí)實(shí)現(xiàn)20 tokens/s的性能。需要注意的是,"tokens"這個(gè)詞在這里的含義可能會(huì)有所不同,它可能指一個(gè)詞、一個(gè)字符,或者在某些語言中的一個(gè)字母。

MTK 9300的官方宣傳素材

在高通方面,他們聲明其8gen3芯片在運(yùn)行Meta開發(fā)的Llama 2模型時(shí)(Llama 2有7B、13B和70B版本,如果沒有特別強(qiáng)調(diào),那么一般指的是7B版本)可以達(dá)到15 tokens/s的性能。

高通驍龍8Gen3官方宣傳資料

根據(jù)一些經(jīng)驗(yàn)來判斷,在7B大小的模型中,二者的速度都已經(jīng)夠快了,可以較為流暢自然的速度來實(shí)現(xiàn)文字對(duì)話或者實(shí)時(shí)的語音識(shí)別與翻譯。

5.移動(dòng)端處理AI性能的性能巨大消耗

雖然移動(dòng)設(shè)備如手機(jī)和平板電腦確實(shí)可以在本地運(yùn)行AI模型,但由于這些設(shè)備更多地用于個(gè)人用途,運(yùn)行AI模型時(shí)會(huì)調(diào)用一些特定的資源。首當(dāng)其沖的便是神經(jīng)處理單元(NPU),這是今年幾款旗艦SoC芯片(如A17pro、8Gen3、9300、X Elite等)都在強(qiáng)調(diào)的部分。NPU是專門用于神經(jīng)網(wǎng)絡(luò)處理的處理器,擁有高效的矩陣乘法和卷積運(yùn)算能力。在處理AI任務(wù)時(shí),NPU主要用于執(zhí)行模型的推理。

AI生成-Midjourney

此外,手機(jī)的中央處理單元(CPU)和圖形處理單元(GPU)也會(huì)實(shí)時(shí)參與其中,負(fù)責(zé)執(zhí)行模型的解碼、預(yù)處理和后處理等任務(wù)。同時(shí),手機(jī)的隨機(jī)存取內(nèi)存(RAM)也會(huì)被大量使用。對(duì)于熟悉AI模型的用戶來說,無論是在PC本地的LLMS還是SDXL上,對(duì)內(nèi)存和顯存的占用都是相當(dāng)大的。在移動(dòng)設(shè)備上,RAM主要用于存儲(chǔ)AI模型、數(shù)據(jù)和中間結(jié)果。在處理AI任務(wù)時(shí),內(nèi)存的帶寬和容量是影響性能的重要因素。

圖片源自于互聯(lián)網(wǎng)

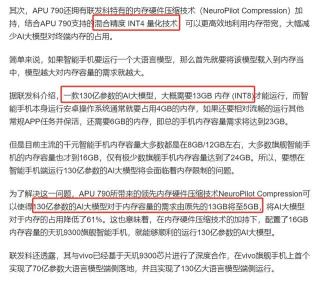

對(duì)用戶實(shí)際使用影響最大的部分是大量的RAM消耗。在MTK 9300的官方發(fā)布中,聯(lián)發(fā)科官方介紹說,一個(gè)擁有1300億參數(shù)的AI大模型大約需要13GB的內(nèi)存(在INT8精度下)才能運(yùn)行。因此,即使是一個(gè)擁有70億參數(shù)的模型,也大約需要7GB的內(nèi)存。盡管存在一些技術(shù),如INT4量化(通過降低計(jì)算精度以減少內(nèi)存消耗),但是在完整調(diào)用運(yùn)行一個(gè)7B的AI模型時(shí),也需要至少4GB的內(nèi)存消耗。這對(duì)于RAM資源本就非常寶貴的Android系統(tǒng)來說,無疑是雪上加霜。

圖片源自于互聯(lián)網(wǎng)

可以想象,如果未來本地的AI模型普及開來,當(dāng)前主流的8GB手機(jī)RAM肯定是不夠用的。一旦打開AI程序,用戶可能會(huì)面臨其他應(yīng)用被強(qiáng)制關(guān)閉,以及由于反復(fù)調(diào)用部分應(yīng)用而導(dǎo)致的系統(tǒng)卡頓等問題。

6.AI落地移動(dòng)端?讓子彈飛一會(huì)

圖片源自于互聯(lián)網(wǎng)

不少小伙伴看到這里,都以為我在唱空移動(dòng)端側(cè)AI,但其實(shí)錯(cuò)了,其實(shí)我對(duì)于移動(dòng)端AI應(yīng)用是一個(gè)多頭。畢竟手機(jī)是我們?nèi)粘I钪凶畛S玫闹悄茉O(shè)備,而且我們也看到,從OpenAI布局移動(dòng)版的ChatGPT,到國(guó)內(nèi)大模型紛紛轉(zhuǎn)戰(zhàn)移動(dòng)端APP,再到手機(jī)廠商的“百模大戰(zhàn)”,還有智能汽車領(lǐng)域的算力大辯論,都表明移動(dòng)端的AI應(yīng)用潛力巨大。

圖片源自于互聯(lián)網(wǎng)

而發(fā)展方向上,我認(rèn)為移動(dòng)端側(cè)當(dāng)前十分強(qiáng)調(diào)的本地LLMs(大語言模型)并不會(huì)是最終的發(fā)力方向,因?yàn)橛捎谠诰鹊南拗疲镜豅LMs的質(zhì)量可能堪憂,即使可以輸出較長(zhǎng)的對(duì)話內(nèi)容,但其邏輯性與合理性上都會(huì)與已知的PC端產(chǎn)品有較大的差距。

那么移動(dòng)端該如何發(fā)展本的AI呢?我認(rèn)為首當(dāng)其沖的應(yīng)該是圖像識(shí)別與TTS(語音合成系統(tǒng))。移動(dòng)設(shè)備(涵蓋手機(jī)與智能汽車)作為視覺與聽覺傳播的重要媒介,其能帶來的遠(yuǎn)不止文字流的輸出。

關(guān)于圖像識(shí)別功能,隨著手機(jī)攝像頭技術(shù)的不斷進(jìn)步,圖像識(shí)別在移動(dòng)端的應(yīng)用越來越廣泛。例如,人臉識(shí)別、物體識(shí)別、場(chǎng)景識(shí)別等。未來,隨著手機(jī)端AI算力的提升,圖像識(shí)別的準(zhǔn)確性和實(shí)時(shí)性將得到顯著改善。

《GPT長(zhǎng)眼睛了!史詩(shī)級(jí)功能悄咪咪發(fā)布!》點(diǎn)擊查看

《GPT長(zhǎng)眼睛了!史詩(shī)級(jí)功能悄咪咪發(fā)布!》點(diǎn)擊查看此外,隨著智能汽車移動(dòng)端AI計(jì)算能力的提升,圖像識(shí)別技術(shù)在智能汽車中的應(yīng)用將變得更加廣泛和精準(zhǔn)。例如,自動(dòng)駕駛系統(tǒng)可以借助圖像識(shí)別技術(shù)實(shí)時(shí)識(shí)別路況、標(biāo)志牌、行人以及其他車輛,從而做出準(zhǔn)確的駕駛決策。同時(shí)還可以衍生出圖像識(shí)別可以用于識(shí)別車輛的周圍環(huán)境,并提供相關(guān)的服務(wù)信息。例如,車輛可以通過圖像識(shí)別來識(shí)別附近的餐廳、酒店等信息,并提供導(dǎo)航和預(yù)訂等服務(wù),催生新的業(yè)態(tài)。

另外一點(diǎn)就是語音合成(TTS)這也是本次OpenAI開發(fā)者大會(huì)中提及的重點(diǎn)內(nèi)容,該技術(shù)結(jié)合AI,可以將文本轉(zhuǎn)換為自然語音,廣泛應(yīng)用于智能助手、語音導(dǎo)航、語音閱讀等場(chǎng)景。隨著手機(jī)端AI算力的提升,TTS技術(shù)將更加成熟,生成的語音將更加自然、流暢。配合智能AI助理等功能來實(shí)現(xiàn)鋼鐵俠中“賈維斯”的科幻場(chǎng)景落實(shí)。

圖片源自于互聯(lián)網(wǎng)

同時(shí),移動(dòng)端側(cè)越來越強(qiáng)大的AI算力,還可以讓V2V(車車互聯(lián))慢慢實(shí)現(xiàn),通過AI和V2V技術(shù),車輛可以共享路況信息,如擁堵情況、事故、路面狀況等。這些信息可以幫助駕駛員或自動(dòng)駕駛系統(tǒng)做出更好的導(dǎo)航?jīng)Q策,提高道路使用效率。甚至,可以自動(dòng)與同目的地的車輛組成車隊(duì),AI可以控制一組車輛以固定的速度和距離行駛,從而提高燃油效率和道路容量。

圖片源自于互聯(lián)網(wǎng)

在對(duì)未來人工智能市場(chǎng)的展望中,可以明確地預(yù)見到,在日常民用領(lǐng)域,移動(dòng)端將無疑占據(jù)主導(dǎo)地位。目前,移動(dòng)設(shè)備在運(yùn)行大規(guī)模AI模型時(shí),的確面臨著內(nèi)存和計(jì)算資源的限制。然而,隨著科技的持續(xù)進(jìn)步,我們有理由相信這些挑戰(zhàn)將會(huì)被逐步克服。

作為消費(fèi)者,在面對(duì)如潮水般涌來的AI營(yíng)銷攻勢(shì)時(shí),我們需要保持清醒的判斷力,同時(shí)也應(yīng)對(duì)新興技術(shù)抱有好奇心和期待。畢竟,自信息技術(shù)革命以來,很少有哪一項(xiàng)技術(shù)能引發(fā)如此廣泛的關(guān)注,并激發(fā)全球科技巨頭展開如此激烈的競(jìng)爭(zhēng)。人類歷史已經(jīng)多次證明,只有競(jìng)爭(zhēng)的時(shí)代才是科技進(jìn)步最快的時(shí)代,才是人類文明的閃耀時(shí)刻。

圖片源自于互聯(lián)網(wǎng)

- 免責(zé)聲明

- 本文所包含的觀點(diǎn)僅代表作者個(gè)人看法,不代表新火種的觀點(diǎn)。在新火種上獲取的所有信息均不應(yīng)被視為投資建議。新火種對(duì)本文可能提及或鏈接的任何項(xiàng)目不表示認(rèn)可。 交易和投資涉及高風(fēng)險(xiǎn),讀者在采取與本文內(nèi)容相關(guān)的任何行動(dòng)之前,請(qǐng)務(wù)必進(jìn)行充分的盡職調(diào)查。最終的決策應(yīng)該基于您自己的獨(dú)立判斷。新火種不對(duì)因依賴本文觀點(diǎn)而產(chǎn)生的任何金錢損失負(fù)任何責(zé)任。

新火種

2023-11-15

新火種

2023-11-15