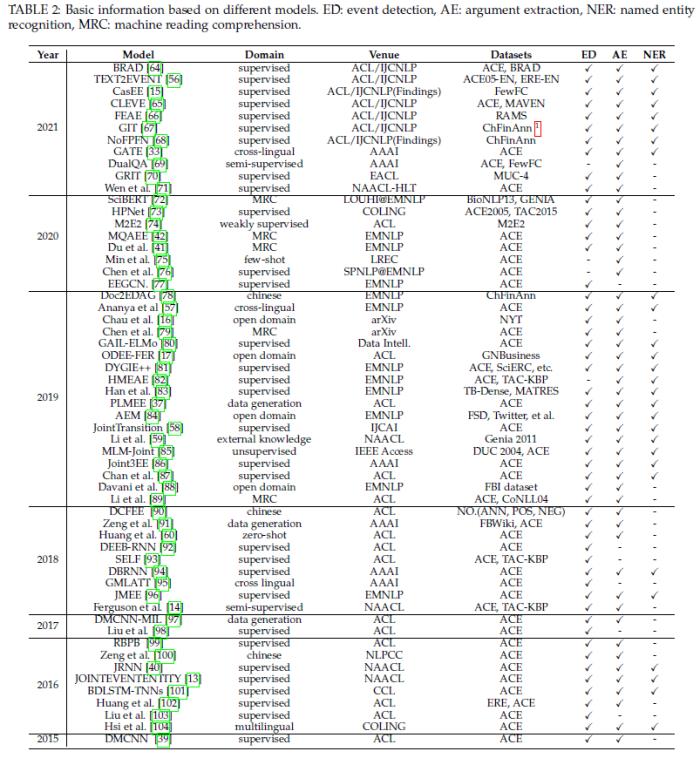

【技術白皮書】第三章:事件信息抽取的方法

3.3 事件信息抽取的方法

事件抽取(EE)是信息抽取研究中的一個重要而富有挑戰性的課題。事件作為一種特殊的信息形式,是指在特定時間、特定地點發生的涉及一個或多個參與者的特定事件,通常可以描述為狀態的變化。事件提取任務旨在將此類事件信息從非結構化的純文本中提取為結構化的形式,主要描述現實世界中事件發生的“誰、何時、何地、什么、為什么”和“如何”。在應用方面,該任務便于人們檢索事件信息,分析人們的行為,促進信息檢索、智能問答、知識圖譜構建等實際應用。

事件提取可分為兩個層次:基于模式的事件提取和基于開放域的事件提取。在基于模式的事件抽取任務中,事件被認為是特定的人和對象在特定的時間和地點進行交互的客觀事實。基于模式的事件提取是尋找屬于特定事件模式的單詞,即發生的動作或狀態變化,其提取目標包括時間、地點、人、動作等。在開放域事件提取任務中,事件被認為是一組主題的相關描述,可以通過分類或聚類形成。基于開放領域的事件提取是指獲取與特定主題相關的一系列事件,通常由多個事件組成。無論是基于模式還是開放域事件提取任務,事件提取的目的是從大量文本中捕獲我們感興趣的事件類型,并以結構化的形式顯示事件的基本元素。

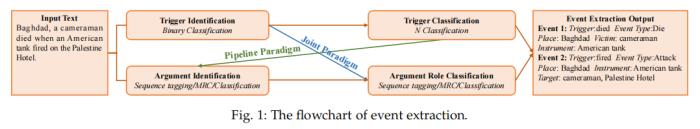

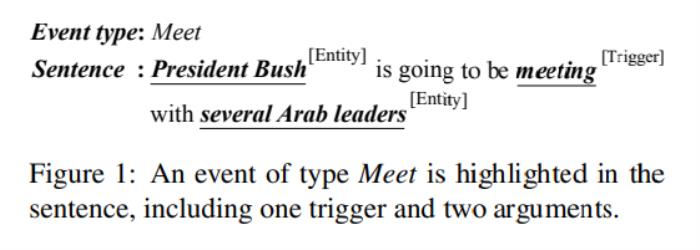

事件提取具有大量的工作價值,是一種相對成熟的研究分類法。它從文本中發現事件提及,并提取包含事件觸發器和事件參數的事件。事件提及是指包含一個或多個觸發器和參數的句子。事件提取需要識別事件、對事件類型進行分類、識別元素以及判斷元素角色。觸發器識別和觸發器分類可分為事件檢測任務。參數標識和參數角色分類可以定義為一個參數提取任務。觸發器分類是一個多標簽分類]任務,用來對每個事件的類型進行分類。角色分類任務是一種基于單詞對的多類分類任務,確定句子中任意一對觸發器和實體之間的角色關系。因此,事件提取可以依賴于一些NLP任務的結果,如命名實體識別(NER)、語義解析和關系提取。

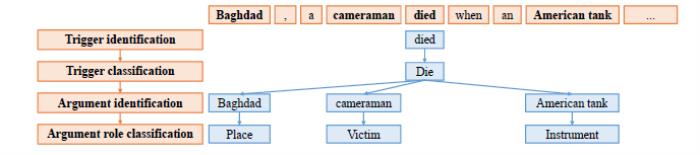

上圖是事件抽取的流程圖。事件提取是找到焦點事件類型,并用它的角色提取其元素。對于pipeline范例事件提取,有必要區分給定文本的文本中的事件類型,稱為觸發器分類。針對不同的事件類型,設計了不同的事件模式。然后,根據模式提取事件元素,包括元素識別和元素角色分類子任務。在早期階段,論點提取被視為一個詞分類任務,并對文本中的每個詞進行分類。此外,還有序列標記、機器閱讀理解(MRC)和序列到結構生成方法。對于聯合范例事件提取,該模型同時對事件類型和元素角色進行分類,以避免觸發分類子任務帶來的錯誤。

近年來,深度學習方法在很多領域得到了應用,深度學習模型能夠自動有效地提取句子中的重要特征。與傳統的特征提取方法相比,深度學習方法可以自動提取特征。它可以對語義信息進行建模,并在更高的層次上自動組合和匹配觸發特征。這些方法的有效性在自然語言處理中得到了驗證,并取得了許多突破。在事件提取任務中使用深度學習可以使許多研究人員消除特征提取工作。

大多數基于深度學習的事件提取方法通常采用監督學習,這意味著需要高質量的大數據集。依賴人工標注語料庫數據耗時耗力,導致現有事件語料庫數據規模小、類型少、分布不均勻。事件提取任務可能非常復雜。一個句子中可能有多個事件類型,不同的事件類型將共享一個事件元素。同樣的論點在不同事件中的作用也是不同的。根據抽取范式,基于模式的抽取方法可分為基于流水線(pipeline)的抽取方法和基于聯合的抽取方法。對基于流水線(pipeline)的模型學習事件檢測模型,然后學習元素抽取模型。聯合事件提取方法避免了觸發器識別錯誤對元素提取的影響,但不能充分利用事件觸發器的信息。到目前為止,最好的事件提取方法是基于聯合的事件提取范例。

3.3.1基于流水線(pipeline)的事件信息抽取方法

采用基于流水線(pipeline)的方法,它首先檢測觸發器,并根據觸發器判斷事件類型。元素提取模型根據事件類型和2觸發器的預測結果提取元素并對元素角色進行分類。

基于流水線(pipeline)的方法將所有子任務視為獨立的分類問題(《Zeroshot transfer learning for event extraction,》、《Pipelinedquery processing in coprocessor environments》、《R-node:New pipelined approach for an effective reconfifigurable wirelesssensor node》)。流水線(pipeline)方法被廣泛使用,因為它簡化了整個事件提取任務。如圖所示,基于流水線(pipeline)的事件提取方法將事件提取任務轉化為多階段分類問題。所需的分類器包括:

1) 觸發器分類器用于確定術語是否為事件觸發器和事件類型。

2)元素分類器用于確定單詞是否為事件的元素。

3)元素角色分類器用于確定元素的類別。

經典的基于深度學習的事件提取模型DMCNN(《Event extraction viadynamic multi-pooling convolutional neural networks》)使用兩個動態多池卷積神經網絡進行觸發分類和元素分類。觸發器分類模型識別觸發器。如果存在觸發器,元素分類模型將用于識別元素及其角色。PLMEE(《Exploring pretrained language models for event extraction and generation》)還使用了兩種模型,分別采用觸發器提取和元素提取。元素提取器使用觸發器提取的結果進行推理。通過引入BERT,它表現良好。

基于流水線(pipeline)的事件提取方法通過之前的子任務為后續子任務提供額外信息,并利用子任務之間的依賴關系。Du等人(《Event extraction by answering (almost)natural questions》)采用問答方法來實現事件提取。首先,該模型通過設計的觸發器問題模板識別輸入句子中的觸發器。模型的輸入包括輸入句子和問題。然后,它根據已識別的觸發器對事件類型進行分類。觸發器可以為觸發器分類提供額外信息,但錯誤的觸發器識別結果也會影響觸發器分類。最后,該模型識別事件元素,并根據事件類型對應的模式對元素角色進行分類。在論點提取中,該模型利用了上一輪歷史內容的答案。這種方法最顯著的缺陷是錯誤傳播。直觀地說,如果在第一步中觸發器識別出現錯誤,那么元素識別的準確性就會降低。因此,在使用流水線(pipeline)提取事件時,會出現錯誤級聯和任務拆分問題。流水線(pipeline)事件提取方法可以利用觸發器的信息提取事件元素。然而,這需要高精度的觸發器識別。錯誤的觸發器將嚴重影響元素提取的準確率。因此,流水線(pipeline)事件提取方法將觸發器視為事件的核心。

基于流水線(pipeline)的方法將將事件提取任務轉化為多階段分類問題。基于流水線(pipeline)的事件提取方法首先識別觸發器和元素標識基于觸發器識別的結果。它考慮了觸發因素作為事件的核心。然而,這一階段性戰略將導致錯誤傳播。觸發器的識別錯誤將被傳遞到元素分類階段將導致整體性能下降。此外,因為觸發檢測總是在前元素檢測,元素將不被考慮同時檢測觸發器。因此,每個環節都是獨立的缺乏互動,忽視了它們之間的影響。因此,整體依賴關系無法處理。典型的例子是DMCNN。

3.3.2 聯合學習的事件信息抽取方法

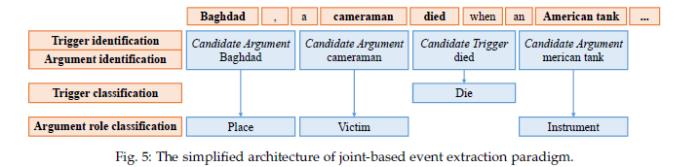

為了克服由事件檢測引起的錯誤信息傳播,研究人員提出了一種基于聯合的事件提取范式。它通過結合觸發器識別和元素提取任務來減少錯誤信息的傳播。

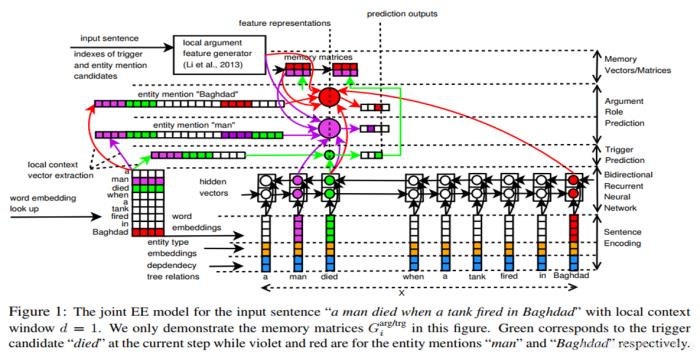

事件抽取在自然語言處理中具有重要的實用價值。在使用深度學習對事件提取任務建模之前,研究了事件提取中的聯合學習方法。如下圖所示,該方法在第一階段根據候選觸發器和實體識別觸發器和元素。在第二階段,為了避免事件類型錯誤信息的傳播,同時實現了觸發器分類和元素角色分類。將觸發器“died”分為Die事件類型,元素“Baghdad”分為Place元素角色等。

基于聯合模型的深度學習事件提取方法主要利用深度學習和聯合學習與特征學習進行交互,避免了學習時間過長和復雜的特征工程。Li等人(《Joint event extraction via structuredprediction with global features》)在傳統特征提取方法的基礎上,研究了觸發器提取和元素提取任務的聯合學習,并通過結構化感知器模型獲得最優結果。Zhu等人(《Bilingual event extraction: acase study on trigger type determination》)設計了高效的離散特征,包括特征詞中包含的所有信息的局部特征,以及可以連接觸發器和元素信息的全局特征。Nguyen等人(《Joint event extractionvia recurrent neural networks》)通過深度學習和聯合學習成功構建了本地特征和全球特征。它使用遞歸神經網絡將事件識別和論點角色分類結合起來。構建的局部特征包括文本序列特征和局部窗口特征。輸入文本由單詞向量、實體向量和事件元素組成。然后將文本轉換為遞歸神經網絡模型,以獲得深度學習的序列特征。本文還提出了一個帶記憶的深度學習模型對其進行建模。它主要針對事件觸發器之間、事件元素之間以及事件觸發器與事件元素之間的全局特性,以同時提高任務的性能。

事件提取涉及實體識別等相關任務,這有助于改進事件提取。Liu等人(《Leveraging framenetto improve automatic event detection》)利用論點的局部特征來輔助角色分類。他們首次采用了實體聯合學習任務,旨在降低任務的復雜性。前面的方法使用標記的特征輸入數據集,并輸出事件。Chen等人(《Automaticallylabeled data generation for large scale event extraction》)簡化了過程,即純文本輸入和輸出。在過程的中間,它是事件元素的聯合學習。這種聯合學習因素主要提供每個輸入事件中不同事件的關系和實體信息。

上述聯合學習方法可以實現觸發器和元素的聯合建模事件提取。然而,在實際工作過程中,觸發器和元素的提取是連續進行的,而不是同時進行的,這是一個亟待討論的問題。此外,如果在深度學習中加入端到端模式,特征選擇工作量將顯著減少,這也將在后面討論。聯合事件提取方法避免了觸發器識別錯誤對事件元素提取的影響,考慮到觸發器和元素同等重要,但不能利用觸發器的信息。

為了克服流水線(pipeline)的方法的缺點,研究人員提出了聯合方法。聯合方法構造了一個聯合學習模型來觸發識別和元素識別,其中觸發和元素可以相互促進提取效果。實驗證明,聯合學習方法的效果優于流水線(pipeline)學習方法。經典案例是JRNN(《Joint event extractionvia recurrent neural networks》)。聯合事件提取方法避免了事件元素提取中的觸發器識別,但不能利用觸發器信息。聯合事件提取方法認為事件中的觸發器和元素同等重要。然而,無論是基于流水線(pipeline)的事件提取還是基于聯合的事件提取都無法避免事件類型預測錯誤對元素提取性能的影響。此外,這些方法不能在不同的事件類型之間共享信息,不能獨立地學習每種類型,這不利于僅使用少量標記數據的事件提取。

3.3.3 基于深度學習的事件信息抽取模型

傳統的事件提取方法對深度特征的學習具有挑戰性,使得依賴于復雜語義關系的事件提取任務難以改進。最新的事件提取工作基于深度學習體系結構,如卷積神經網絡(CNN)、循環神經網絡(RNN)、圖形神經網絡(GNN)、Transformers或其他網絡。深度學習方法可以捕獲復雜的語義關系,顯著改善多事件提取數據集。下面會介紹了幾種典型的事件提取模型。

3.3.3.1基于CNN的模型

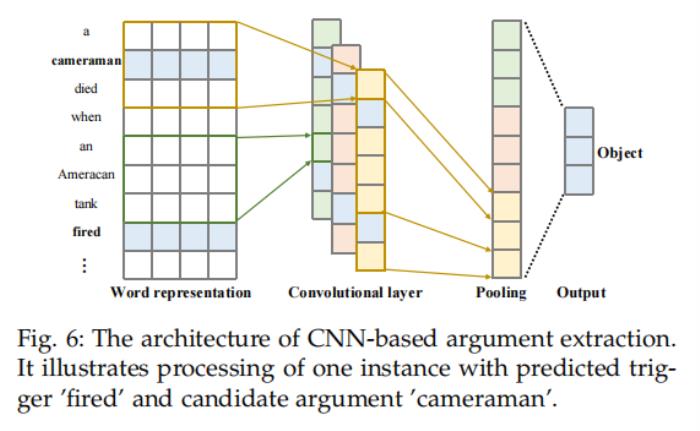

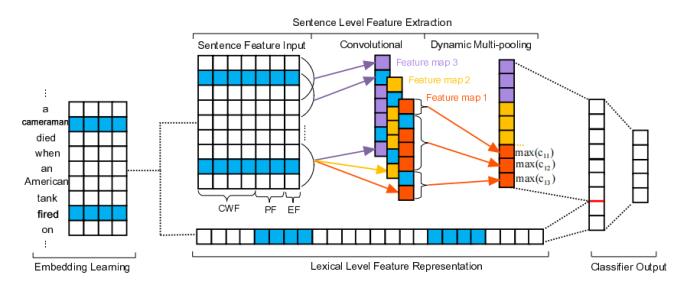

事件提取是信息提取中一個特別具有挑戰性的問題。傳統的事件提取方法主要依賴于設計良好的特征和復雜的NLP工具,這會消耗大量人力資源成本,并導致數據稀疏和錯誤傳播等問題。為了在不使用復雜的自然語言處理工具的情況下自動提取詞匯和句子級特征,Chen等人引入了一種稱為DMCNN的單詞表示模型。它捕捉單詞有意義的語義規則,并采用基于CNN的框架來捕捉句子層面的線索。然而,CNN只能捕獲句子中的基本信息,它使用動態多池層來存儲基于事件觸發器和元素的更關鍵的信息。事件提取是由具有自動學習特征的動態多池卷積神經網絡實現的兩階段多類分類。第一階段是觸發器分類。DMCNN對句子中的每個單詞進行分類,以確定觸發因素。對于具有觸發器的句子,此階段應用類似的DMCNN為觸發器分配元素,并對齊元素的角色。圖6描述了元素分類的體系結構。詞匯級特征表示和句子級特征提取用于捕捉詞匯線索和學習句子的組成語義特征。

CNN歸納出句子中k-gram的基本結構。因此,一些研究人員還研究了基于卷積神經網絡的事件提取技術。Nguyen等人[114]使用CNN來研究事件檢測任務,與傳統的基于特征的方法相比,它克服了復雜的特征工程和錯誤傳播限制。但它廣泛依賴其他受監督的模塊和手動資源來獲取特征。在跨域泛化性能方面,它明顯優于基于特征的方法。此外,為了考慮非連續的K-G,Nguyen等人(111)引入了不連續的CNN。CNN模型通過具有豐富局部和全局特征的結構化預測應用于基于流水線(pipeline)和基于聯合的范式,以自動學習隱藏的特征表示。與基于流水線(pipeline)的方法相比,基于聯合的范式可以緩解錯誤傳播問題,并利用事件觸發器和元素角色之間的相互依賴性。

3.3.3.2基于RNN的模型

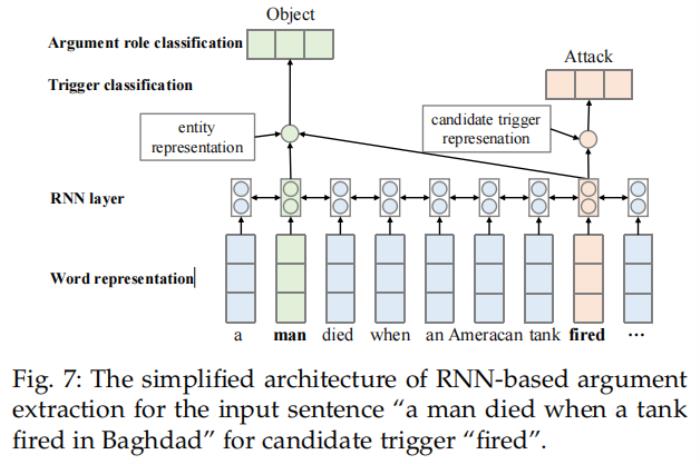

除了基于CNN的事件提取方法外,還對RNN進行了一些研究。RNN用于建模序列信息,以提取事件中的元素,如圖7所示。JRNN提出了一種雙向RNN,用于基于聯合的范例中的事件提取。它有一個編碼階段和預測階段。在編碼階段,它使用RNN來總結上下文信息。此外,它還預測了預測階段的觸發和論證。

以前的方法嚴重依賴于特定語言的知識和現有的NLP工具。一種更具前景的從數據中自動學習有用特征的方法。Feng等人(《A languageindependent neural network for event detection》)開發了一種混合神經網絡,用于捕捉特定序列和信息片段的上下文,并將其用于訓練多語言事件檢測器。該模型使用雙向LSTM獲取需要識別的文檔序列信息。然后利用卷積神經網絡獲取文檔中的短語塊信息,將這兩種信息結合起來,最終識別出觸發點。該方法可以使用多種語言(英語、漢語和西班牙語)進行穩健、高效和準確的檢測。在跨語言泛化性能方面,復合模型優于傳統的基于特征的方法。深度學習中的樹結構和序列結構比序列結構具有更好的性能。為了避免過度依賴詞匯和句法特征,依賴橋遞歸神經網絡(DBRNN)(《Jointly extracting eventtriggers and arguments by dependency-bridge RNN and tensorbased argument interaction》)基于雙向RNN進行事件提取。DBRNN依靠銜接語法相關單詞來增強。DBRNN是一個基于RNN的框架,它利用依賴關系圖信息提取事件觸發器和元素角色。

3.3.3.3基于注意力的模型

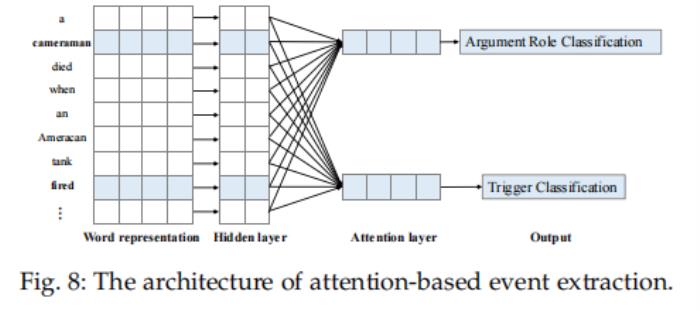

深度學習模型對事件特征的自動提取和外部資源對事件特征的增強主要集中在事件觸發器的信息上,而對事件元素和詞間相關性的信息關注較少。句子級順序建模在捕獲很長范圍的依賴關系時效率很低。此外,基于RNN和基于CNN的模型不能完全模擬事件之間的關聯。注意機制中結構信息的建模逐漸引起了研究者的關注。隨著研究方法的不斷提出,增加注意機制的模型逐漸出現,如圖所示。注意機制的特點決定了它可以在不考慮位置信息的情況下,利用全局信息對局部環境進行建模。在更新詞語的語義表示時有很好的應用效果。

注意機制通過控制句子各部分的不同權重信息,使模型在關注句子重要特征信息的同時忽略其他不重要的特征信息,并合理分配資源以提取更準確的結果。同時,注意機制本身可以作為一種對齊,解釋端到端模型中輸入和輸出之間的對齊,使模型更具解釋性。

一些研究人員還使用分層注意機制來進行信息的全局聚合。四個模塊:單詞表示、句法圖卷積網絡、自我注意觸發分類和論點分類模塊。通過引入語法快捷弧,信息流得到了增強。利用基于注意的圖卷積網絡對圖信息進行聯合建模,提取多個事件觸發器和元素。此外,當聯合提取事件觸發器和元素以解決數據集不平衡時,它優化了有偏損失函數。

3.3.3.4基于GCN的模型

句法表征為句子中的事件檢測提供了一種將單詞直接鏈接到其信息上下文的有效方法。Nguyen等人(《Graph convolutional networkswith argument-aware pooling for event detection》)研究了一種基于依賴樹的卷積神經網絡來執行事件檢測,他們是第一個將語法集成到神經事件檢測中的人。他們提出了一種新的池化方法,該方法依賴于實體提及來聚合卷積向量。該模型對當前單詞和句子中提到的實體的基于圖形的卷積向量進行合并。該模型聚合卷積向量以生成用于事件類型預測的單個向量表示。該模型將對實體提及的信息進行顯式建模,以提高事件檢測的性能。

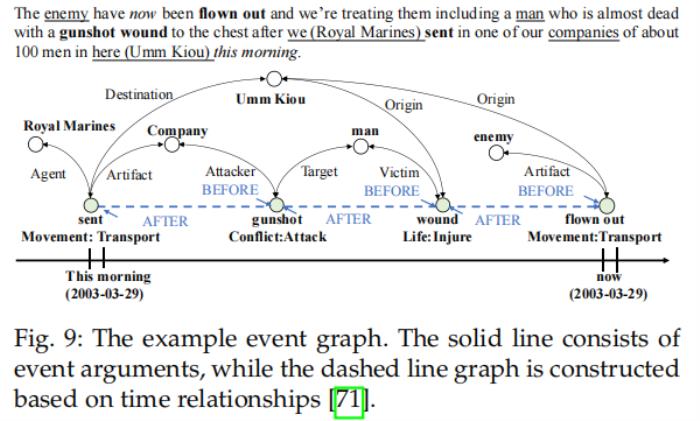

在(《Event time extraction and propagation via graph attention networks》)中,TAC-KBP時隙用于填充任務中提出的四元時間表示,該模型預測事件的最早和最晚開始和結束時間,從而表示事件的模糊時間跨度。該模型基于共享元素和時間關系為每個輸入文檔構建文檔級事件圖,并使用基于圖的注意網絡方法在圖上傳播時間信息,如圖所示,其中實體加下劃線,事件用粗體顯示。Wen等人基于輸入文檔的事件關系構建文檔級事件圖方法。將提取文檔中的事件元素。然后,根據關鍵字(如前后)和事件發生的時間邏輯,按時間順序排列事件。實體元素在不同事件之間共享。模型實現將事件合并到更準確的時間線中。

3.3.3.5基于transformer的模型

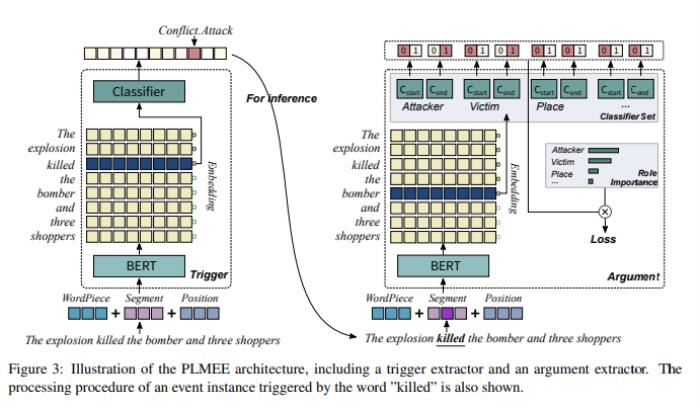

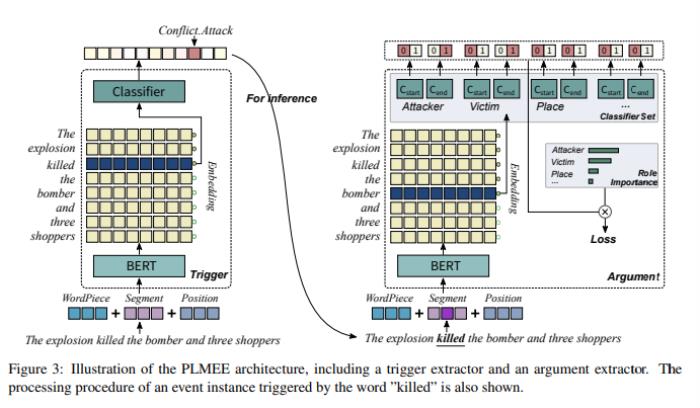

利用一個在不同事件中扮演不同角色的元素來改進事件提取是一個挑戰。楊在論證角色方面的預測有助于克服角色重疊問題。此外,由于訓練數據不足,該方法通過編輯原型并通過對質量進行排序來篩選開發的樣本,從而自動生成標記數據。他們提出了一個框架,即基于預訓練語言模型的事件提取器(PLMEE)[37],如圖10所示。PLMEE通過結合使用提取模型和基于預先訓練的語言模型的生成方法來促進事件提取。它是一個兩階段的任務,包括觸發器提取和元素提取,由觸發器提取程序和元素提取程序組成,這兩個程序都依賴于伯特的特征表示。然后,它利用角色的重要性來重新權衡損失函數。

GAIL(《Joint entity and event extractionwith generative adversarial imitation learning》)是一個基于ELMo的模型,利用生成性對抗網絡幫助模型關注更難檢測的事件。他們提出了一個基于生成對抗式模仿學習的實體和事件提取框架。這是一種采用生成對抗網絡(GAN)的反向強化學習(IRL)方法。該模型通過使用IRL的動態機制,直接評估實體和事件提取中實例的正確和錯誤標記。

DYGIE++(《Entity,relation, and event extraction with contextualized span representations》)是一個基于BERT的框架,它對句子和跨句子上下文中的文本跨度和捕獲進行建模。許多信息提取任務,如命名實體識別、關系提取、事件提取和共同引用解析,都可以受益于跨句子的全局上下文或不依賴于局部的短語。它們將事件提取作為附加任務,并在事件觸發器及其元素的關系圖中進行跨度更新。廣度表示是在多語句BERT編碼的基礎上構造的。

事件抽取是信息抽取的一個重要研究方向,在信息收集、信息檢索、輿論分析等方面發揮著重要作用,具有應用價值。傳統的事件提取方法大多采用人工構造的方法進行特征表示,并使用分類模型對觸發器進行分類,識別元素的作用。近年來,深度學習在圖像處理、語音識別、自然語言處理等方面取得了顯著的效果。為了解決傳統方法的不足,系統地討論了基于深度學習的事件提取。在伯特模型出現之前,主流的方法是從文本中找到觸發點,并根據觸發點判斷文本的事件類型。近年來,隨著BERT事件提取模型的引入,基于全文的事件類型識別方法已成為主流。這是因為BERT具有出色的上下文表示能力,在文本分類任務中表現良好,尤其是在數據量較小的情況下。

3.3.4常用的事件抽取模型

DMCNN

DMCNN是一種基于動態池化(dynamic pooling)的卷積神經網絡模型的事件抽取方法,來自中國科學院自動化研究所的論文《Event Extraction via Dynamic Multi-Pooling Convolutional Neural Networks》。這是一種pipeline方式的事件抽取方案,即對觸發詞的檢測和識別、對元素的檢測和識別兩個任務是分開進行的,后者依賴于前者的預測結果。兩個子任務都被轉換成了多分類問題,模型都采用DMCNN,只是稍有不同。

DMCNN算法原理:

本方法中,通過具有自動學習特征的DMCNN,將事件提取表述為兩階段、多類分類的任務。第一個階段稱為觸發分類,在該階段中,使用DMCNN對句子中的每個單詞進行分類,以識別觸發詞。如果一個句子有觸發器,則進行第二階段,該階段應用類似的DMCNN將元素分配給觸發器,并對齊元素的角色。本方法稱之為元素分類。

上圖元素分類的結構,基本上涉及以下部分:(1)詞嵌入學習,無監督方式;(2)詞典級別特征表示,直接用詞向量來發現詞匯線索;(3)句子級特征抽取,提出DMCNN來學習句子中組成語義特征;(4)元素分類輸出,為每一個元素候選角色計算置信度值。

詞嵌入學習和詞匯級特征表示

詞匯級別特征是事件抽取中的重要線索。傳統的詞典級別特征基本上包括候選詞的lemma,同義和詞性標簽。這種特征的質量依賴于現有的NLP工具和人工精巧。這篇論文選擇無監督預訓練詞向量作為基本數據源特征,我們選擇候選詞的詞向量(候選觸發詞,候選元素)和上下文token(候選詞左右token)。然后,所有詞向量串起來詞匯級別特征向量L來表示元素分類里的詞匯級別特征。

在這項工作中,使用skip-gram模型來預訓練詞向量。skip-gram使用擴大平均值log可能性來訓練詞語w1,w2……wm。

使用DMCNN進行句子級別特征學習

CNN使用最大池是一個很好的選擇來獲得句子中長距離詞之間的語義關系。但是, 傳統的CNN不能解決事件抽取的問題。因為一個句子中可能包含不僅僅一個事件,僅僅使用最重要的信息來表示這個句子,因為在傳統的CNN中,會失去很多有價值的線索。為了解決這個問題,論文提出了DMCNN的方法來抽取句子級別的特征。DMCNN使用動態多池卷積神經網絡來實現一個句子中每個部分的最大值獲取,這個句子被事件觸發詞和事件元素分割。

輸入

預測的觸發詞與候選元素之間的語義關系對于元素分類是至關重要的。因此,論文提出了三種類型輸入來使DMCNN可以獲得重要的線索:

詞匯上下文特征(CWF):CWF是通過查找單詞嵌入轉換的每個單詞標記的向量。

位置特征(PF):很有必要指定哪些詞是元素分類中的預測觸發器或候選元素。因此,論文提出PF定義為當前詞語和候選元素或者觸發詞之間的距離,。為了編碼位置特征,每一個距離值用向量表示。類似于詞嵌入,距離值隨機初始化和最優化使用后項傳播方法。

事件類型特征(EF):當前觸發詞的事件類型對于元素分類是有價值的,所以論文在觸發詞分類階段就對事件類型預測進行編碼,然后作為DMCNN的重要線索。假定詞向量大小為dw=4,位置嵌入大小為dp=1,事件類型嵌入為de=1,xi屬于Rd,其中i表示第d維度在句子中第i個詞匯,其中d=dw+dp*2+de。一個長度為n的句子如下:

x1:n= x1⊕x2⊕…⊕xn

⊕為串聯操作符號。因此,結合詞嵌入、位置嵌入和事件類型嵌入把一個實例轉換成一個矩陣X∈Rn×d,然后X將輸入卷積網絡中。

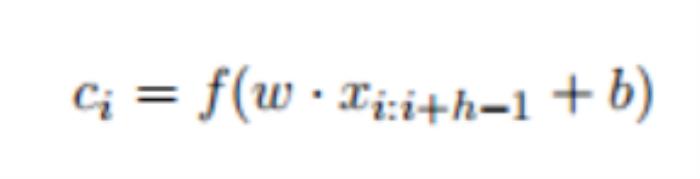

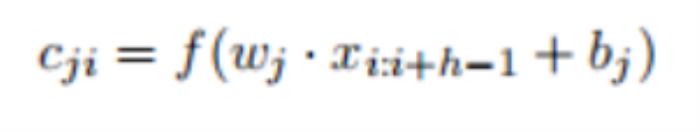

卷積

卷積層目的在于抓取整個句子的組成語義,然后壓縮那些有價值的語義到特征映射中。xi:i+j表示詞向量從i到i+j的串聯,卷積操作升級一個w∈Rh×d,應用h個單詞為窗口來生成新的特征。比如說,特征Ci由xi:i+h-1的窗口單詞生成。

其中b∈ R是一個偏置項,f是一個非線性函數,如雙曲正切。該濾波器應用于句子x1:h,x2:h+1,... ,xn?h+1:n生成特征映射ci,其中索引i的范圍為1到n? h+1。

我們把這一過程描述為從以過濾抽取為特征映射。為了抓取不同的特征,通常在卷積中使用多個濾波器。假定使用濾波器W=w1,w2……wm,卷積操作表達如下:

其中j范圍為1到m。卷積結果為矩陣C∈Rm×(n-h+1).

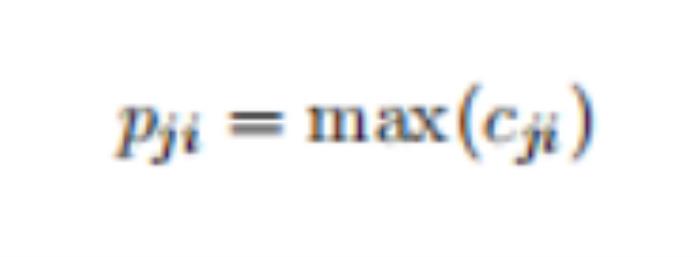

動態多池

為了提取每個特征圖中最重要的特征(最大值),傳統的cnn將一個特征圖作為池,每個特征圖只得到一個最大值。然而,單個最大池化對于事件提取是不夠的。因為在論文的任務中,一個句子可能包含兩個或更多的事件,而一個候選元素可能用不同的觸發器發揮不同的作用。為了做出準確的預測,需要獲取關于候選詞變化的最有價值的信息。因此,根據元素分類階段根據候選元素和預測觸發器將每個特征映射分為三個部分。DMCNN不是使用整個特征映射的一個最大值來表示句子,而是保留每個分割部分的最大值,并稱之為動態多池。與傳統的最大池化相比,動態多池化可以在不遺漏最大池化值的情況下保留更多有價值的信息。

特征映射輸出Cj被切分為三部分Cj1,Cj2,Cj3,動態多池可以表示如形式下,其中1<=j<=m,1<=i<=3 .pji = max(cji)、

經過動態多卷積層,獲得每個特征映射pij。串聯所有pij成為向量P∈R3m

輸出

自動學習詞匯和句子級特征全部串聯成一個向量F=[L,P].為了計算每一個元素角色的置信度,特征向量F∈R3m+dl,其中m是特征映射的個數,dl是詞匯級別特征的維數。

觸發分類任務

上述方法也適用于觸發分類,但該任務只需要在句子中找到觸發器,這比元素分類簡單。因此,可以使用DMCNN的簡化版本。在觸發器分類中,DMCNN只在詞匯級特征表示中使用候選觸發器及其左右標記。在句子級別的特征表示中,使用與元素分類中相同的CWF,但只使用候選觸發器的位置來嵌入位置特征。此外,句子不是把句子分成三個部分,而是被一個候選觸發器分成兩部分。除了上述特征和模型的變化外,將觸發器分類為元素的分類。這兩個階段共同構成了事件提取的框架。

實驗結果:

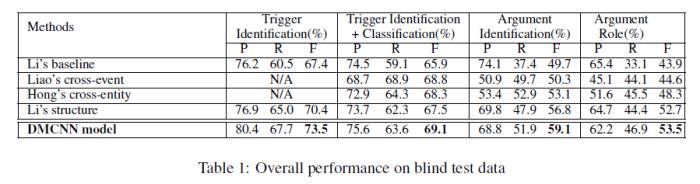

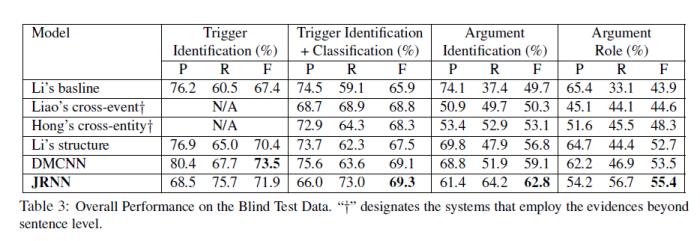

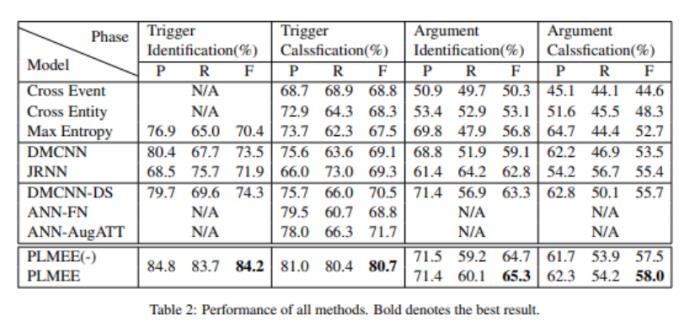

DMCNN的研究者選用ACE 2005 corpus作為實驗的數據集,得到了如下表所示的實驗結果。表1顯示了盲測試數據集的總體性能。從結果可以看出,具有自動學習特征的DMCNN模型在所有比較方法中取得了最好的性能。DMCNN可以將最先進的F1觸發器分類提高1.6%,元素角色分類提高0.8%。這證明了該方法的有效性。此外,將Liao’s cross-event(《Using document level cross-event inference to improve event extraction》)與Li’s baseline(《Joint eventextraction via structured prediction with global features》)進行比較,說明Liao’s cross-event取得了更好的成績。我們也可以在比較Hong‘s cross-entity和Liao’s cross-event以及比較Li’s structure(《Joint eventextraction via structured prediction with global features》)和Hong‘s cross-entity(《Usingcross-entity inference to improve event extraction》)時進行同樣的觀察。事實證明,當使用傳統的人工設計的特征時,更豐富的特征集可以帶來更好的性能。然而,DMCNN的方法在只使用從原始單詞中自動學習的特征的情況下,可以獲得更好的結果。具體而言,與Hong‘scross entity相比,它在觸發器分類F1上提高了0.8%,在元素分類F1上提高了5.2%。研究員認為,原因是DMCNN自動學習的特征可以捕捉到單詞更有意義的語義規律。值得注意的是,與Li’s structure相比,盡管沒有使用復雜的NLP工具,但DMCNN的句子和詞匯特征方法取得了相當的性能。

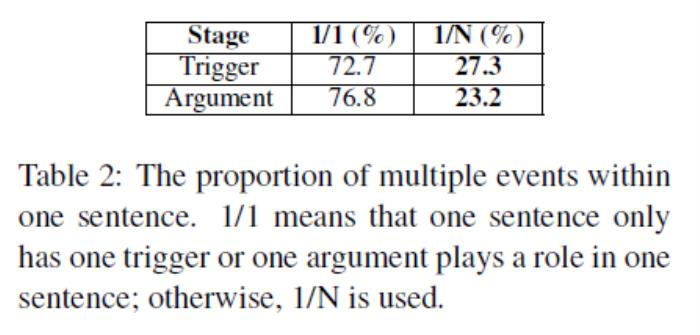

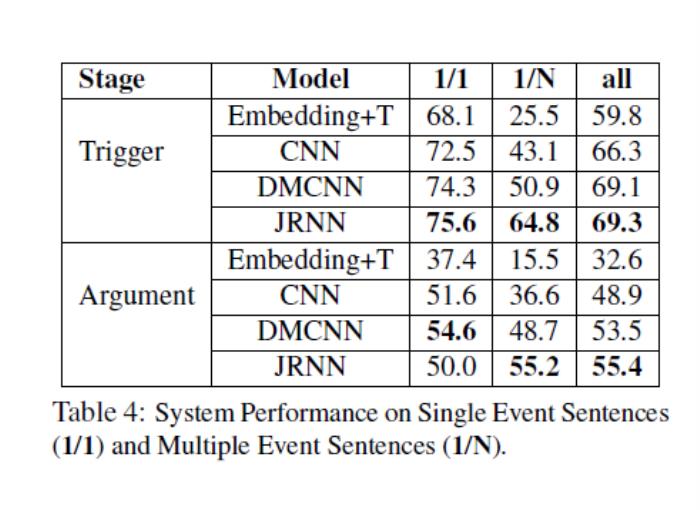

在一個句子中含有多個事件的抽取實驗中得到了如下表所示的實驗結果。表2顯示了數據集中包含多個事件或單個事件的句子的比例,以及在一個句子中包含一個事件或多個事件的元素的比例。

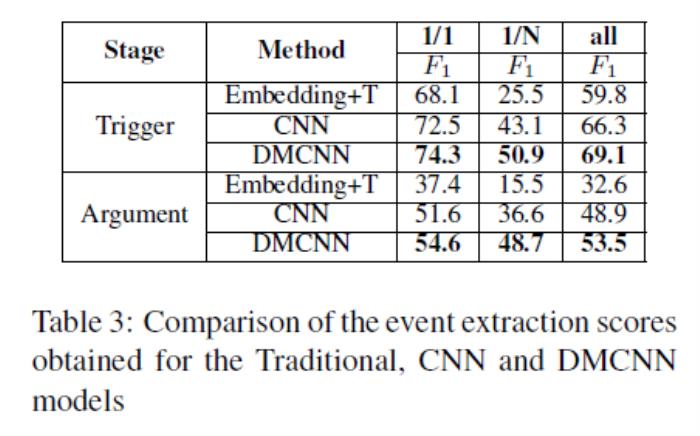

下表是DMCNN和CNN還有embedding+T的對比。表3說明了基于卷積神經網絡(CNN和DMCNN)的方法優于embedding+T。這證明了卷積神經網絡在句子級特征提取方面可能比傳統的人類設計策略更有效。在表3中,對于所有句子,DMCNN的方法比CNN分別提高了約2.8%和4.6%。結果證明了動態多池層的有效性。有趣的是,DMCNN對有多個事件的句子的觸發分類提高了7.8%。這種改進比有單一事件的句子要大。可以對元素分類結果進行類似的觀察。這表明,擬議的DMCNN可以有效捕獲比最大池CNN更多的有價值線索,尤其是當一句話包含多個事件時。

下表是DMCNN和CNN還有embedding+T的對比。表3說明了基于卷積神經網絡(CNN和DMCNN)的方法優于embedding+T。這證明了卷積神經網絡在句子級特征提取方面可能比傳統的人類設計策略更有效。在表3中,對于所有句子,DMCNN的方法比CNN分別提高了約2.8%和4.6%。結果證明了動態多池層的有效性。有趣的是,DMCNN對有多個事件的句子的觸發分類提高了7.8%。這種改進比有單一事件的句子要大。可以對元素分類結果進行類似的觀察。這表明,擬議的DMCNN可以有效捕獲比最大池CNN更多的有價值線索,尤其是當一句話包含多個事件時。

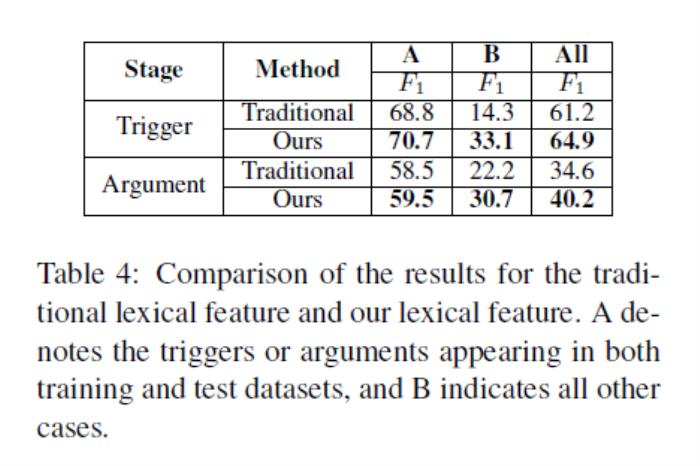

表四是DMCNN通過詞匯特征進行事件抽取和傳統方法通過詞匯特征進行事件抽取的實驗結果對比。表4表明,對于所有情況,與傳統的詞匯特征相比,DMCNN的方法在觸發器和元素的分類方面都有顯著的改進。對于情況B,從單詞嵌入中提取的詞匯級特征對觸發器分類和元素分類分別提高了18.8%和8.5%。這是因為基線僅使用離散特征,因此它們存在數據稀疏性,無法充分處理觸發器或元素未出現在訓練數據中的情況。

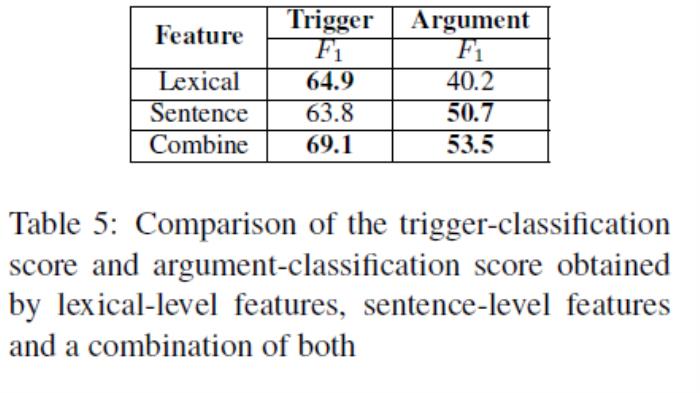

表五是不同層次特征進行抽取的有效性的實驗對比。使用DMCNN獲得的結果如表5所示。有趣的是,在觸發分類階段,詞匯特征起著有效的作用,而句子特征在論點分類階段起著更重要的作用。當實驗將詞匯級和句子級特征結合起來時,效果最好。這一觀察結果表明,這兩個級別的特征對于事件提取都很重要。

結論:

DMCNN提出了一種新的事件提取方法,可以自動從純文本中提取詞匯級和句子級特征無需復雜的NLP預處理。引入詞表示模型來捕捉詞匯語義線索,設計了動態多池卷積神經網絡(DMCNN)對句子語義線索進行編碼。實驗結果證明了該方法的有效性。

JRNN

JRNN來自紐約大學2016年的論文《Joint Event Extraction via Recurrent Neural Networks》,提出了一個基于循環神經網絡的事件抽取聯合模型,既避免了管道模型中的誤差傳播問題,同時也考慮到了事件觸發詞和事件元素之間的關系。

事件抽取的方法主要有兩種:

(1)管道模型:首先識別事件觸發器,之后再進行事件元素的識別。

(2)聯合模型:同時預測句子的事件觸發器和事件元素。

聯合模型緩解了管道模型存在的誤差傳播問題,并考慮了事件觸發器和事件元素之間的依賴關系。

JRNN的算法原理:

JRNN將事件抽取任務形式化如下。W=w1,w2,…,wn是一個句子,其中n是句子長度,wi是第i個標記。另外,讓E=e1,e2,…,ek是這句句子中提到的實體(k是實體提到的數量,可以為零)。每個提到的實體都帶有頭部的偏移量和實體類型。進一步假設i1,i2,……,ik分別是e1,e2,……,ek的最后一個詞的索引。在EE中,對于句子中的每個標記wi,需要預測它的事件子類型(如果有的話)。如果wi是某些感興趣的事件的觸發詞,那么需要預測每個實體提到的ej在該事件中扮演的角色(如果有的話)

整個模型分為兩個階段:編碼階段和預測階段

(1)編碼階段應用循環神經網絡誘導句子更抽象的向量

(2)預測階段使用新的向量執行事件觸發和元素角色識別

編碼階段:

在編碼階段,首先使用以下三個向量的連接,將每個標記wi轉換為一個實值向量xi:

1.wi的單詞嵌入向量:通過查找一個預先訓練好的單詞嵌入表得到的

2.wi的實體類型的實值嵌入向量:該向量基于之前的工作(Nguyen和Grishman,《Eventdetection and domain adaptation with convolutional neural networks.》),通過查找wi的實體類型的實體類型嵌入表(隨機初始化)生成。請注意,還使用BIO注釋模式來為句子中的每個標記分配實體類型標簽。

3.二元向量,其維數對應于依存樹中詞之間的可能關系。僅當W的依存樹中存在與wi相連的對應關系的一條邊時,該向量的每個維度的值才設置為1。該向量表示在先前的研究中(《Joint event extraction via structured prediction with global features.》)顯示有幫助的依存特征

請注意,JRNN沒有使用相對位置特征,原因是JRNN共同預測了整個句子的觸發器和元素角色,因此在句子中沒有固定的錨定位置。從標記wi到向量xi的轉換本質上是將輸入句子W轉換為實值向量X=(x1,x2,……,xn),供循環神經網絡用來學習更有效的表示。

預測階段:

為了共同預測W的觸發器和元素角色,JRNN為觸發器創建一個二進制內存向量,為元素維護一個二進制內存矩陣和(每次i)。這些向量/矩陣最初被設置為零(i=0),并在W的預測過程中進行更新。

給定雙向表示h1,h2,……,在編碼階段的hn和初始化的內存向量/矩陣,聯合預測過程循環到句子中的n個令牌(從1到n)。在每個時間步i中,我們按照順序執行以下三個階段:

(1)對wi的觸發器進行預測。

(2)所有實體提到的e1、e2的元素角色預測…,ek關于當前的令牌wi。

(3)使用之前的記憶向量/矩陣、和,以及早期階段的預測輸出,計算當前步驟的、和。

這個過程的輸出將是wi的預測觸發子類型ti,預測的元素角色ai1,ai2,…,aik和內存向量/矩陣、和。請注意,如果wi是某些感興趣的事件的觸發詞,或者在其他情況下是“Other”,則ti應該是事件子類型。相比之下,如果wi是一個觸發詞,而ej是對應事件的元素,則aij應該是關于wi的實體的元素角色,否則aij被設置為“Other”(j=1到k)。

觸發器預測:

在當前標記wi的觸發預測階段,我們首先使用以下三個向量的連接來計算wi的特征表示向量:

hi: 封裝輸入句子的全局上下文的隱藏向量。

:wi的局部上下文向量。是通過將單詞的上下文窗口中的向量連接起來生成的:=[D[wi?d],…,D[wi],…,D[wi+d]]。

:前一步中的記憶向量。

然后將表示向量=[hi,,]輸入前饋神經網絡和softmax層,最終計算可能觸發子類型的概率分布。最后計算wi的預測類型ti。

元素預測階段:

在元素角色預測階段,我們首先檢查前一階段預測的觸發子型ti是否為“Other”。如果是,可以簡單地將aij設置為所有j=1到k的“Other”,然后立即進入下一個階段。否則,循環實體e1,e2,…,ek。

實驗結果:

JRNN采用ACE 2005 corpus作為實驗的數據集,得到了如下表所示的實驗結果:

從表中,我們可以看到,在所有比較模型中,JRNN獲得了最好的F1分數(對于觸發器和元素標記)。這對于元素角色標記性能來說是非常重要的(比Chen等人(2015年)報道的最佳模型DMCNN提高了1.9%),并證明了在這項工作中,具有RNN和記憶特征的聯合模型的好處。此外,由于JRNN顯著優于Li等人(2013)提出的具有離散特征的聯合模型(觸發器和元素角色標記分別提高了1.8%和2.7%),我們可以確認JRNN在學習EE有效特征表示方面的有效性。

在一個句子中含有多個事件的抽取實驗中得到了如下表所示的實驗結果。表中最重要的觀察結果是,當輸入句子包含多個事件(即表中標記為1/N的行)時,JRNN顯著優于所有其他具有較大裕度的方法。特別是,JRNN在觸發器標記方面比DMCNN好13.9%,而元素角色標記方面的相應改進為6.5%,從而進一步表明了JRNN與內存特性的優勢。就單事件句子的性能而言,JRNN在觸發器標記上仍然是最好的系統,盡管在元素角色標記上不如DMCNN。這可以部分解釋為,DMCNN包含元素的位置嵌入特性,而JRNN中的內存矩陣Garg/trg在這種單事件情況下不起作用

在一個句子中含有多個事件的抽取實驗中得到了如下表所示的實驗結果。表中最重要的觀察結果是,當輸入句子包含多個事件(即表中標記為1/N的行)時,JRNN顯著優于所有其他具有較大裕度的方法。特別是,JRNN在觸發器標記方面比DMCNN好13.9%,而元素角色標記方面的相應改進為6.5%,從而進一步表明了JRNN與內存特性的優勢。就單事件句子的性能而言,JRNN在觸發器標記上仍然是最好的系統,盡管在元素角色標記上不如DMCNN。這可以部分解釋為,DMCNN包含元素的位置嵌入特性,而JRNN中的內存矩陣Garg/trg在這種單事件情況下不起作用

結論:

JRNN提出了一種基于雙向RNN的執行事件抽取的聯合模型,以克服以往模型的局限性。引入了記憶矩陣,可以有效地捕捉元素角色和觸發器子類型之間的依賴關系。我們證明了CBOW單詞嵌入對關節模型非常有用。在ACE 2005數據集上,所提出的聯合模型在具有多個事件的句子上是有效的,并且產生了最先進的性能。

PLMEE

傳統的事件抽取(EE)方法通常依賴于人為標注的數據,耗時耗力,而且標注的數據量不會很大。不充足的數據阻礙了模型的學習。

本文首先提出了一個EE模型——PLMEE,通過將元素(argument)預測按照角色進行分離來克服角色重疊問題。

為了解決訓練數據不足的問題,提出了一種通過edit prototypes的方法來自動生成標注數據,并按照數據的質量進行排序,對生成的樣本進行篩選。

PLMEE的算法原理:

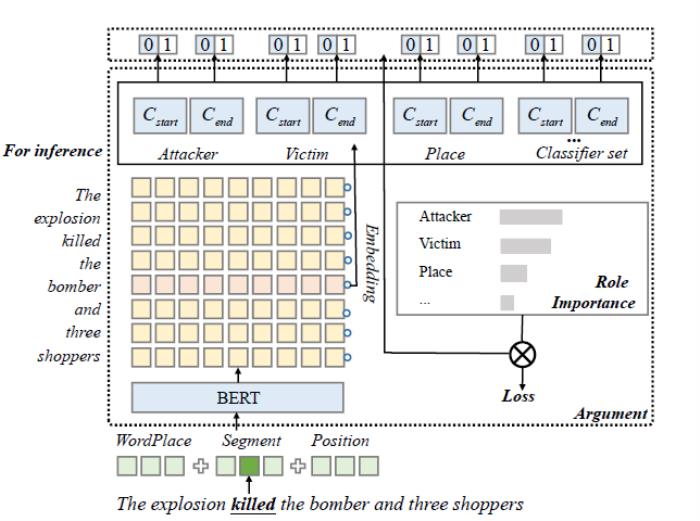

EE任務的目的是識別出事件觸發器和元素。如圖所示。

提出的基于預訓練語言模型的方法包括2個模塊:(1)事件抽取模型;(2)有標簽的事件生成方法。

(1)事件抽取模型

將事件提取作為一個兩階段的任務,包括觸發器提取和元素提取,并提出了一個基于預訓練語言模型的事件提取器(PLMEE)。圖3說明了PLMEE的體系結構。它由一個觸發器提取器和一個元素提取器組成,這兩者都依賴于BERT的特征表示。

(2)預訓練語言模型

預訓練語言模型(PLM)用于生成標注數據,有兩個關鍵步驟:1)argument replacement ;2)adjunct token rewriting。

并對生成的樣本進行評分,選擇出高質量的數據。將這些數據和現有的數據合并,可以增強事件抽取器的性能。

事件抽取模型

將EE看成兩個子任務:1)觸發器抽取;2)元素抽取,并提出PLMEE模型,模型架構如圖3所示。模型由觸發器抽取器和元素抽取器兩部分組成,兩者均依賴于BERT學習到的特征表示。

觸發器的抽取

觸發器抽取器的目的是預測出觸發了事件的token,形式化為token級別的多類別分類任務,分類標簽是事件類型。在BERT上添加一個多類分類器就構成了觸發器抽取器。

觸發器提取器的輸入遵循BERT,即三種嵌入類型的總和,包括WordPiece嵌入、位置嵌入和片段嵌入。由于輸入只包含一個句子,所以它的所有段id都被設置為零。此外,token[CLS]和[SEP]被放置在句子的開頭和結尾。在許多情況下,觸發器是一個短語。因此,將共享相同預測標簽的連續令牌作為一個整體觸發器。一般情況下,采用交叉熵作為損失函數進行微調。

元素的抽取

給定觸發器,元素提取器旨在提取相關的元素和它們所扮演的所有角色。與觸發器提取相比,元素提取更為復雜,因為有三個問題:元素對觸發器的依賴性,大多數元素是長名詞短語,以及角色重疊的問題。我們正好采取了一系列的行動來應對這些障礙。與觸發器提取器一樣,元素提取器也需要三種嵌入。然而,它需要知道哪些令牌構成了觸發器。因此,將觸發標記的段ids設為1來輸入元素提取器。

為了克服元素提取中的后兩個問題,論文在BERT上添加了多組二進制分類符。每一組分類器都分離了一個角色,以確定所有播放它的元素的跨度(每個跨度包括一個開始和一個結束)。這種方法類似于SQuAD上的問題回答任務,其中只有一個答案,而扮演相同角色的多個元素可以在一個事件中同時出現。由于預測是用角色分開的,因此一個元素可以扮演多個角色,而一個標記可以屬于不同的元素。因此,也可以解決角色重疊問題。

訓練數據的生成

除了PLMEE之外,論文還提出了一種基于預訓練的語言模型的事件生成方法,如圖4所示。通過編輯原型,該方法可以生成可控數量的標記樣本作為額外的訓練語料庫。它包括三個階段:預處理、事件生成和評分。為了便于生成方法,論文將輔助標記定義為句子中除觸發器和元素外的標記,不僅包括單詞和數字,還包括標點符號。以圖1中的句子為例,“is”和“going”是附加令牌。很明顯,輔助標記可以調節表達的平滑性和多樣性。因此,我們試圖重寫它們,以擴展生成結果的多樣性,同時保持觸發器和元素不變。

預處理

首先在ACE2005數據集中收集元素以及它們所扮演的角色。然而,這些與其他論點重疊的論點被排除在外。因為這樣的元素通常是長的復合短語,包含太多意想不到的信息,將它們合并在元素替換中可能會帶來更多不必要的錯誤。

在接下來的階段,論文還采用BERT作為目標模型來重寫輔助標記,并使用掩碼語言模型任務對ACE2005數據集進行微調,以使其預測偏向于數據集分布。與BERT的預訓練程序一樣,每次抽取一批句子,并掩蓋15%的令牌。它的目標仍然是在沒有監督的情況下預測正確的標記

事件生成

為了生成事件,論文在一個原型上執行了兩個步驟。首先將原型中的參元素替換為那些發揮了相同作用的類似元素。接下來,用精細的BERT重寫附加令牌。通過這兩個步驟,就可以獲得一個帶有注釋的新句子

(1)元素替換

第一步是在事件中替換元素。要被替換的元素和新的元素都應該發揮同樣的作用。雖然角色是在替換后繼承的,所以仍然可以為生成的樣本使用原點標簽。為了不徹底改變意義,使用相似性作為選擇新元素的標準。它基于以下兩個考慮:一個是發揮相同作用的兩個元素在語義上可能存在顯著差異;另一個原因是,一個元素所扮演的角色在很大程度上取決于它的上下文。因此,應該選擇在語義上相似且與上下文一致的元素

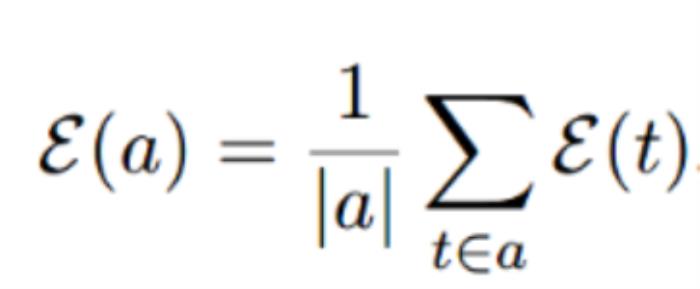

使用嵌入之間的余弦相似度來衡量兩個元素的相似性。由于ELMO具有處理OOV問題的能力,論文使用它來嵌入元素:

其中a是元素,E是ELMO嵌入。我們選擇最相似的top 10元素作為候選,并對它們的相似性使用softmax操作來分配概率。一個元素被替換為概率80%,同時保持概率20%的概率不變,以使事件表示偏向于實際事件。需要注意的是,觸發器保持不變,以避免依賴關系的不良偏差

(2)重寫adjunct tokens

元素替換的結果已經可以看作是生成的數據,但固定的上下文可能會增加過擬合的風險。因此,為了平滑數據并擴展其多樣性,論文使用微調后的BERT進行adjunct tokens的重寫。

重寫是為了將原型中的一些輔助標記替換為與當前上下文更匹配的新標記。論文將它作為一個完形填空,其中一些adjunct tokens被隨機屏蔽,第一階段的BERT微調用于基于上下文預測合適令牌的詞匯id。論文使用一個元素m來表示需要重寫的adjunct tokens的比例。

附加令牌重寫是一個一步一步的過程。每次屏蔽15%的adjunct tokens(使用令牌[MASK])。然后將句子輸入BERT,產生新的adjunct tokens。尚未被重寫的adjunct tokens將暫時保留在句子中。

對事件打分

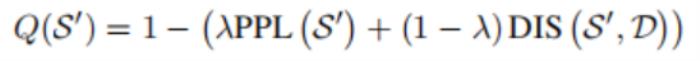

理論上,用論文的生成方法可以產生無限數量的事件。然而,并不是所有的方法對提取器都有價值,有些甚至可能降低其性能。因此,論文增加了一個額外的階段來量化每個生成的樣本的質量,以挑選出那些有價值的樣本。評估質量的關鍵在于,它與兩個元素緊密相關,即困惑度和到原始數據集的距離。前者反映了生成的合理性,后者反映了數據之間的差異。

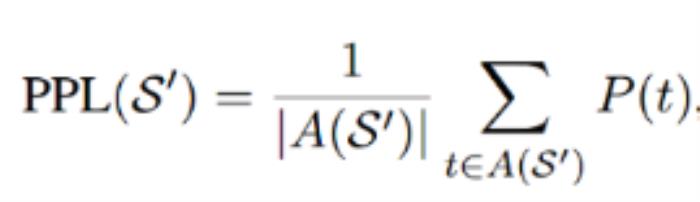

困惑度(Perplexity, PPL)

A表示在句子S ′中已被重寫的adjunct tokens

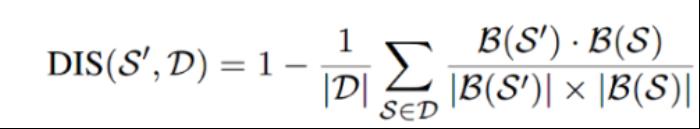

距離(Distance, DIS)

使用余弦相似性:

與ELMO的嵌入參數不同,論文利用BERT來嵌入句子,并將嵌入的第一個標記[CLS]作為句子的嵌入。PPL和DIS在[0,1]中都是有限的。論文認為生成的高質量樣品應該同時具有低PPL和DIS。因此,將質量函數定義為:

其中λ∈[0,1]為平衡參數。該函數用于選擇實驗中生成的高質量樣本。

實驗結果:

PLMEE實驗選用的數據集為ACE2005,

實驗結果的評估標準:觸發器預測正確:span和type和真實值一致;元素預測正確:span和所有角色標簽都預測正確。采用精度(P)、召回率(R)和F度量(F1)作為評估指標。得到了如下圖所示的實驗結果:

表2在測試集上將上述模型的結果與PLMEE進行了比較。如圖所示,在觸發器提取任務和元素提取任務中,PLMEE(-)在所有比較的方法中都取得了最好的結果。觸發器提取的改進非常顯著,F1分數大幅增加近10%。雖然元素提取方面的改進不太明顯,達到了2%左右。這可能是由于我們采用了更嚴格的評估標準,以及元素提取任務的難度。此外,與基于特征的方法相比,基于神經網絡的方法可以獲得更好的性能。在比較基于外部資源的方法和基于神經的方法時,也出現了同樣的觀察結果。它表明,外部資源對于改進事件提取非常有用。此外,與PLMEE(-)模型相比,PLMEE模型在元素提取任務上可以取得更好的結果,識別F1得分提高0.6%,分類得分提高0.5%,這意味著重新加權損失可以有效提高性能

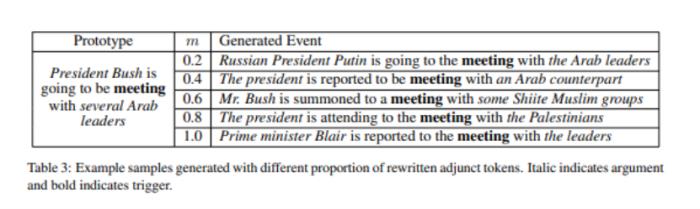

表3顯示了一個原型及其生成事件,元素m范圍為0.2至1.0。可以觀察到,替換后的變元與原型中的語境匹配較好,這表明它們在語義上與原型相似。另一方面,重寫附加標記可以平滑生成的數據并擴展其多樣性。但是,由于沒有明確的指導,此步驟還可能引入不可預測的噪聲,使生成過程不如預期流暢。

表3顯示了一個原型及其生成事件,元素m范圍為0.2至1.0。可以觀察到,替換后的變元與原型中的語境匹配較好,這表明它們在語義上與原型相似。另一方面,重寫附加標記可以平滑生成的數據并擴展其多樣性。但是,由于沒有明確的指導,此步驟還可能引入不可預測的噪聲,使生成過程不如預期流暢。

總結:

論文解決的是EE問題,提出PLMEE模型,模型由事件抽取模型和生成模型兩部分組成,這兩個模塊都使用到了預訓練語言模型來引入更豐富的知識。針對角色重疊問題,論文的抽取方法根據角色分離了元素預測,針對每個元素使用一組二分類器,預測元素的角色標簽。并根據不同角色對該類型事件的重要性,對損失函數的權重進行了重分配。

針對訓練數據有限、人工標注耗時耗力的問題,本文提出了一個事件生成方法,通過元素替換和重寫adjunct tokens生成新的事件樣本,并使用一個打分函數對樣本進行評分,選取高質量的樣本作為訓練數據的補充。

實驗證明了該事件生成模型的有效性,將事件生成模型和事件抽取模型相結合可以增強事件抽取模型的性能。

PLMEE模型的局限性:

(1)同一類型的事件通常具有相似性,并且共現的角色通常有很強的關聯,但是PLMEE模型忽略了這些特征。

(2)盡管生成模型中使用了評分函數對生成的樣本進行篩選,但仍面臨著和遠程監督方法一樣的角色偏離問題。(因為adjunct tokens重寫之后語義可能會發生很大的變化)

未來工作:

將事件間的關聯和元素間的關聯納入考慮,并合并到預訓練語言模型中;使用更有效的度量方法,克服生成模型的角色偏離問題。

- 免責聲明

- 本文所包含的觀點僅代表作者個人看法,不代表新火種的觀點。在新火種上獲取的所有信息均不應被視為投資建議。新火種對本文可能提及或鏈接的任何項目不表示認可。 交易和投資涉及高風險,讀者在采取與本文內容相關的任何行動之前,請務必進行充分的盡職調查。最終的決策應該基于您自己的獨立判斷。新火種不對因依賴本文觀點而產生的任何金錢損失負任何責任。

新火種

2023-11-01

新火種

2023-11-01