加里·馬庫斯:如果生成式AI是啞彈,可能導致不必要的中美緊張

【編者按】當地時間8月13日,一向喜歡給ChatGPT潑冷水的美國知名AI學者加里·馬庫斯(Gary Marcus)發表文章,標題為《如果生成式AI被證明是個啞彈怎么辦?》。在文章中,他認為,生成式人工智能目前還沒有帶來足夠的收入以支撐火熱的估值,繼續這樣可能會導致一些初創企業倒閉。在技術上,短期內也無法解決幻覺問題和實現通用人工智能。

除此之外,馬庫斯更擔心生成式人工智能帶來一些可能的地緣政治影響。“如果生成式人工智能將比火和電更強大的前提被證明是錯誤的,或者至少在未來十年內沒有得到證實,那么有可能事后看來,最終會導致與中國產生不必要的額外緊張關系。”他寫道。

馬庫斯一直是生成式AI浪潮的唱反調者,堅稱僅靠深度學習并不能實現類人智能,經常在社交媒體上與AI知名學者舌戰,并簽署了暫停訓練比GPT-4更強大AI系統的公開信。以下為這篇文章的全文翻譯。

美國AI科學家、作家和企業家加里·馬庫斯。

除了迅速火熱和迅速降溫的所謂室溫超導體LK-99之外,我很少見過有東西比生成式人工智能被炒作得更厲害。許多公司的估值都在數十億美元,新聞報道持續不斷;從硅谷到華盛頓特區再到日內瓦,這是任何人都可以談論的話題。

但是,首先,收入還沒有到來,而且可能永遠不會到來。估值預計將達到數萬億美元市場,但據傳生成式人工智能目前的實際收入為數億美元。這些收入確實可能增長1000倍,但這極具猜測性。我們不應該只是推測。

到目前為止,大部分收入似乎來自兩個來源:編寫半自動代碼(程序員喜歡使用生成工具作為助手)和編寫文本。我認為程序員會對生成式人工智能的幫助感到滿意;它的自動完成特性對于他們的工作來說非常棒,并且他們接受過檢測和修復常見錯誤的培訓。本科生將繼續使用生成式人工智能,但他們的財力并不雄厚(他們很可能會轉向開源競爭對手)。

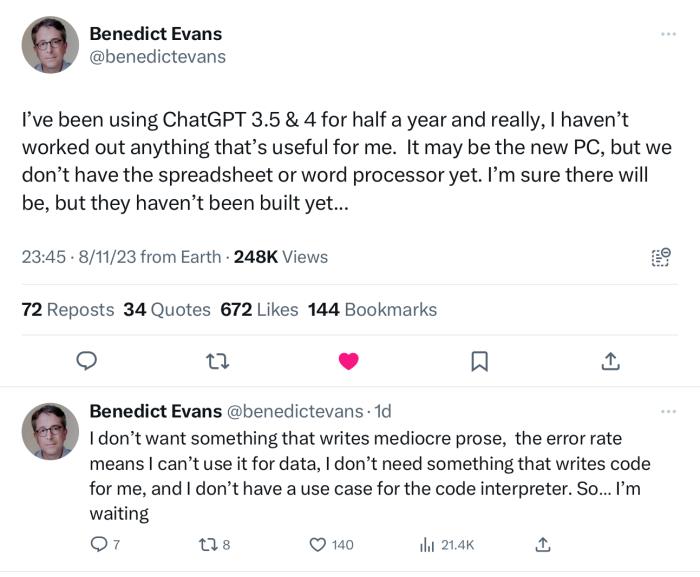

其他潛在的付費客戶可能很快就會失去信心。今天早上,頗具影響力的風險投資家本尼迪特·埃文斯(Benedict Evans)在X(以前的Twitter)上的一系列帖子中提出了這一點:

風險投資家本尼迪特·埃文斯寫道:我用了半年的ChatGPT3.5&4,真的沒發現對我有任何用處。它可能是新的個人電腦,但不是電子試算表或文字處理器。我相信會有,但目前還沒有。

我的朋友嘗試使用ChatGPT來回答搜索查詢以幫助進行學術研究,他們也面臨著類似的幻滅。一位使用ChatGPT進行法律研究的律師受到了法官的嚴厲斥責,并且基本上不得不以書面形式承諾,永遠不會再以無人監督的方式這樣做。幾周前,一則新聞報道暗示GPT的使用可能會下降。

如果埃文斯的經歷是煤礦里的金絲雀(編者注:通常預示著前方有更多危機),那么整個生成式人工智能領域,至少按照目前的估值,可能會很快結束。程序員將繼續使用它,而必須編寫大量文案來推廣其產品以提高搜索引擎排名的營銷人員也會繼續使用它。但無論是編程還是快速、質量平庸的文案寫作都遠遠不足以維持當前的估值夢想。

即使是OpenAI也很難實現其290億美元的估值;如果年復一年只有數千萬或數億美元的收入,估值在數十億美元以下的正在競爭的初創公司很可能最終倒閉。微軟今年的股價上漲了近一半,或許主要是因為其對生成式人工智能的承諾,但其股價可能會暴跌;英偉達暴漲得更多,也可能下跌。

羅杰·麥克納米(Roger McNamee)是軟件風險投資的早期先驅,前幾天我和他討論了這個問題。也許在經濟上對我們雙方來說真正有吸引力的唯一用例是搜索(例如,使用由ChatGPT提供支持的Bing而不是谷歌搜索),但其中的技術問題是巨大的;沒有理由認為幻覺問題(編者注:AI出現錯誤或偏差,導致生成不準確、錯誤甚至荒誕結果的現象)很快就會得到解決。如果不行,泡沫很容易破裂。

但現在讓我擔心的,不僅僅是整個生成式人工智能經濟(仍然更多地基于承諾而不是實際商業用途)可能會出現大規模、令人痛苦的修正,而是我們正在把整個全球和國家政策建立在一個前提上,即生成式人工智能將以事后看來可能不現實的方式改變世界。

在全球方面,拜登政府不僅限制了對生成式人工智能(目前)至關重要的高端硬件芯片的使用,而且對中國的投資也設限;中國對全球合作也并不十分熱情(僅代表作者本人觀點)。緊張局勢非常嚴重,其中很多都圍繞著誰可能“贏得人工智能戰爭”的夢想。

但如果贏家不是任何人,至少在短期內不是這樣呢?

在國內方面,可能保護消費者的監管(例如圍繞隱私、減少偏見、要求數據透明度、打擊錯誤信息等)正在因確保美國生成式人工智能盡快發展的制衡壓力而放緩。我們可能無法獲得所需的消費者保護,因為我們正在努力培育一些可能不會按預期增長的東西。

我并不是說任何人的某些政策都是錯誤的,但如果生成式人工智能將比火和電更強大的前提被證明是錯誤的,或者至少在未來十年內沒有得到證實,那么有可能事后看來,最終會導致與中國產生不必要的額外緊張關系,甚至可能因海市蜃樓而引發臺灣戰爭,以及社交媒體層面的慘敗,消費者在資訊中受到剝削,錯誤信息占據了主導地位,因為政府不敢采取足夠嚴厲的打擊措施。很難對這一切提出質疑,但這是一個發人深省的想法,我希望華盛頓和北京都能對此有所考慮。

在我看來,幾乎每個人都犯的根本錯誤是相信生成式人工智能等同于 AGI(通用人工智能,與人類一樣聰明、足智多謀,甚至更出色)。

行業里的每個人可能都希望你相信通用人工智能即將到來。它激發了他們對必然性的敘述,并推動了他們的股價和初創公司的估值。 Anthropic首席執行官達里奧·阿莫代(Dario Amodei)最近預測,我們將在2-3年內實現AGI。谷歌DeepMind首席執行官德米斯·哈薩比斯(Demis Hassabis)也預測AGI會在近期到來。

我嚴重懷疑這一點。生成式AI的核心問題不是一個,而是許多嚴重的、未解決的問題——從編造(幻覺)虛假信息的傾向,到無法可靠地與Wolfram Alpha等外部工具交互,到每個月的不穩定(這使得它們不適合在大型系統中進行工程化使用)。

而且,事實證明,除了純粹的技術樂觀主義之外,我們沒有任何具體理由認為這些問題的解決方案近在眼前。通過擴大系統規模來“擴展”它在某些方面有所幫助,但在其他方面卻沒有幫助。我們仍然無法保證任何給定的系統都是誠實的、無害的或有幫助的,而不是阿諛奉承的、不誠實的、有毒的或有偏見的。人工智能研究人員多年來一直致力于解決這些問題。想象這些具有挑戰性的問題會突然全部得到解決是愚蠢的。22年來,我一直在抱怨幻覺錯誤;人們一直承諾解決方案即將到來,但它從未實現。我們現在擁有的技術是建立在自動完成而不是事實性的基礎上的。

有一段時間,這種擔憂被置若罔聞。但一些科技領袖似乎終于明白了這一點。看看幾天前《財富》雜志上的這個故事:

《財富》雜志報道稱,科技專家開始懷疑ChatGPT和AI的幻覺問題是否會解決。

如果幻覺無法修復,生成式人工智能每年可能賺不到1萬億美元。如果它每年賺不到1萬億美元,那么它可能不會產生人們預期的影響。如果它不會產生這種影響,也許我們不應該圍繞它的前提來構建我們的世界。

原文鏈接:https://garymarcus.substack.com/p/what-if-generative-ai-turned-out

- 免責聲明

- 本文所包含的觀點僅代表作者個人看法,不代表新火種的觀點。在新火種上獲取的所有信息均不應被視為投資建議。新火種對本文可能提及或鏈接的任何項目不表示認可。 交易和投資涉及高風險,讀者在采取與本文內容相關的任何行動之前,請務必進行充分的盡職調查。最終的決策應該基于您自己的獨立判斷。新火種不對因依賴本文觀點而產生的任何金錢損失負任何責任。

新火種

2023-10-28

新火種

2023-10-28