OpenAI權力游戲的“黑與白”

集微網報道 (文/陳興華)

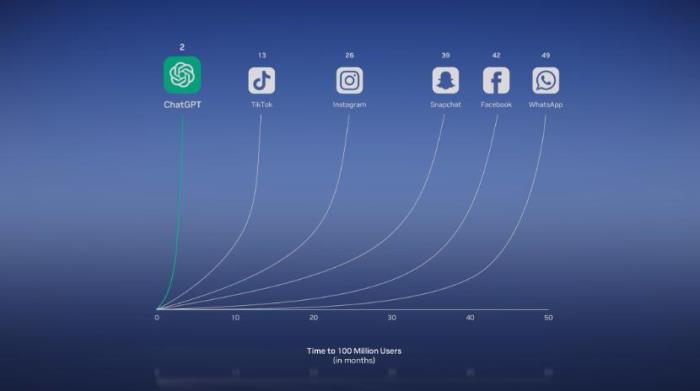

隨著山姆·阿爾特曼等重返OpenAI,震驚硅谷乃至全世界的年度“宮斗”大戲終于塵埃落定。三天三換CEO、“推手”倒戈、700員工聯名“逼宮”、投資者發起訴訟威脅、微軟介入助攻… 由于劇情節奏緊湊、百轉千回、環環相扣,這一事件宛如硅谷的《甄嬛傳》Plus加速版。

在這背后,究其根源既有OpenAI“加速主義“與“安全主義”的路線之爭,也凸顯出有效利他主義社會運動在硅谷大大小小的AI公司中間制造的裂痕,而OpenAI的風波再次打擊了這項運動。這或將預示著AI技術發展將進入兼顧技術進步和倫理安全的新階段。

“加速”與“安全”主義路線之爭?

OpenAI的“政變”一定程度上體現的是“加速主義“與“安全主義”的路線之爭。

其中,加速主義也稱“有效加速”,即對AGI(通用人工智能)的商業化進展抱有極大熱情,準備大干快上跑步進入第四次工業革命,締造下一個科技巨頭;安全主義也稱“超級對齊”,即對AGI充滿警惕,擔憂AI會對人類生存造成風險,堅持用謹慎的態度開發AI。

在OpenAI內部,阿爾特曼是“加速主義”代表,而蘇茨克維則可謂“超級對齊”代表。

OpenAI CEO山姆·阿爾特曼

具體來看,繼在首屆開發者大會上盛大發布GPT-4 Turbo和全新藍圖后,阿爾特曼在日前舉行的亞太經合組織首席執行官峰會上不僅發表了行業“不需要嚴格監管”的輕松言論,并暗示了OpenAI最近取得的重要技術進步,稱有幸目睹知識邊界四次被推進,最近一次發生在幾周前。他還表示,“相信通用人工智能(AGI)就在眼前”。

相比之下,作為OpenAI首席科學家,蘇茨克維則長期在扮演另類“保駕”角色。今年7月,他與賈恩·雷克聯合成立了一個“超級對齊(Superalignment)”團隊,致力于限制比人類更智能的AI系統所帶來的威脅,宣布未來四年將把20%的計算資源用于解決超級智能對齊問題。

但沒等他把“超級對齊”徹底落實,危機就爆發了。

目前多種傳言指向,阿爾特曼“劇透”的重大技術進步,可能是董事會決定開除他的關鍵原因之一。這個曾經由蘇茨克維牽頭的技術突破有助于開發出更強大的AI模型,但引起了一些員工的擔憂:OpenAI有沒有適當的保障措施,來將這類先進AI模型商業化?

據悉,蘇茨克維于2021年啟動的GPT-Zero項目使OpenAI克服了獲得足夠高質量數據來訓練新模型的限制。該研究涉及使用計算機生成的數據,而不是從互聯網中提取的文本或圖像等數據來訓練新模型。

之后幾個月,OpenAI研究主管雅庫布·帕喬基和OpenAI高級研究人員西蒙·西多爾利用這項創新構建了一個新模型Q*(發音為“Q-Star”)。該模型能夠以前所未有的能力來解決數學問題,是OpenAI探索AGI的一個重要技術里程碑。最近幾周,Q*模型的演示在OpenAI內部流傳,發展速度讓一些AI安全研究人員感到震驚。

但身為“超級對齊”派的蘇茨克維對Q-Star持謹慎和警惕的態度,而身為“有效加速”派的原總裁格雷格·布羅克曼一直在努力將該技術集成到新產品中。在這一局勢下,幾位研究人員曾于11月14日致信OpenAI董事會,稱一項強大的人工智能發現可能會威脅人類等。

最終,蘇茨克維或許認為茲事體大,于是引發了魔幻般的一百小時“宮斗大戲”,阿爾特曼被罷免,布羅克曼憤而離職,緊接著帕喬基、西多爾等首批辭職,隨后事件不斷發酵。

而在遭遇OpenAI高管和員工集體逼宮以及布羅克曼妻子安娜(同為OpenAI員工,蘇茨克維曾是其婚禮司儀)在辦公司的哭訴懇請后,蘇茨克維態度開始松動,并發帖懺悔:“我對參與董事會的行動深表遺憾,我從未想過要傷害OpenAI,并熱愛我們共同建立的一切,我會盡我所能讓公司重新團結起來。”

鑒于對OpenAI的突出貢獻以及“倒戈立功”,蘇茨克維如今依舊留在了OpenAI。雖然OpenAI原董事會至今尚未說明罷免阿爾特曼的具體原因,但從他的角度看來,重要的問題在于原董事會被“過度關注安全、受有效利他主義影響的人接管”。

“有效利他主義”或成關鍵癥結

OpenAI引爆的軒然大波表面是一家企業的內斗,其實內里折射出的也是硅谷兩種發展理念矛盾的日益激化。過去幾年,名為“有效利他主義”的社會運動在硅谷各家AI公司中野蠻生長,而AI安全問題正是其重點擔憂的議題。

有效利他主義者聲稱,他們可以構筑更安全的AI系統,因為他們愿意投資于所謂的“對齊(alignment)”,確保員工可以控制其創造的AI技術,并確保AI技術符合一系列人類價值觀。不難看出,蘇茨克維部分舉措也體現出了其受到有效利他主義的影響。

OpenAI原董事會六名成員

進一步來看,與蘇茨克維一起發動“OpenAI政變”的三位董事會成員,分別是“美版知乎”Quora CEO亞當·德安吉洛,政策非營利機構蘭德公司的兼職高級管理科學家塔莎·麥考利,以及喬治城大學安全與新興技術中心戰略總監海倫·托納。其中,塔莎·麥考利、海倫·托納則都致力于有效利他主義的慈善事業。

而就在阿爾特曼被罷免事件的幾周前,托納與其剛產生過沖突。矛盾出在托納與人合著的一篇學術論文,托納在這篇論文中似乎批評OpenAI為確保其AI技術安全所做的努力,同時贊揚OpenAI競爭對手Anthropic采取的安全實踐。這自然令阿爾特曼感到不滿。

值得注意的是,托納、麥考利以及Anthropic都與支持有效利他主義事業的非營利開放慈善組織Open Philanthropy關系緊密。而OpenAI的主要競爭對手Anthropic的創始人之一丹妮拉·阿莫迪,于2017年與Open Philanthropy的CEO霍爾頓·卡諾夫斯基結為夫婦。

在履歷上,丹妮拉曾于OpenAI任職安全政策副總裁,2020年底,她與任職OpenAI研發副總裁的哥哥達里奧·阿莫迪因為AI安全問題的分歧離開了OpenAI,隨后于2021年初創辦了旨在優先考慮AI安全與監管的AI公司Anthropic,并獲得亞馬遜、谷歌等大筆投資。

簡而言之,目前有效利他主義運動已經在硅谷科技行業的科學家、投資者和高管隊伍中較大面積傳播開來,其中不乏一些知名人士支持,包括Facebook的聯合創始人達斯汀·莫斯科維茨、Skype的億萬富翁創始人讓·塔林,他們承諾為有效利他主義研究提供數以十億美元計資金等。這場運動的參與者認為,AI可以帶來全球繁榮,但首先必須防止它造成破壞。

但這一運動近來也遭遇了挑戰。幾周之前,有效利他主義最著名的支持者FTX聯合創始人山姆·班克曼-弗里德(Anthropic的最大投資者之一)被判犯有詐騙罪。行業分析稱,OpenAI的內爆顯示了這項運動的影響力,但再次對其進行了打擊。(注:在OpenAI目前僅設立的三名董事會席位中,托納、麥考利均被清出,德安吉洛繼續留任。)

同時,業界也不乏對有效利他主義運動的駁斥和否定。

其中,風險投資家、OpenAI投資人維諾德·科斯拉認為,“OpenAI的董事會成員對‘有效利他主義’的信奉及錯誤應用,可能會阻礙世界享受AI的巨大紅利。”硅谷創業孵化器Y Combinator首席執行官陳嘉興稱其為一種虛無縹緲的“美德信號哲學”,應予以摒棄,以“解決真正的問題,創造人類的富足”。普林斯頓大學研究員沙澤達·艾哈邁德稱,有效利他主義者對AI將毀滅人類的迫切恐懼“使他們無法接受來自文化之外的批評”。

無論如何,開弓沒有回頭箭。隨著硅谷年度“宮斗”大劇告一段落,圍繞如何平衡AI技術進步與安全治理的發展戰略,將成為接下來OpenAI等公司創新與發展上的長期焦點議題。

(校對/張軼群)

- 免責聲明

- 本文所包含的觀點僅代表作者個人看法,不代表新火種的觀點。在新火種上獲取的所有信息均不應被視為投資建議。新火種對本文可能提及或鏈接的任何項目不表示認可。 交易和投資涉及高風險,讀者在采取與本文內容相關的任何行動之前,請務必進行充分的盡職調查。最終的決策應該基于您自己的獨立判斷。新火種不對因依賴本文觀點而產生的任何金錢損失負任何責任。

新火種

2023-11-27

新火種

2023-11-27